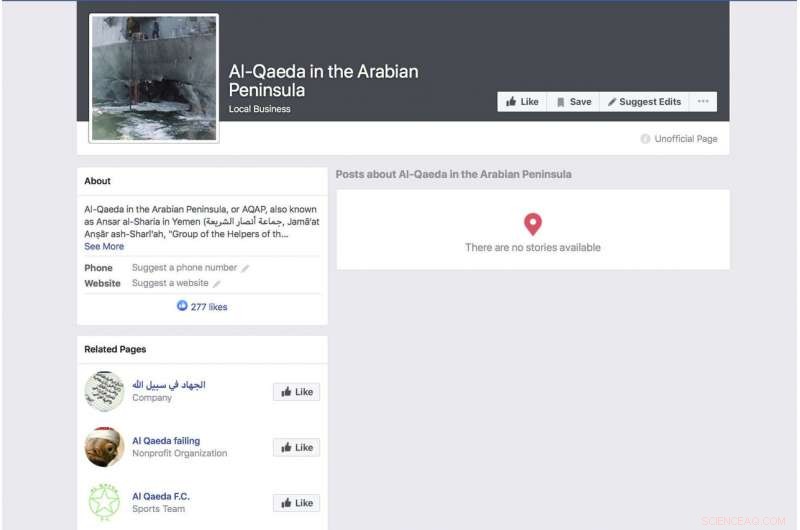

Uma página gerada automaticamente no Facebook para um grupo que se identifica como o grupo terrorista "Al-Qaeda na Península Arábica" exibe uma foto do navio de guerra USS Cole da Marinha dos EUA bombardeado. A página ainda estava ativa na terça-feira, 7 de maio, 2019, quando a captura de tela foi feita. O Facebook diz que possui sistemas robustos para remover conteúdo de grupos extremistas, mas a reclamação de um denunciante lacrado analisada pela AP diz que o conteúdo proibido permanece na web e é fácil de encontrar. (Facebook via AP)

A pergunta surge repetidamente, com material extremista, discurso de ódio, intromissão eleitoral e invasões de privacidade. Por que o Facebook não pode simplesmente consertar?

É complicado, com razões que incluem o tamanho do Facebook, seu modelo de negócios e limitações técnicas, para não falar de anos de crescimento descontrolado. Oh, e o elemento da natureza humana.

A última revelação:o Facebook está inadvertidamente criando vídeos comemorativos usando conteúdo extremista e páginas de negócios geradas automaticamente para empresas como ISIS e Al Qaeda. A empresa afirma que está trabalhando em soluções e que os problemas estão melhorando. Isso é verdade, mas os críticos dizem que melhor não é o suficiente quando tiroteios em massa estão sendo transmitidos ao vivo e multidões online espalham rumores que levam à violência mortal.

"Eles têm sido frustrantemente lentos em lidar com tudo, desde o abuso sexual infantil ao terrorismo, supremacia branca, assédio moral, pornografia não consensual "e coisas como permitir que os anunciantes segmentem categorias como" Odiador de judeus, "simplesmente porque alguns usuários listaram o termo como um" interesse, "disse Hany Farid, um especialista forense digital da Universidade da Califórnia, Berkeley.

À medida que novos problemas surgem, A fórmula do Facebook tem sido pedir desculpas e prometer fazer mudanças, às vezes também observando que não antecipou como os agentes mal-intencionados poderiam usar mal sua plataforma com tanta facilidade. Mais recentemente, a empresa também enfatizou o quanto está melhorando, tanto tecnicamente em seu uso de inteligência artificial para detectar problemas quanto em termos de concentrar mais dinheiro e esforço em corrigi-los.

Um banner dizendo "O Estado Islâmico" é exibido na página do Facebook de um usuário que se identifica como Nawan Al-Farancsa. A página ainda estava no ar na terça-feira, 7 de maio, 2019, quando a captura de tela foi feita. O Facebook diz que possui sistemas robustos para remover conteúdo de grupos extremistas, mas a reclamação de um denunciante selado analisada pela AP diz que o conteúdo proibido permanece na web e é fácil de encontrar. (Facebook via AP)

"Depois de fazer grandes investimentos, estamos detectando e removendo conteúdo de terrorismo com uma taxa de sucesso muito maior do que há dois anos, "O Facebook disse na quarta-feira em resposta às revelações sobre as páginas geradas automaticamente." Não afirmamos encontrar tudo, e permanecemos vigilantes em nossos esforços contra grupos terroristas em todo o mundo. "

Ele teve algum sucesso. No final de 2016, O CEO Mark Zuckerberg descartou de forma infame como "muito maluca" a ideia de que notícias falsas sobre seu serviço poderiam ter influenciado a eleição. Mais tarde ele voltou atrás, e, desde então, a empresa reduziu a quantidade de informações incorretas compartilhadas em seu serviço, conforme medido por vários estudos independentes.

Zuckerberg também, em geral, evitou gafes semelhantes admitindo erros e apresentando desculpas ao público e aos legisladores.

Mas, mesmo que a empresa resolva um problema, outros aparecem. A razão para isso pode estar embutida em seu DNA. E não é só porque seu modelo de negócios depende do maior número de pessoas possível, usando-o tanto quanto possível, deixando para trás detalhes pessoais que podem então ser direcionados pelos anunciantes.

Nesta quinta-feira, 29 de março 2018, foto do arquivo, o logotipo do Facebook aparece nas telas do Nasdaq MarketSite, na Times Square de Nova York. A questão surge repetidamente, com material extremista, discurso de ódio, interferência nas eleições, invasões de privacidade, discriminação habitacional. Por que o Facebook não pode simplesmente consertar? (AP Photo / Richard Drew, Arquivo)

Neste 11 de abril, 2018, foto do arquivo, O CEO do Facebook, Mark Zuckerberg, testemunhou antes de uma audiência da House Energy and Commerce no Capitólio, em Washington. O Facebook dá a impressão de que está interrompendo a grande maioria das postagens extremistas antes que os usuários as vejam. Mas a reclamação de um denunciante confidencial à Securities and Exchange Commission obtida pela The Associated Press alega que a empresa de mídia social exagerou seu sucesso. (AP Photo / Andrew Harnik, Arquivo)

"Quase tudo o que o Facebook projetou foi projetado para pessoas boas. Pessoas que são legais umas com as outras, quem tem aniversários para comemorar, que têm novos filhotes e geralmente gostam de tratar bem os outros, "disse Siva Vaidhyanathan, diretor do Center for Media and Citizenship da University of Virginia. "Basicamente, o Facebook é feito para uma espécie melhor do que a nossa. Se fosse feito para golden retrievers, tudo ficaria ótimo. "

Mas se apenas 1% dos 2,4 bilhões de pessoas no Facebook quiserem fazer coisas terríveis para os outros, são 24 milhões de pessoas.

"A cada duas semanas, ouvimos sobre o Facebook derrubando páginas problemáticas, fazendo promessas sobre a contratação de mais pessoas, construir IA e assim por diante, "Vaidhyanathan disse." Mas na escala do Facebook, nada disso importará. Estamos basicamente presos a todo esse lixo. "

Chris Hughes, um cofundador do Facebook, pediu o fim do gigante da mídia social em um artigo de quinta-feira. Vaidhyanathan também acha que uma forte regulamentação governamental pode ser a resposta, como as leis que "limitam a capacidade das empresas de absorver todos os nossos dados e usá-los para direcionar a publicidade".

"Nós realmente deveríamos abordar o back-end do Facebook, "ele disse." Isso é o que você tem que atacar. "

© 2019 Associated Press. Todos os direitos reservados.