p Crédito:Universidade de Tecnologia de Eindhoven

p Crédito:Universidade de Tecnologia de Eindhoven

p Uma equipe internacional de cientistas da Universidade de Tecnologia de Eindhoven, Universidade do Texas em Austin, e a Universidade de Derby, desenvolveu um método revolucionário que acelera quadraticamente algoritmos de treinamento de inteligência artificial (IA). Isso dá capacidade total de IA para computadores baratos, e tornaria possível em um a dois anos para supercomputadores utilizar Redes Neurais Artificiais que quadraticamente excedem as possibilidades das redes neurais artificiais de hoje. Os cientistas apresentaram seu método em 19 de junho na revista

Nature Communications . p As Redes Neurais Artificiais (ou RNA) estão no centro da revolução da IA que está moldando todos os aspectos da sociedade e da tecnologia. Mas as RNAs com as quais fomos capazes de lidar até agora não estão nem perto de resolver problemas muito complexos. Os supercomputadores mais recentes lutariam com uma rede de 16 milhões de neurônios (quase do tamanho de um cérebro de sapo), embora levasse mais de doze dias para um poderoso computador de mesa treinar apenas 100, Rede de 000 neurônios.

p

Remédio personalizado

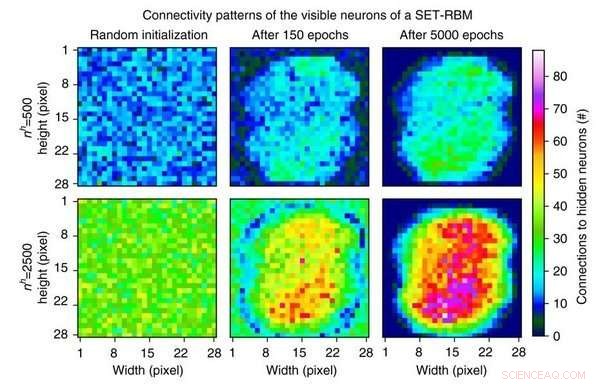

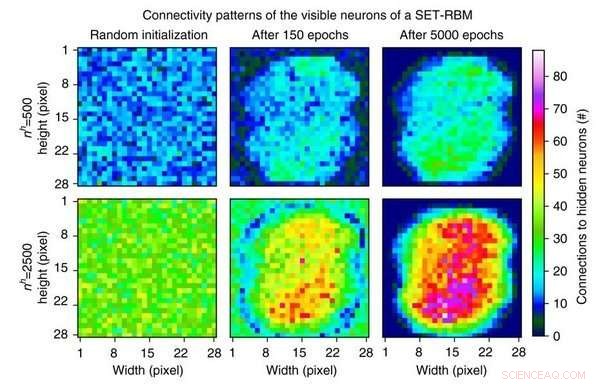

p O método proposto, denominado Sparse Evolutionary Training (SET), inspira-se em redes biológicas e, em particular, redes neurais que devem sua eficiência a três características simples:as redes têm relativamente poucas conexões (esparsidade), poucos hubs (liberdade de escala) e caminhos curtos (pequeno mundo). O trabalho relatado em

Nature Communications demonstra os benefícios de se afastar de ANNs totalmente conectadas (como feito em IA comum), introduzindo um novo procedimento de treinamento que começa de forma aleatória, rede esparsa e evolui iterativamente para um sistema sem escala. Em cada etapa, as conexões mais fracas são eliminadas e novos links são adicionados aleatoriamente, de forma semelhante a um processo biológico conhecido como encolhimento sináptico.

p O impressionante efeito de aceleração deste método tem um significado enorme, pois permitirá a aplicação de IA a problemas que atualmente não são tratáveis devido ao grande número de parâmetros. Os exemplos incluem medicina personalizada acessível e sistemas complexos. No complexo, ambientes que mudam rapidamente, como redes inteligentes e sistemas sociais, onde o retreinamento em tempo real frequente de uma ANN é necessário, melhorias na velocidade de aprendizagem (sem comprometer a precisão) são essenciais. Além disso, porque esse treinamento pode ser alcançado com recursos de computação limitados, o método SET proposto será preferido para as inteligências embutidas dos muitos dispositivos distribuídos conectados a um sistema maior.

p

Cérebro de sapo

p Assim, concretamente, com SET, qualquer usuário pode construir em seu próprio laptop uma rede neural artificial de até 1 milhão de neurônios, enquanto com métodos de última geração, isso era reservado apenas para nuvens de computação caras. Isso não significa que as nuvens não sejam mais úteis. Eles são. Imagine o que você pode construir sobre eles com SET. Atualmente, as maiores redes neurais artificiais, construído em supercomputadores, têm o tamanho de um cérebro de rã (cerca de 16 milhões de neurônios). Depois que alguns desafios técnicos forem superados, com SET, podemos construir nos mesmos supercomputadores redes neurais artificiais próximas ao tamanho do cérebro humano (cerca de 80 bilhões de neurônios).

p Autor principal, Dr. Decebal Mocanu:"E, sim, precisamos de redes extremamente grandes. Foi mostrado, por exemplo, que as redes neurais artificiais são boas na detecção de câncer em genes humanos. Contudo, cromossomos completos são muito grandes para caber em redes neurais artificiais de última geração, mas eles poderiam caber em uma rede de 80 bilhões de neurônios. Esse fato pode, hipoteticamente, levar a melhores cuidados de saúde e medicina personalizada acessível para todos nós. "