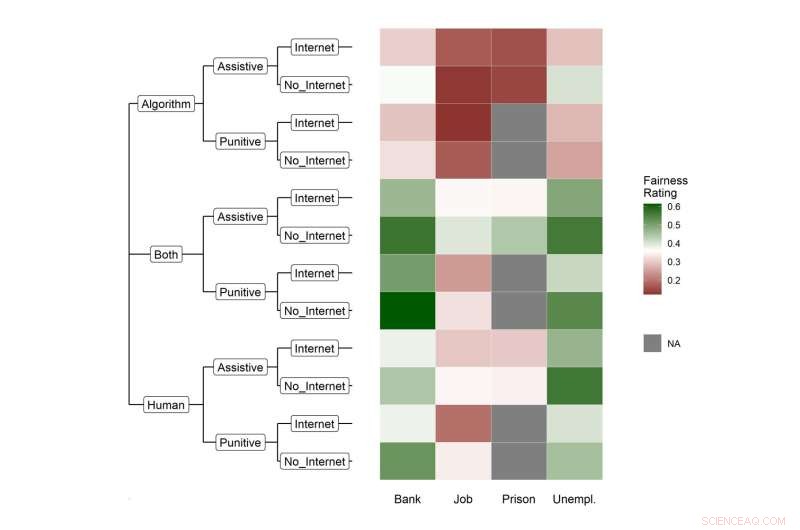

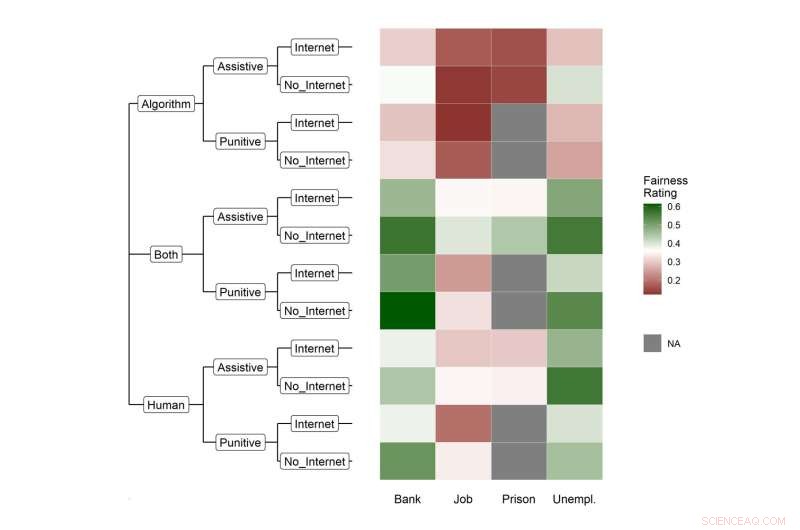

O mapa de calor mostra as frequências relativas dos entrevistados que classificaram um cenário como "Regular" (ou seja, "Um pouco justo" ou "Muito justo"). A escala de cores é centrada na classificação média de imparcialidade em todos os experimentos. Crédito:Patterns/Gordon e Kern et al.

Hoje, o aprendizado de máquina ajuda a determinar o empréstimo para o qual nos qualificamos, o trabalho que conseguimos e até mesmo quem vai para a prisão. Mas quando se trata dessas decisões que podem alterar a vida, os computadores podem tomar uma decisão justa? Em um estudo publicado em 29 de setembro na revista

Patterns , pesquisadores da Alemanha mostraram que, com supervisão humana, as pessoas pensam que a decisão de um computador pode ser tão justa quanto uma decisão tomada principalmente por humanos.

“Muito da discussão sobre justiça no aprendizado de máquina se concentrou em soluções técnicas, como consertar algoritmos injustos e como tornar os sistemas justos”, diz o cientista social computacional e coautor Ruben Bach, da Universidade de Mannheim, na Alemanha. "Mas nossa pergunta é:o que as pessoas acham que é justo? Não se trata apenas de desenvolver algoritmos. Eles precisam ser aceitos pela sociedade e atender às crenças normativas do mundo real."

A tomada de decisão automatizada, em que uma conclusão é feita apenas por um computador, se destaca na análise de grandes conjuntos de dados para detectar padrões. Os computadores são frequentemente considerados objetivos e neutros em comparação com os humanos, cujos preconceitos podem obscurecer os julgamentos. No entanto, o preconceito pode se infiltrar nos sistemas de computador à medida que aprendem com dados que refletem padrões discriminatórios em nosso mundo. Compreender a justiça nas decisões computacionais e humanas é crucial para a construção de uma sociedade mais equitativa.

Para entender o que as pessoas consideram justo na tomada de decisão automatizada, os pesquisadores entrevistaram 3.930 indivíduos na Alemanha. Os pesquisadores deram a eles cenários hipotéticos relacionados aos sistemas bancário, de emprego, prisão e desemprego. Dentro dos cenários, eles compararam ainda diferentes situações, incluindo se a decisão leva a um resultado positivo ou negativo, de onde vêm os dados para avaliação e quem toma a decisão final – humano, computador ou ambos.

“Como esperado, vimos que a tomada de decisão completamente automatizada não foi favorecida”, diz o cientista social computacional e co-autor Christoph Kern, da Universidade de Mannheim. “Mas o interessante é que quando você tem supervisão humana sobre a tomada de decisão automatizada, o nível de justiça percebida se torna semelhante à tomada de decisão centrada no ser humano”. Os resultados mostraram que as pessoas percebem uma decisão como mais justa quando os humanos estão envolvidos.

As pessoas também se preocupavam mais com a justiça nas decisões relacionadas ao sistema de justiça criminal ou às perspectivas de emprego, onde os riscos são maiores. Possivelmente vendo o peso das perdas maior do que o peso dos ganhos, os participantes consideraram as decisões que podem levar a resultados positivos mais justas do que as negativas. Em comparação com sistemas que dependem apenas de dados relacionados ao cenário, aqueles que utilizam dados adicionais não relacionados da internet foram considerados menos justos, confirmando a importância da transparência e privacidade dos dados. Juntos, os resultados mostraram que o contexto importa. Os sistemas automatizados de tomada de decisão precisam ser cuidadosamente projetados quando surgem preocupações com a justiça.

Embora situações hipotéticas na pesquisa possam não se traduzir totalmente no mundo real, a equipe já está discutindo os próximos passos para entender melhor a justiça. Eles planejam levar o estudo adiante para entender como pessoas diferentes definem justiça. Eles também querem usar pesquisas semelhantes para fazer mais perguntas sobre ideias como justiça distributiva, justiça na alocação de recursos entre a comunidade.

"De certa forma, esperamos que as pessoas da indústria possam considerar esses resultados como alimento para reflexão e como coisas que devem ser verificadas antes de desenvolver e implantar um sistema automatizado de tomada de decisão", diz Bach. “Também precisamos garantir que as pessoas entendam como os dados são processados e como as decisões são tomadas com base neles”.

+ Explorar mais As ilusões morais podem alterar nosso comportamento