Crédito:Zhang et al.

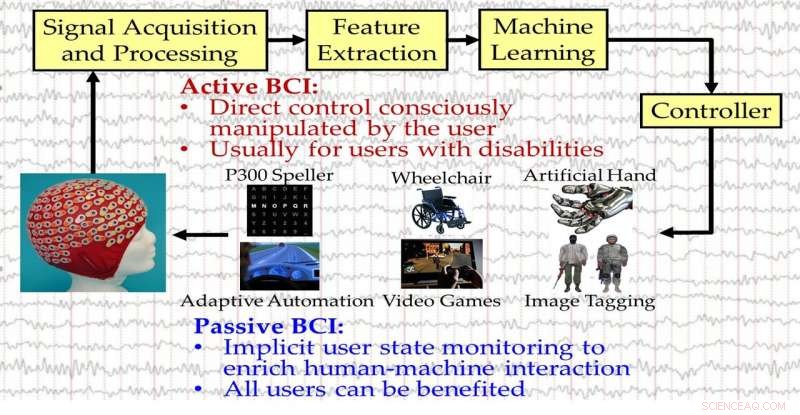

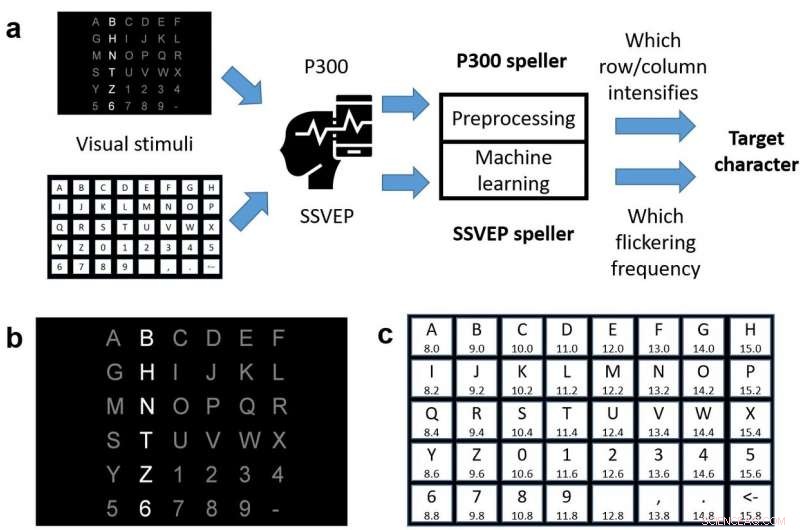

Interfaces cérebro-computador (BCIs) são ferramentas que podem conectar o cérebro humano a um dispositivo eletrônico, normalmente usando eletroencefalografia (EEG). Nos últimos anos, avanços em aprendizado de máquina (ML) permitiram o desenvolvimento de soletradores BCI mais avançados, dispositivos que permitem que as pessoas se comuniquem com computadores usando seus pensamentos.

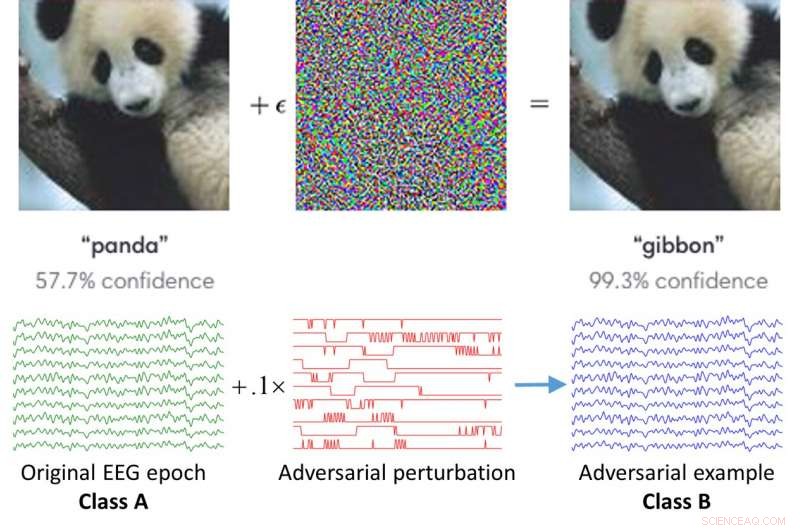

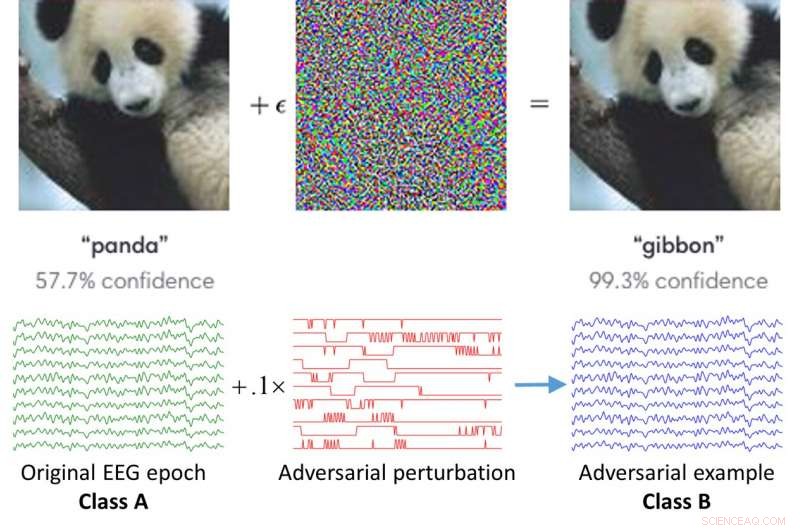

Até aqui, a maioria dos estudos nesta área tem se concentrado no desenvolvimento de classificadores BCI que são mais rápidos e confiáveis, em vez de investigar suas possíveis vulnerabilidades de segurança. Pesquisa recente, Contudo, sugere que algoritmos de aprendizado de máquina às vezes podem ser enganados por invasores, se eles são usados em visão computacional, reconhecimento de fala, ou outros domínios. Isso geralmente é feito usando exemplos adversários, que são pequenas perturbações em dados que são indistinguíveis por humanos.

Pesquisadores da Universidade Huazhong de Ciência e Tecnologia realizaram recentemente um estudo investigando a segurança de soletradores BCI baseados em EEG, e mais especificamente, como eles são afetados por perturbações adversárias. Seu papel, pré-publicado no arXiv, sugere que os soletradores BCI são enganados por essas perturbações e, portanto, são altamente vulneráveis a ataques adversários.

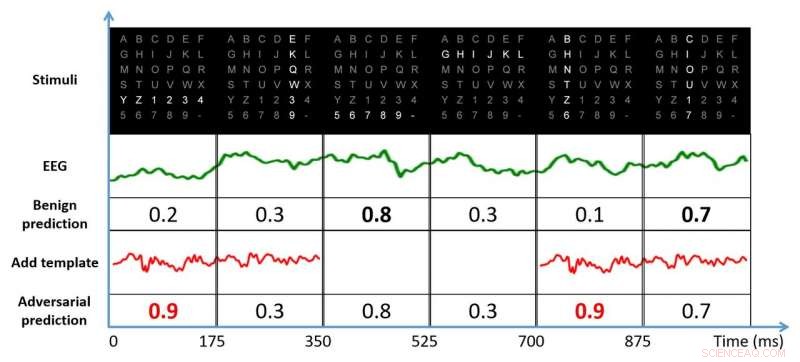

"Este artigo tem como objetivo expor uma preocupação crítica de segurança em spellers BCI baseados em EEG e, de forma mais ampla, BCIs baseados em EEG, que recebeu pouca atenção antes, "Dongrui Wu, um dos pesquisadores que realizou o estudo, disse TechXplore. "Isso mostra que é possível gerar minúsculos modelos de perturbação EEG adversários para ataques ao alvo para ambos os soletradores P300 e potencial evocado visual em estado estacionário (SSVEP), ou seja, enganar a classificação para qualquer personagem que o atacante queira, independentemente de qual seja o caractere pretendido pelo usuário. "

Crédito:Zhang et al.

Os soletradores P300 BCI já são usados em vários ambientes, inclusive em clínicas, para avaliar ou detectar distúrbios de consciência. Ataques adversários a soletradores BCI podem, portanto, ter inúmeras consequências, variando de simples problemas de usabilidade a graves diagnósticos incorretos de pacientes.

"Acreditamos que uma compreensão nova e mais detalhada de como as perturbações adversas no EEG afetam a classificação BCI pode informar o projeto de BCIs para se defender contra tais ataques, "Wu explicou.

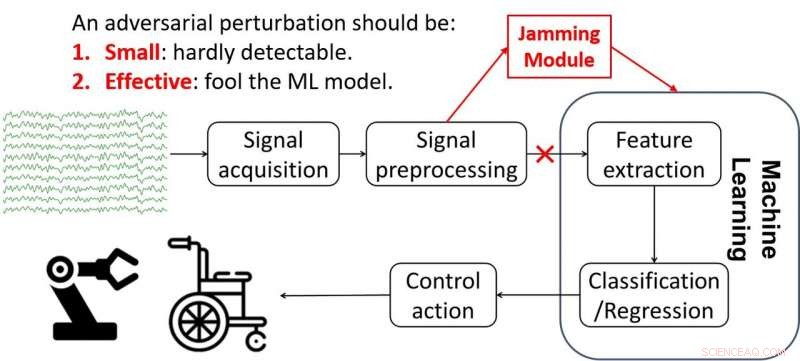

Wu e seus colegas descobriram que, para realizar um ataque adversário bem-sucedido em um soletrador BCI, o invasor só precisa acessar alguns dos dados usados para treinar o dispositivo. Ele / ela pode usar esses dados para treinar o modelo de perturbação, subsequentemente, adicionar o modelo a testes de EEG benignos para realizar o ataque.

As abordagens atuais para conduzir ataques adversários têm duas limitações principais. Primeiro, eles requerem algumas amostras de EEG específicas do sujeito para criar o modelo de perturbação adversária. Segundo, para realizar o ataque de forma mais eficaz, o atacante precisa saber o momento exato do estímulo EEG. Se o invasor superar com sucesso essas limitações, o impacto de seu ataque pode ser muito maior.

Crédito:Zhang et al.

"Defender ataques adversários é um problema de pesquisa comum em muitas aplicações de aprendizado de máquina, por exemplo., visão de computador, reconhecimento de fala, e BCIs, "Disse Wu." Se soubermos a abordagem que o atacante faz, então podemos desenvolver estratégias para nos defender contra ele, da mesma forma que nos defendemos contra vírus de computador:um vírus surge primeiro e então encontramos maneiras de matá-lo. "

Os invasores estão sempre tentando encontrar novas maneiras de contornar as medidas de segurança, por isso, é importante que os pesquisadores continuem investigando as vulnerabilidades do sistema e encontrem novas medidas de segurança. Embora seja inevitável que soluções de segurança direcionadas sejam desenvolvidas depois que uma vulnerabilidade específica for identificada, descobrir problemas gerais com um sistema e tomar precauções pode ser muito útil.

O estudo realizado por Wu e seus colegas ajudou a desvendar os riscos gerais de segurança associados aos BCIs baseados em EEG. Suas descobertas podem ajudar a identificar soluções provisórias que podem diminuir o impacto de ataques adversários a esses dispositivos.

Crédito:Zhang et al.

Crédito:Zhang et al.

Crédito:Zhang et al.

Wu e seus colegas esperam que sua pesquisa incentive outros a investigarem as limitações e vulnerabilidades de soletradores baseados em EEG ou outros dispositivos BCI. Suas descobertas podem, em última análise, abrir caminho para o desenvolvimento de técnicas para fortalecer a segurança dos BCIs, prevenir diagnósticos errados e outros efeitos indesejáveis de ataques adversários.

"Queremos enfatizar que o objetivo deste estudo não é danificar BCIs baseados em EEG, mas para demonstrar que ataques adversários sérios a BCIs baseados em EEG são possíveis e, portanto, expor uma preocupação crítica de segurança que recebia pouca atenção antes, "Disse Wu." Em nossas pesquisas futuras, planejamos desenvolver estratégias de defesa contra esses ataques. Enquanto isso, esperamos que nosso estudo possa atrair a atenção de mais pesquisadores para a segurança de BCIs baseados em EEG. "

© 2020 Science X Network