Rede neural ótica projetada aplicada a uma tarefa de aprendizado de máquina convencional. Crédito:UCLA Engineering Institute for Technology Advancement

A rede neural difrativa profunda é uma estrutura de aprendizado de máquina óptica que usa superfícies difrativas e matéria projetada para realizar cálculos opticamente. Após seu projeto e treinamento em um computador usando métodos modernos de aprendizagem profunda, cada rede é fabricada fisicamente, usando, por exemplo, impressão 3-D ou litografia, para transformar o modelo de rede treinado em matéria. Esta estrutura 3-D de matéria projetada é composta de superfícies transmissivas e / ou reflexivas que, juntas, realizam tarefas de aprendizado de máquina por meio da interação de matéria leve e difração óptica, na velocidade da luz, e sem a necessidade de qualquer poder, exceto para a luz que ilumina o objeto de entrada. Isso é especialmente significativo para reconhecer objetos alvo muito mais rápido e com muito menos poder em comparação com sistemas de aprendizado de máquina baseados em computador padrão, e pode fornecer grandes vantagens para veículos autônomos e várias aplicações relacionadas à defesa, entre outros. Introduzido por pesquisadores da UCLA [1], esta estrutura foi validada experimentalmente para classificação de objetos e imagens, fornecer uma estrutura de computação óptica escalonável e com eficiência energética. Na pesquisa seguinte, Os engenheiros da UCLA melhoraram ainda mais o desempenho de inferência de redes neurais ópticas difrativas integrando-as com redes neurais digitais profundas padrão, formando modelos de aprendizado de máquina híbridos que realizam computação parcialmente usando difração de luz através da matéria e parcialmente usando um computador [2].

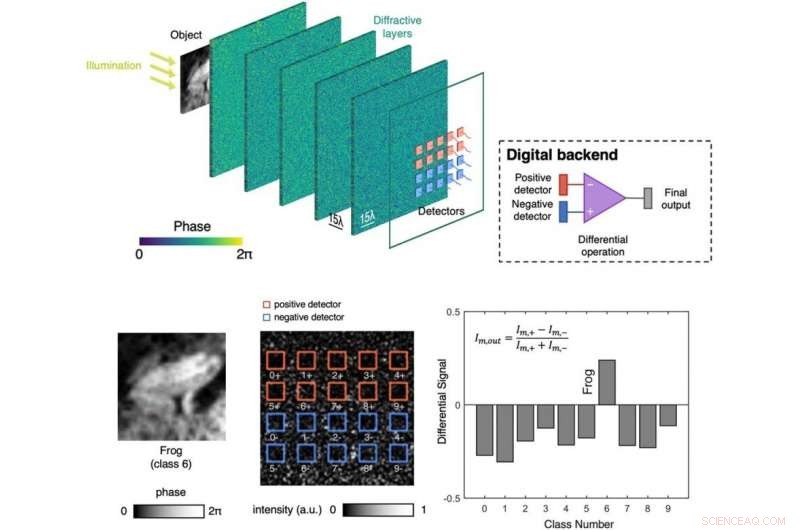

Em seu último trabalho, [3] publicado em Fotônica Avançada , um jornal de acesso aberto da SPIE, a sociedade internacional de óptica e fotônica, o grupo UCLA aproveitou ao máximo a capacidade de paralelização inerente da óptica, e melhorou significativamente o desempenho de inferência e generalização de redes neurais ópticas difrativas (veja a Figura), ajudando a fechar a lacuna entre as redes neurais totalmente ópticas e as eletrônicas padrão. Uma das principais melhorias incorporou um esquema de detecção diferencial, onde cada pontuação de classe no plano de saída da rede óptica é calculada usando dois detectores diferentes, um representando números positivos e o outro representando números negativos. A classe de objeto correta (por exemplo, carros, aviões, navios, etc.) é inferida pelo par de detectores que tem a maior diferença normalizada entre os detectores positivo e negativo. Este esquema de detecção diferencial também é combinado com redes ópticas difrativas em execução paralela, onde cada um é especializado para reconhecer especificamente um subgrupo de classes de objetos. Este projeto de rede difrativa específico de classe se beneficia significativamente do paralelismo e da escalabilidade dos sistemas ópticos, formando caminhos de luz paralelos dentro de matéria de engenharia 3-D para calcular separadamente as pontuações de classe de diferentes tipos de objetos.

Essas novas estratégias de design alcançaram níveis sem precedentes de precisão de inferência para aprendizado de máquina baseado em rede neural totalmente óptica. Por exemplo, em uma implementação, os pesquisadores da UCLA demonstraram numericamente com precisão de testes cegos de 98,59%, 91,06% e 51,44% para o reconhecimento das imagens de dígitos manuscritos, produtos de moda, e conjunto de dados de imagem em tons de cinza CIFAR-10 (composto de aviões, carros, pássaros, gatos, cervo, cachorros, sapos, cavalos, navios, e caminhões), respectivamente [3]. Para comparação, esses resultados de inferência se aproximam do desempenho de algumas das gerações anteriores de redes neurais profundas totalmente eletrônicas, por exemplo, LeNet, que atinge precisão de classificação de 98,77%, 90,27%, e 55,21% correspondendo aos mesmos conjuntos de dados, respectivamente. Projetos mais recentes de redes neurais eletrônicas, como ResNet, obter um desempenho muito melhor, ainda deixando uma lacuna entre o desempenho das redes neurais totalmente ópticas e eletrônicas. Esta lacuna, Contudo, é equilibrado por importantes vantagens fornecidas por redes neurais totalmente ópticas, como a velocidade de inferência, escalabilidade, paralelismo e o requisito de baixa potência de redes ópticas passivas que utilizam matéria projetada para computar por difração de luz.

Esta pesquisa foi liderada pelo Dr. Aydogan Ozcan, que é Professor Chanceler de Engenharia Elétrica e da Computação na UCLA, e um diretor associado do California NanoSystems Institute (CNSI). Os outros autores deste trabalho são estudantes de graduação Jingxi Li, Deniz Mengu e Yi Luo, bem como o Dr. Yair Rivenson, Professor adjunto de Engenharia Elétrica e de Computação na UCLA.

"Nossos resultados fornecem um grande avanço para trazer soluções de baixa potência e latência baseadas em rede neural óptica para vários aplicativos de aprendizado de máquina, "disse o Prof. Ozcan. Além disso, esses avanços sistemáticos em projetos de redes ópticas difrativas podem nos trazer um passo mais perto do desenvolvimento da próxima geração, sistemas de câmeras computacionais inteligentes e específicos para tarefas.

Esta pesquisa foi apoiada pelo Grupo Koç, NSF e HHMI.