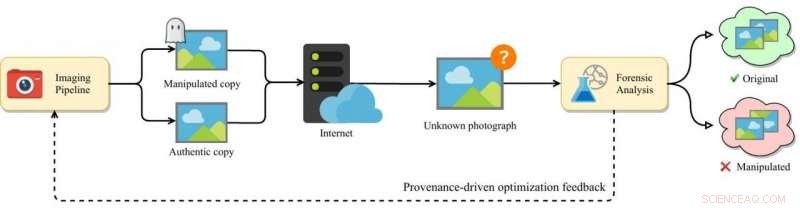

Em testes, um pipeline de protótipo aumentou a capacidade de detectar a manipulação de aproximadamente 45 por cento para mais de 90 por cento sem sacrificar a qualidade da imagem. Crédito:NYU Tandon

Para frustrar métodos sofisticados de alteração de fotos e vídeos, pesquisadores da NYU Tandon School of Engineering demonstraram uma técnica experimental para autenticar imagens em todo o pipeline, da aquisição à entrega, usando inteligência artificial (IA).

Em testes, este pipeline de protótipo de imagem aumentou as chances de detecção de manipulação de aproximadamente 45 por cento para mais de 90 por cento sem sacrificar a qualidade da imagem.

Determinar se uma foto ou vídeo é autêntico está se tornando cada vez mais problemático. Técnicas sofisticadas para alterar fotos e vídeos tornaram-se tão acessíveis que as chamadas "falsificações profundas" - fotos ou vídeos manipulados que são notavelmente convincentes e muitas vezes incluem celebridades ou figuras políticas - se tornaram comuns.

Pawel Korus, professor assistente de pesquisa no Departamento de Ciência da Computação e Engenharia da NYU Tandon, foi pioneira nesta abordagem. Ele substitui o pipeline de desenvolvimento de foto típico por uma rede neural - uma forma de IA - que introduz artefatos cuidadosamente elaborados diretamente na imagem no momento da aquisição da imagem. Esses artefatos, semelhante a "marcas d'água digitais, "são extremamente sensíveis à manipulação.

"Ao contrário das técnicas de marca d'água usadas anteriormente, esses artefatos aprendidos com IA podem revelar não apenas a existência de manipulações de fotos, mas também seu caráter, "Korus disse.

O processo é otimizado para incorporação na câmera e pode sobreviver à distorção de imagem aplicada por serviços de compartilhamento de fotos online.

As vantagens de integrar esses sistemas às câmeras são claras.

"Se a própria câmera produz uma imagem que é mais sensível a adulteração, quaisquer ajustes serão detectados com alta probabilidade, "disse Nasir Memon, professor de ciência da computação e engenharia da NYU Tandon e coautor, com Korus, de um artigo detalhando a técnica. "Essas marcas d'água podem sobreviver ao pós-processamento; no entanto, eles são muito frágeis quando se trata de modificação:se você alterar a imagem, a marca d'água quebra, "Memon disse.

A maioria das outras tentativas de determinar a autenticidade da imagem examina apenas o produto final - uma tarefa notoriamente difícil.

Korus e Memon, por contraste, raciocinou que a imagem digital moderna já depende do aprendizado de máquina. Cada foto tirada em um smartphone passa por um processamento quase instantâneo para se ajustar à luz fraca e estabilizar as imagens, ambos são cortesia da AI a bordo. Nos próximos anos, Os processos orientados por IA provavelmente substituirão totalmente os canais tradicionais de imagem digital. À medida que essa transição ocorre, Memon disse que "temos a oportunidade de mudar drasticamente as capacidades dos dispositivos de próxima geração no que diz respeito à integridade e autenticação de imagens. Os pipelines de imagens otimizados para perícia podem ajudar a restaurar um elemento de confiança em áreas onde a linha entre o real e o falso pode ser difícil desenhar com confiança. "

Korus e Memon observam que, embora sua abordagem seja promissora em testes, é necessário trabalho adicional para refinar o sistema. Esta solução é de código aberto e pode ser acessada em github.com/pkorus/neural-imaging.

Os pesquisadores apresentarão seu trabalho, "Content Authentication for Neural Imaging Pipelines:End-to-end Optimization of Photo Provenance in Complex Distribution Channels, "na Conferência sobre Visão Computacional e Reconhecimento de Padrões em Long Beach, Califórnia, em junho.