Os computadores podem entender palavras e conceitos complexos? Sim, de acordo com a pesquisa

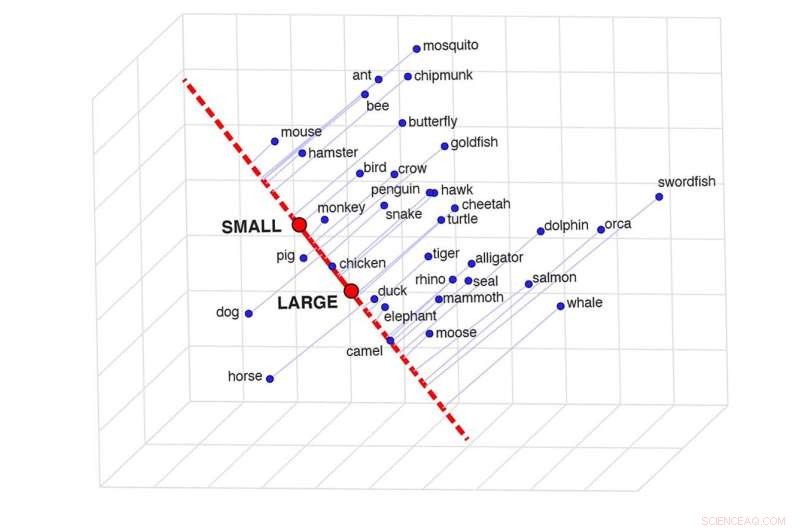

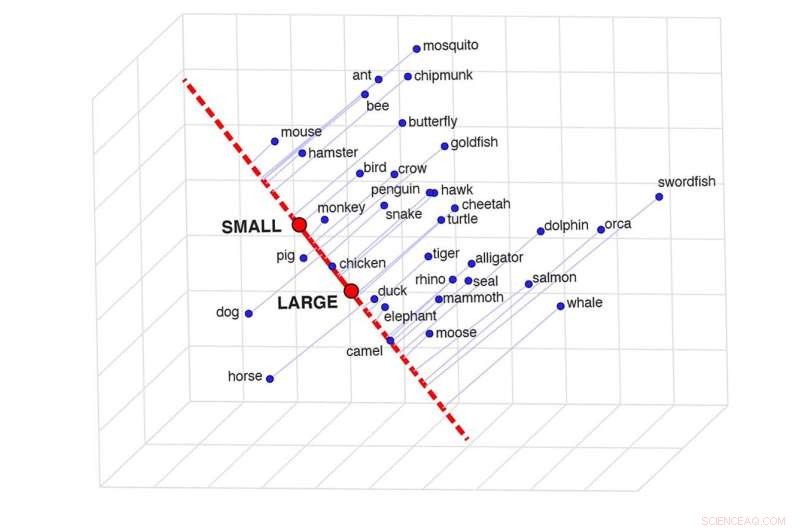

Uma representação da projeção semântica, que pode determinar a semelhança entre duas palavras em um contexto específico. Esta grade mostra como certos animais são semelhantes com base em seu tamanho. Crédito:Idan Blank/UCLA

Em "Through the Looking Glass", Humpty Dumpty diz com desdém:"Quando uso uma palavra, ela significa exatamente o que eu escolho que ela signifique — nem mais nem menos". Alice responde:"A questão é se você pode fazer as palavras significarem tantas coisas diferentes."

O estudo do que as palavras realmente significam é antigo. A mente humana deve analisar uma teia de informações detalhadas e flexíveis e usar o senso comum sofisticado para perceber seu significado.

Agora, surgiu um novo problema relacionado ao significado das palavras:os cientistas estão estudando se a inteligência artificial pode imitar a mente humana para entender as palavras da maneira que as pessoas fazem. Um novo estudo realizado por pesquisadores da UCLA, MIT e dos Institutos Nacionais de Saúde aborda essa questão.

O artigo, publicado na revista

Nature Human Behaviour , relata que os sistemas de inteligência artificial podem realmente aprender significados de palavras muito complicados, e os cientistas descobriram um truque simples para extrair esse conhecimento complexo. Eles descobriram que o sistema de IA que estudaram representa os significados das palavras de uma maneira que se correlaciona fortemente com o julgamento humano.

O sistema de IA que os autores investigaram tem sido frequentemente usado na última década para estudar o significado das palavras. Ele aprende a descobrir o significado das palavras "lendo" quantidades astronômicas de conteúdo na internet, abrangendo dezenas de bilhões de palavras.

Quando as palavras ocorrem frequentemente juntas - "mesa" e "cadeira", por exemplo - o sistema aprende que seus significados estão relacionados. E se pares de palavras ocorrerem juntos muito raramente — como "mesa" e "planeta", ele descobre que eles têm significados muito diferentes.

Essa abordagem parece um ponto de partida lógico, mas considere quão bem os humanos entenderiam o mundo se a única maneira de entender o significado fosse contar com que frequência as palavras ocorrem próximas umas das outras, sem qualquer capacidade de interagir com outras pessoas e nosso ambiente.

Idan Blank, professor assistente de psicologia e linguística da UCLA e co-autor principal do estudo, disse que os pesquisadores decidiram aprender o que o sistema sabe sobre as palavras que aprende e que tipo de “senso comum” ele tem.

Antes do início da pesquisa, disse Blank, o sistema parecia ter uma grande limitação:"No que diz respeito ao sistema, cada duas palavras têm apenas um valor numérico que representa o quão semelhantes são".

Em contraste, o conhecimento humano é muito mais detalhado e complexo.

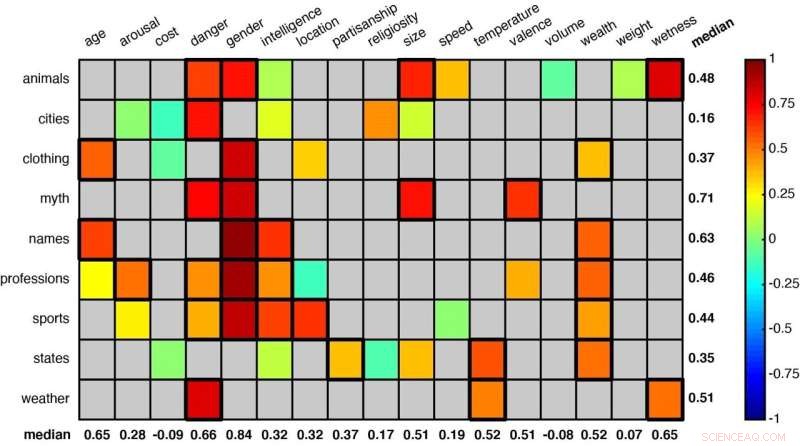

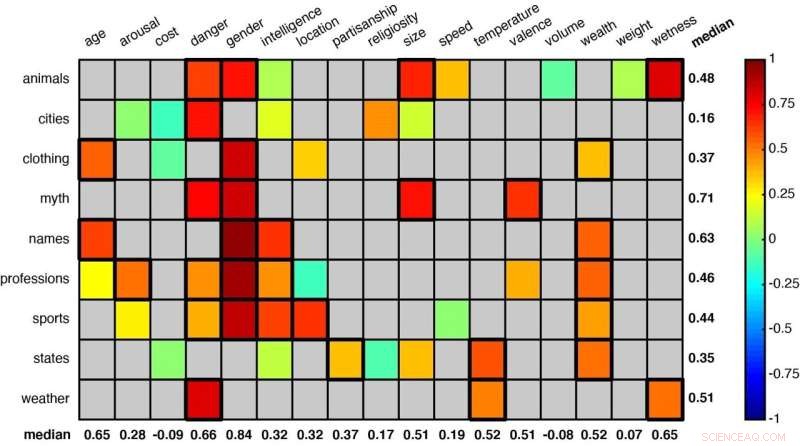

Uma grade representando algumas das categorias de palavras analisadas pelos pesquisadores. Pares estatisticamente significativos (como “animais” e “perigo” e “animais” e “gênero” na primeira linha) são indicados por quadrados com uma borda mais grossa. Crédito:Idan Blank/UCLA

"Considere nosso conhecimento sobre golfinhos e jacarés", disse Blank. "Quando comparamos os dois em uma escala de tamanho, de 'pequeno' a 'grande', eles são relativamente semelhantes. Em termos de inteligência, eles são um pouco diferentes. Em termos do perigo que representam para nós, em uma escala de 'seguro' a 'perigoso', eles diferem muito, então o significado de uma palavra depende do contexto.

"Queríamos perguntar se esse sistema realmente conhece essas diferenças sutis - se sua ideia de semelhança é flexível da mesma forma que é para humanos".

Para descobrir, os autores desenvolveram uma técnica que chamam de "projeção semântica". Pode-se traçar uma linha entre as representações do modelo das palavras "grande" e "pequeno", por exemplo, e ver onde as representações de diferentes animais caem nessa linha.

Usando esse método, os cientistas estudaram 52 grupos de palavras para ver se o sistema poderia aprender a classificar os significados – como julgar os animais pelo tamanho ou quão perigosos são para os humanos, ou classificar os estados dos EUA pelo clima ou pela riqueza geral.

Entre os outros agrupamentos de palavras estavam termos relacionados a roupas, profissões, esportes, criaturas mitológicas e nomes próprios. Cada categoria recebeu vários contextos ou dimensões – tamanho, perigo, inteligência, idade e velocidade, por exemplo.

Os pesquisadores descobriram que, nesses muitos objetos e contextos, seu método se mostrou muito semelhante à intuição humana. (Para fazer essa comparação, os pesquisadores também pediram a coortes de 25 pessoas cada para fazer avaliações semelhantes sobre cada um dos 52 grupos de palavras.)

Notavelmente, o sistema aprendeu a perceber que os nomes "Betty" e "George" são semelhantes em termos de serem relativamente "velhos", mas que representavam gêneros diferentes. E que "levantamento de peso" e "esgrima" são semelhantes, pois ambos geralmente ocorrem em ambientes fechados, mas diferentes em termos de quanta inteligência eles exigem.

"É um método tão lindamente simples e completamente intuitivo", disse Blank. "A linha entre 'grande' e 'pequeno' é como uma escala mental, e colocamos os animais nessa escala."

Blank disse que na verdade não esperava que a técnica funcionasse, mas ficou encantado quando funcionou.

“Acontece que esse sistema de aprendizado de máquina é muito mais inteligente do que pensávamos; contém formas muito complexas de conhecimento, e esse conhecimento é organizado em uma estrutura muito intuitiva”, disse ele. "Apenas acompanhando quais palavras ocorrem umas com as outras na linguagem, você pode aprender muito sobre o mundo."

Os co-autores do estudo são a neurocientista cognitiva do MIT Evelina Fedorenko, o estudante de pós-graduação do MIT Gabriel Grand e Francisco Pereira, que lidera a equipe de aprendizado de máquina do Instituto Nacional de Saúde Mental dos Institutos Nacionais de Saúde.