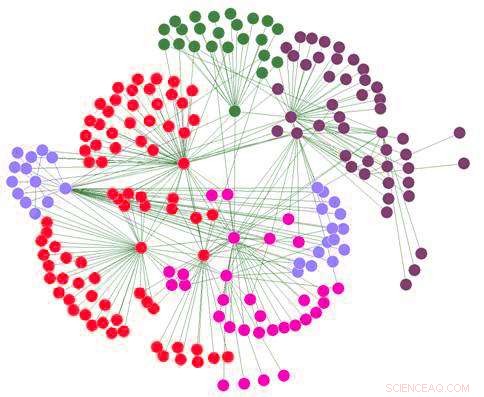

Diagrama de rede social. Crédito:Daniel Tenerife / Wikipedia

Usuários banidos de plataformas sociais vão para outro lugar com maior toxicidade, de acordo com um novo estudo com pesquisadores da Binghamton University, Universidade Estadual de Nova York.

Quando as pessoas agem como idiotas nas redes sociais, uma resposta permanente é proibi-los de postar novamente. Tire o megafone digital, a teoria vai, e as mensagens ofensivas ou desonestas desses criadores de problemas não postarão mais um problema lá.

O que acontece depois disso, no entanto? Para onde vão aqueles que foram 'deplatados', e como isso afeta seu comportamento no futuro?

Uma equipe internacional de pesquisadores - incluindo o professor assistente Jeremy Blackburn e Ph.D. A candidata Esraa Aldreabi do Departamento de Ciência da Computação da Thomas J. Watson College of Engineering e Applied Science - explora essas questões em um novo estudo chamado "Understanding the Effect of Deplatforming on Social Networks."

A pesquisa realizada por colaboradores do iDRAMA Lab na Binghamton University, Universidade de Boston, O University College London e o Max Planck Institute for Informatics na Alemanha foram apresentados em junho no Conferência de 2021 ACM Web Science .

Os pesquisadores desenvolveram um método para identificar contas pertencentes à mesma pessoa em diferentes plataformas e descobriram que ser banido no Reddit ou no Twitter levou esses usuários a aderir a plataformas alternativas como Gab ou Parler, onde a moderação de conteúdo é mais frouxa.

Também entre as descobertas está que, embora os usuários que mudam para essas plataformas menores tenham um público potencialmente reduzido, eles exibem um maior nível de atividade e toxicidade do que antes.

"Você não pode simplesmente banir essas pessoas e dizer, 'Ei, funcionou.' Eles não desaparecem, - disse Blackburn. - Eles vão para outros lugares. Isso tem um efeito positivo na plataforma original, mas também há algum grau de amplificação ou piora desse tipo de comportamento em outros lugares. "

O estudo deprimente coletou 29 milhões de postagens de Gab, que foi lançado em 2016 e atualmente tem cerca de 4 milhões de usuários. Gab é conhecido por sua base de extrema direita de neonazistas, nacionalistas brancos, anti-semitas e teóricos da conspiração QAnon.

Usando uma combinação de aprendizado de máquina e rotulagem humana, os pesquisadores cruzaram nomes de perfis e conteúdos com usuários que estavam ativos no Twitter e Reddit, mas foram suspensos. Muitos que estão deplataformas reutilizam o mesmo nome de perfil ou informações de usuário em uma plataforma diferente para continuidade e reconhecimento com seus seguidores.

"Só porque duas pessoas têm o mesmo nome ou nome de usuário, isso não é uma garantia, "Blackburn disse." Houve um grande processo de criação de um conjunto de dados 'verdadeiros', onde tivemos um humano a dizer, 'Estas têm que ser as mesmas pessoas por este motivo e aquele motivo.' Isso nos permite dimensionar as coisas, jogando-o em um classificador de aprendizado de máquina [programa] que aprenderá as características a serem observadas. "

O processo não era diferente de como os estudiosos determinam a identidade dos autores para obras não atribuídas ou pseudônimas, verificando o estilo, sintaxe e assunto, ele adicionou.

No conjunto de dados analisado para este estudo, cerca de 59% dos usuários do Twitter (1, 152 de 1, 961) criaram contas Gab após sua última vez ativa no Twitter, presumivelmente depois que sua conta foi suspensa. Para Reddit, cerca de 76% (3, 958 de 5, 216) de usuários suspensos criaram contas no Gab após sua última postagem no Reddit.

Comparando o conteúdo dos mesmos usuários no Twitter e Reddit com o Gab, os usuários tendem a se tornar mais tóxicos quando são suspensos de uma plataforma e forçados a mudar para outra plataforma. Eles também se tornam mais ativos, aumentando a frequência de postagens.

Ao mesmo tempo, a audiência do conteúdo dos usuários do Gab é limitada pelo tamanho reduzido da plataforma em comparação com os milhões de usuários no Twitter e Reddit. Isso pode ser visto como uma coisa boa, mas Blackburn advertiu que grande parte do planejamento para o ataque de 6 de janeiro ao Capitólio dos EUA aconteceu em Parler, uma plataforma semelhante ao Gab com uma base de usuários menor que inclina para a direita alternativa e extrema direita.

"Reduzir o alcance provavelmente é uma coisa boa, mas o alcance pode ser facilmente mal interpretado. Só porque alguém tem 100, 000 seguidores não significa que todos são seguidores no mundo real, " ele disse.

"O grupo de hardcore, talvez o grupo que mais nos preocupa, são aqueles que provavelmente ficarão com alguém se ele se mudar para outro lugar online. Se reduzindo esse alcance, você aumenta a intensidade a que as pessoas que ficam por perto são expostas, é como uma questão do tipo qualidade versus quantidade. É pior ter mais pessoas vendo essas coisas? Ou é pior ter coisas mais radicais sendo produzidas para menos pessoas? "

Um estudo separado, "Um grande conjunto de dados aberto da Rede Social Parler, "também incluiu Blackburn entre os pesquisadores da Universidade de Nova York, a Universidade de Illinois, University College London, Universidade de Boston e Instituto Max Planck.

Apresentado na Conferência AAAI sobre Web e Mídia Social no mês passado, analisou 183 milhões de postagens de Parler feitas por 4 milhões de usuários entre agosto de 2018 e janeiro de 2021, bem como metadados de 13,25 milhões de perfis de usuários. Os dados confirmam que os usuários do Parler - que fechou brevemente e foi retirado das lojas de aplicativos da Apple e do Google em resposta ao tumulto no Capitólio - apoiaram amplamente o presidente Donald Trump e sua agenda "Torne a América Grande Novamente".

"Independentemente do que Parler possa ter dito, publicamente ou não, era muito claramente branco, ASA direita, Apoiadores de Christian Trump, "Blackburn disse." De novo, sem surpresa, teve seu maior impulso logo na eleição de 2020 - até um milhão de usuários aderindo. Então, em torno do ataque ao Capitol, houve outro grande aumento no número de usuários. O que podemos ver é que estava claramente sendo usado como uma ferramenta de organização para a insurreição. "

Então, se banir usuários não é a resposta certa, o que é? Administradores do Reddit, por exemplo, tem um recurso de "proibição de sombra" que permite que usuários problemáticos pensem que ainda estão postando no site, exceto que ninguém mais pode vê-los. Durante as eleições de 2020 e a pandemia COVID-19, O Twitter adicionou rótulos de moderação de conteúdo aos tweets que deliberadamente espalhavam desinformação.

Blackburn não tem certeza sobre todas as ferramentas de moderação que as plataformas de mídia social têm disponíveis, mas ele acha que é necessário haver mais "soluções sociotécnicas para problemas sociotécnicos", em vez de apenas banimento total.

"A sociedade agora está dizendo com bastante firmeza que não podemos ignorar essas coisas - não podemos mais simplesmente usar as saídas fáceis, "disse ele." Precisamos ter algumas ideias mais criativas para não nos livrarmos das pessoas, mas, com sorte, empurre-os em uma direção positiva ou, pelo menos, certifique-se de que todos estão cientes de quem essa pessoa é. Algum lugar entre o acesso irrestrito e a proibição de todos é provavelmente a solução certa. "