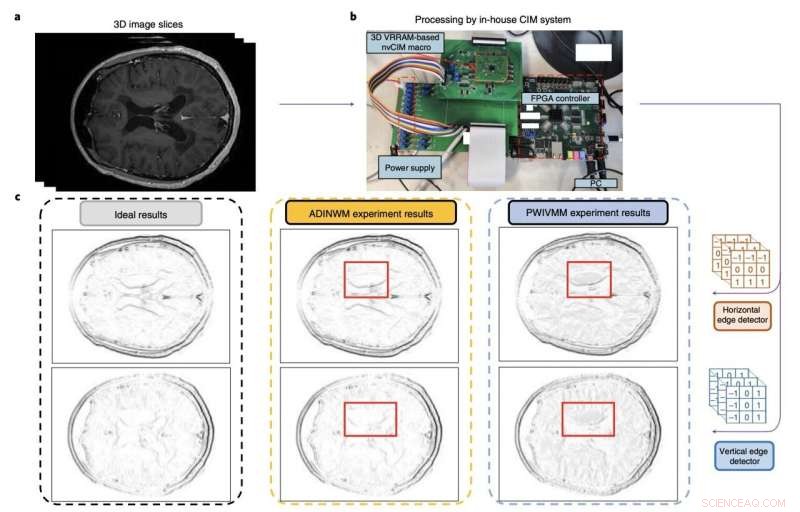

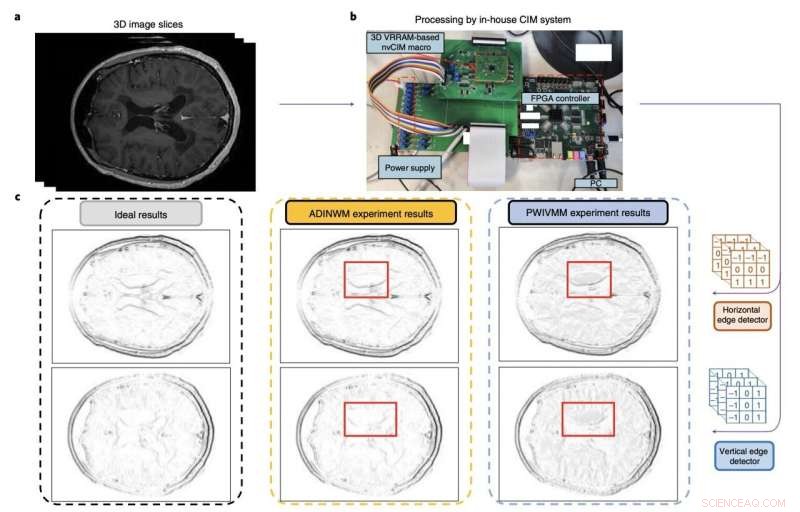

Figura que resume a avaliação e o desempenho da macro de computação em memória dos pesquisadores. Crédito:Huo et al (Nature Electronics , 2022).

Arquiteturas de aprendizado de máquina baseadas em redes neurais convolucionais (CNNs) provaram ser altamente valiosas para uma ampla gama de aplicações, desde visão computacional até análise de imagens e processamento ou geração de linguagem humana. Para lidar com tarefas mais avançadas, no entanto, essas arquiteturas estão se tornando cada vez mais complexas e computacionalmente exigentes.

Nos últimos anos, muitos engenheiros eletrônicos em todo o mundo têm tentado desenvolver dispositivos que possam suportar o armazenamento e a carga computacional de arquiteturas complexas baseadas em CNN. Isso inclui dispositivos de memória mais densos que podem suportar grandes quantidades de pesos (ou seja, os parâmetros treináveis e não treináveis considerados pelas diferentes camadas de CNNs).

Pesquisadores da Academia Chinesa de Ciências, do Instituto de Tecnologia de Pequim e de outras universidades da China desenvolveram recentemente um novo sistema de computação em memória que pode ajudar a executar modelos mais complexos baseados em CNN com mais eficiência. Seu componente de memória, introduzido em um artigo publicado na

Nature Electronics , é baseado em macros de computação em memória não voláteis feitas de matrizes de memristor 3D.

“Escalar esses sistemas para matrizes 3D pode fornecer maior paralelismo, capacidade e densidade para as operações necessárias de multiplicação de matrizes vetoriais”, escreveram Qiang Huo e seus colegas em seu artigo. "No entanto, dimensionar para três dimensões é um desafio devido a problemas de fabricação e variabilidade de dispositivos. Relatamos uma macro de computação em memória não volátil de dois kilobits que é baseada em uma memória de acesso aleatório resistiva vertical tridimensional fabricada usando um 55 nm processo complementar de metal-óxido-semicondutor."

As memórias resistivas de acesso aleatório, ou RRAMs, são dispositivos de armazenamento não voláteis (ou seja, retêm dados mesmo após interrupções na fonte de alimentação) baseados em memristores. Memristores são componentes eletrônicos que podem limitar ou regular o fluxo de corrente elétrica em circuitos, enquanto registram a quantidade de carga que anteriormente fluía através deles.

As RRAMs funcionam essencialmente variando a resistência em um memristor. Embora estudos anteriores tenham demonstrado o grande potencial desses dispositivos de memória, as versões convencionais desses dispositivos são separadas dos mecanismos de computador, o que limita suas possíveis aplicações.

Os dispositivos RRAM de computação em memória foram projetados para superar essa limitação, incorporando os cálculos dentro da memória. Isso pode reduzir bastante a transferência de dados entre memórias e processadores, melhorando a eficiência energética geral do sistema.

O dispositivo de computação em memória criado por Huo e seus colegas é uma RRAM 3D com camadas empilhadas verticalmente e circuitos periféricos. Os circuitos do dispositivo foram fabricados usando a tecnologia CMOS de 55 nm, a tecnologia que sustenta a maioria dos circuitos integrados no mercado hoje.

Os pesquisadores avaliaram seu dispositivo usando-o para realizar operações complexas e executar um modelo para detectar bordas em exames de ressonância magnética do cérebro. A equipe treinou seus modelos usando dois conjuntos de dados de ressonância magnética existentes para treinar ferramentas de reconhecimento de imagem, conhecidos como conjuntos de dados MNIST e CIFAR-10.

"Nossa macro pode executar operações de multiplicação de matriz de vetor 3D com uma eficiência energética de 8,32 tera-operações por segundo por watt quando os dados de entrada, peso e saída são de 8,9 e 22 bits, respectivamente, e a densidade de bits é de 58,2 bits µm

–2

", escreveram os pesquisadores em seu artigo. "Nós mostramos que a macro oferece detecção de borda de ressonância magnética cerebral mais precisa e precisão de inferência melhorada no conjunto de dados CIFAR-10 do que os métodos convencionais".

Nos testes iniciais, o sistema RRAM vertical de computação em memória criado por Huo e seus colegas alcançou resultados notáveis, superando as abordagens convencionais de RRAM. No futuro, pode ser altamente valioso para executar modelos complexos baseados em CNN com mais eficiência energética, além de permitir melhores precisões e desempenhos.

+ Explorar mais Uma macro nvCIM de quatro megabits para dispositivos Edge AI

© 2022 Science X Network