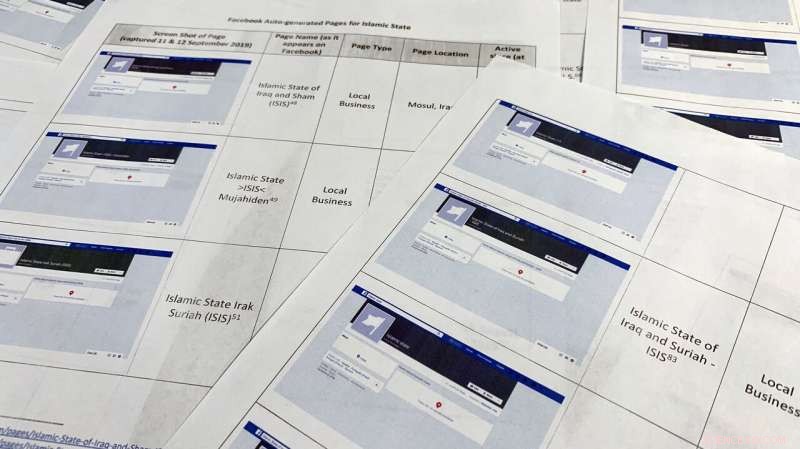

Páginas do relatório de um denunciante confidencial obtido pela The Associated Press, junto com duas páginas impressas do Facebook que estavam ativas na terça-feira, 17 de setembro, 2019, são fotografados em Washington. O Facebook gosta de dizer que seus sistemas automatizados removem a grande maioria do conteúdo proibido que glorifica o grupo do Estado Islâmico e a Al Qaeda antes de ser relatado. Mas a reclamação de um denunciante mostra que o próprio Facebook produziu inadvertidamente dezenas de páginas em seus nomes. (AP Photo / Jon Elswick)

Diante das críticas de que o Facebook não está fazendo o suficiente para combater as mensagens extremistas, a empresa gosta de dizer que seus sistemas automatizados removem a grande maioria do conteúdo proibido que glorifica o grupo do Estado Islâmico e a Al Qaeda antes de ser divulgado.

Mas a reclamação de um denunciante mostra que o próprio Facebook inadvertidamente forneceu aos dois grupos extremistas uma ferramenta de networking e recrutamento ao produzir dezenas de páginas em seus nomes.

A empresa de rede social parece ter feito pouco progresso no assunto nos quatro meses desde que a The Associated Press detalhou como as páginas que o Facebook gera automaticamente para empresas estão ajudando extremistas do Oriente Médio e supremacistas brancos nos Estados Unidos.

Na quarta-feira, Senadores dos EUA no Comitê de Comércio, Ciência, e Transporte questionará representantes de empresas de mídia social, incluindo Monika Bickert, que lidera os esforços do Facebook para conter mensagens extremistas.

Os novos detalhes vêm de uma atualização de uma queixa à Comissão de Valores Mobiliários e Câmbio que o National Whistleblower Center planeja registrar esta semana. O pedido obtido pela AP identifica quase 200 páginas geradas automaticamente - algumas para empresas, outros para escolas ou outras categorias - que fazem referência direta ao grupo do Estado Islâmico e dezenas de outros representantes da Al Qaeda e outros grupos conhecidos. Uma página listada como uma "ideologia política" é intitulada "Eu amo o estado islâmico". Ele apresenta um logotipo IS dentro dos contornos do famoso ícone de polegar para cima do Facebook.

Em resposta a um pedido de comentário, um porta-voz do Facebook disse à AP:"Nossa prioridade é detectar e remover conteúdo postado por pessoas que violam nossa política contra indivíduos e organizações perigosas para ficar à frente de malfeitores. As páginas geradas automaticamente não são como as páginas normais do Facebook, pois as pessoas não podem comentar ou postamos neles e removemos todos os que violam nossas políticas. Embora não possamos pegar todos, permanecemos vigilantes neste esforço. "

O Facebook tem uma série de funções que geram páginas automaticamente a partir de conteúdo postado por usuários. A reclamação atualizada examina uma função que se destina a ajudar a rede de negócios. Ele extrai informações de emprego das páginas dos usuários para criar páginas para empresas. Nesse caso, pode estar ajudando os grupos extremistas porque permite que os usuários gostem das páginas, potencialmente fornecendo uma lista de simpatizantes para os recrutadores.

Páginas do relatório de um denunciante confidencial obtido pela The Associated Press, são fotografados em Washington, na terça-feira, 17 de setembro, 2019. O Facebook gosta de dizer que seus sistemas automatizados removem a grande maioria do conteúdo proibido que glorifica o grupo do Estado Islâmico e a Al Qaeda antes de ser relatado. Mas a reclamação de um denunciante mostra que o próprio Facebook produziu inadvertidamente dezenas de páginas em seus nomes. (AP Photo / Jon Elswick)

O novo documento também descobriu que as páginas dos usuários que promovem grupos extremistas continuam fáceis de encontrar com pesquisas simples usando seus nomes. Eles descobriram uma página de "Mohammed Atta" com uma foto icônica de um dos adeptos da Al Qaeda, que foi um sequestrador nos ataques de 11 de setembro. A página lista o trabalho do usuário como "Al Qaidah" e a educação como "Mestre da Universidade Bin Laden" e "Escola Terrorista do Afeganistão".

O Facebook tem trabalhado para limitar a disseminação de material extremista em seu serviço, até agora com sucesso misto. Em março, expandiu sua definição de conteúdo proibido para incluir material nacionalista branco dos EUA e separatista branco, bem como de grupos extremistas internacionais. Diz que proibiu 200 organizações de supremacia branca e 26 milhões de peças de conteúdo relacionadas a grupos extremistas globais como o IS e a Al Qaeda.

Também expandiu sua definição de terrorismo para incluir não apenas atos de violência com o objetivo de atingir um objetivo político ou ideológico, mas também tentativas de violência, especialmente quando dirigido a civis com a intenção de coagir e intimidar. Não está claro, no entanto, quão bem a fiscalização funciona se a empresa ainda está tendo problemas para livrar sua plataforma de apoiadores de organizações extremistas conhecidas.

Mas, como mostra o relatório, muito material passa pelas rachaduras - e é gerado automaticamente.

A história da AP em maio destacou o problema de geração automática, mas o novo conteúdo identificado no relatório sugere que o Facebook não o resolveu.

O relatório também diz que os pesquisadores descobriram que muitas das páginas referenciadas no relatório da AP foram removidas mais de seis semanas depois, em 25 de junho, um dia antes de Bickert ser questionado para outra audiência no Congresso.

O problema foi sinalizado na reclamação inicial da SEC apresentada pelo diretor executivo do centro, John Kostyack, que alega que a empresa de mídia social exagerou seu sucesso no combate a mensagens extremistas.

"O Facebook gostaria que acreditássemos que seus algoritmos mágicos estão de alguma forma eliminando o conteúdo extremista de seu site, "Kostyack disse." No entanto, esses mesmos algoritmos são páginas de geração automática com títulos como 'Eu Amo o Estado Islâmico, 'que são ideais para terroristas usarem para networking e recrutamento. "

© 2019 Associated Press. Todos os direitos reservados.