Crédito:Egor Zakharov et al.

Um artigo que discute um feito de inteligência artificial agora no arXiv está dando aos observadores de tecnologia mais uma razão para sentir que esta é a Era do Medo.

"Few-Shot Adversarial Learning of Realistic Neural Talking Head Models" por Egor Zakharov, Aliaksandra Shysheya, Egor Burkov e Victor Lempitsky revelam sua técnica que pode transformar fotos e pinturas em cabeças falantes animadas. As afiliações do autor incluem o Samsung AI Center, Moscou e o Instituto Skolkovo de Ciência e Tecnologia.

O jogador-chave em tudo isso? Samsung. Abriu centros de pesquisa em Moscou, Cambridge e Toronto no ano passado e o resultado final podem muito bem ser mais manchetes na história da IA.

Sim, a Mona Lisa pode parecer que está contando ao apresentador de TV por que prefere os condicionadores de cabelo sem enxágue. Albert Einstein pode parecer que está falando a favor de nenhum produto para o cabelo.

Eles escreveram que "consideramos o problema de sintetizar imagens fotorrealistas personalizadas da cabeça a partir de um conjunto de pontos de referência do rosto, que conduzem a animação do modelo. "Uma cena, aprendendo a partir de um único quadro, até, é possível.

Khari Johnson, VentureBeat , observou que eles podem gerar cabeças falantes animadas realistas a partir de imagens sem contando com métodos tradicionais, como modelagem 3D.

Os autores destacaram que "Crucialmente, o sistema é capaz de inicializar os parâmetros do gerador e do discriminador de uma forma específica de pessoa, para que o treinamento possa ser baseado em apenas algumas imagens e feito rapidamente, apesar da necessidade de ajustar dezenas de milhões de parâmetros. "

Qual é a abordagem deles? Ivan Mehta em The Next Web guiou os leitores pelas etapas que formam sua técnica.

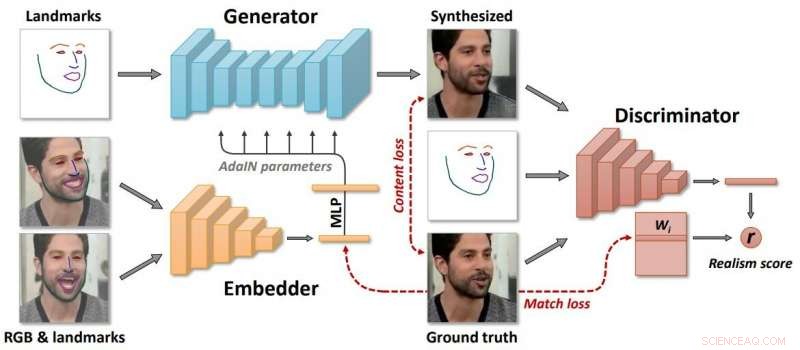

"A Samsung disse que o modelo cria três redes neurais durante o processo de aprendizagem. Primeiro, ele cria uma rede incorporada que vincula quadros relacionados a pontos de referência de rosto com vetores. Então, usando esses dados, o sistema cria uma rede geradora que mapeia pontos de referência nos vídeos sintetizados. Finalmente, a rede discriminadora avalia o realismo e a pose dos quadros gerados. "

Os autores descreveram "meta-aprendizagem longa" em um grande conjunto de dados de vídeos, e capaz de enquadrar o aprendizado de poucos e de uma vez de modelos de cabeças falantes neurais de pessoas até então invisíveis como problemas de treinamento de adversários, com geradores e discriminadores de alta capacidade.

Quem realmente usaria este sistema? Relatórios mencionaram telepresença, jogos multijogador e a indústria de efeitos especiais.

Apesar disso, Johnson e outros que apresentaram seus relatórios não estavam dispostos a ignorar o risco de avanços tecnológicos nas mãos erradas, onde o travesso pode produzir falsificações com más intenções.

"Essa tecnologia também pode ser usada para criar deepfakes, "Johnson escreveu.

Então, podemos querer fazer uma pausa nesse pensamento. Só que os escritores agora se referem tão casualmente aos resultados "falsos profundos" que surgem de alguns projetos de inteligência artificial. E os escritores estão se perguntando o que esse passo da Samsung em tecnologia pode significar em deepfakes.

Jon Christian teve uma visão geral em Futurismo . "Ao longo dos últimos anos, vimos o rápido crescimento da tecnologia 'deepfake' que usa aprendizado de máquina para analisar imagens de pessoas reais - e então produzir um vídeo convincente delas fazendo coisas que nunca fizeram ou dizendo coisas que nunca disseram. "

Joan Solsman em CNET:"O rápido avanço da inteligência artificial significa que sempre que um pesquisador compartilha um avanço na criação deepfake, maus atores podem começar a juntar suas próprias ferramentas de júri para imitá-lo. "

Interessantemente, quanto mais o público fica sabendo da falsificação de IA, mais facilmente eles podem aceitar que algumas animações são falsas - ou não? Um comentário de um espectador na página do vídeo:"No futuro, chantagear é impossível porque todos sabem que você pode criar facilmente um vídeo a partir de qualquer coisa. "

© 2019 Science X Network