Alex Jones afirmou que ser desplataformado prejudicou sua renda. Crédito:Vic Hinterlang/Shutterstock

O teórico da conspiração e personalidade da mídia de extrema direita dos EUA, Alex Jones, foi recentemente condenado a pagar US $ 45 milhões (£ 37 milhões) por danos à família de uma criança morta no tiroteio na escola de Sandy Hook em 2012.

Jones alegou que ser banido ou "desplataformado" de grandes sites de mídia social por suas visões extremas o afetou negativamente financeiramente, comparando a situação à "prisão". Mas durante o julgamento, o economista forense Bernard Pettingill estimou que o site de conspiração de Jones, InfoWars, ganhou mais dinheiro depois de ser banido do Facebook e do Twitter em 2018.

Então, a desplataformação online realmente funciona? Não é possível medir a influência de forma cientificamente rigorosa, por isso é difícil dizer o que acontece com a influência geral de uma pessoa ou grupo quando eles são desplatformados. No geral, a pesquisa sugere que a desplataforma pode reduzir a atividade de atores nefastos nesses sites. No entanto, ele vem com um preço. À medida que pessoas e grupos desplataformados migram para outros lugares, eles podem perder seguidores, mas também se tornar mais odiosos e tóxicos.

Normalmente, a desplataforma envolve ações tomadas pelos próprios sites de mídia social. Mas isso pode ser feito por terceiros como as instituições financeiras que prestam serviços de pagamento nessas plataformas, como o PayPal.

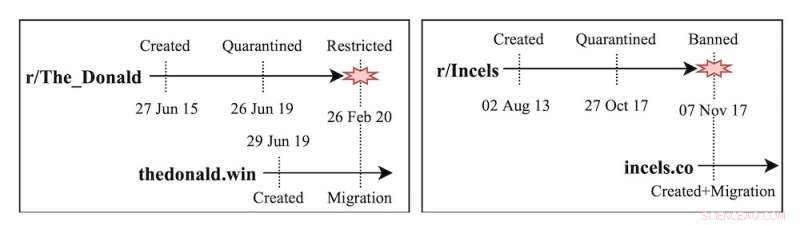

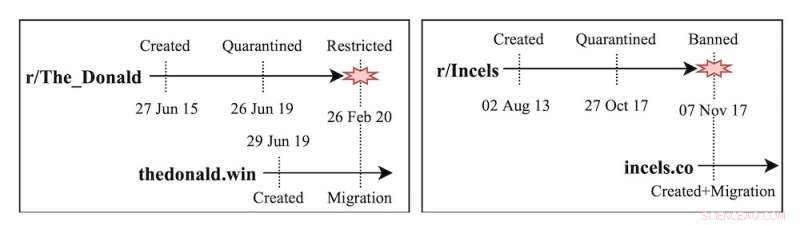

Fechar um grupo também é uma forma de desplataforma, mesmo que as pessoas ainda estejam livres para usar os sites. Por exemplo, o subreddit The_Donald (um fórum no site Reddit) foi fechado por hospedar conteúdo odioso e ameaçador, como uma postagem incentivando os membros a participar de um comício de supremacia branca.

Tramas de Jhaver em al. Postar níveis de atividade e pontuações graves de toxicidade dos apoiadores de três celebridades do Twitter desplataformadas antes e depois da desplataforma.

Desplataformar funciona? Pesquisas mostram que a desplataformação tem efeitos positivos na plataforma da qual a pessoa ou grupo foi expulso. Quando o Reddit baniu certos fóruns que vitimavam pessoas com excesso de peso e afro-americanos, muitos usuários ativos nesses subreddits odiosos pararam de postar no Reddit completamente. Aqueles que permaneceram ativos postaram conteúdo menos extremo.

Mas o grupo ou pessoa desplataformada pode migrar. Alex Jones continua trabalhando fora das principais redes sociais, operando principalmente através de seu site InfoWars e podcasts. A proibição da big tech pode ser vista como punição por desafiar o status quo de maneira não censurada, reforçando os laços e o sentimento de pertencimento entre os seguidores.

O Gab foi criado como uma rede social alternativa em 2016, acolhendo usuários que foram banidos de outras plataformas. Desde a insurreição no Capitólio dos EUA, Gab tem twittado sobre essas proibições como um distintivo de honra, e disse que houve um aumento nos usuários e pedidos de emprego.

A pesquisa da minha equipe analisou os subreddits The_Donald e Incels (uma comunidade online masculina hostil às mulheres), que mudou para sites independentes depois de ser banido do Reddit. Descobrimos que, à medida que comunidades perigosas migravam para diferentes plataformas, suas pegadas se tornavam menores, mas os usuários ficavam significativamente mais extremos. Da mesma forma, os usuários que foram banidos do Twitter ou Reddit mostraram um aumento no nível de atividade e toxicidade ao se mudar para o Gab.

Outros estudos sobre o nascimento de redes sociais marginais como Gab, Parler ou Gettr encontraram padrões relativamente semelhantes. Essas plataformas se comercializam como bastiões da liberdade de expressão, acolhendo usuários banidos ou suspensos de outras redes sociais. Pesquisas mostram que não apenas o extremismo aumenta como resultado da moderação frouxa, mas também que os primeiros usuários do site têm uma influência desproporcional na plataforma.

As consequências não intencionais da desplataforma não se limitam às comunidades políticas, mas se estendem a desinformação em saúde e grupos de teoria da conspiração. Por exemplo, quando o Facebook baniu grupos que discutiam vacinas contra a COVID-19, os usuários acessaram o Twitter e postaram ainda mais conteúdo antivacina.

Cronogramas de criação, quarentena e banimento dos subreddits Incels e The_Donald.

Soluções alternativas O que mais pode ser feito para evitar a concentração de ódio online que a desplataforma pode encorajar? As redes sociais vêm experimentando intervenções de moderação suave que não removem conteúdo ou proíbem usuários. Eles limitam a visibilidade do conteúdo (banimento de sombra), restringem a capacidade de outros usuários se envolverem com o conteúdo (respondendo ou compartilhando) ou adicionam rótulos de aviso.

Essas abordagens estão mostrando resultados animadores. Alguns rótulos de aviso levaram os usuários do site a desmascarar alegações falsas. A moderação suave às vezes reduz as interações do usuário e o extremismo nos comentários.

No entanto, há potencial para viés de popularidade (agir ou ignorar o conteúdo com base no burburinho em torno dele) sobre quais assuntos plataformas como o Twitter decidem intervir. Enquanto isso, os rótulos de aviso parecem funcionar com menos eficácia para postagens falsas se forem de direita.

Também ainda não está claro se a moderação suave cria caminhos adicionais para o assédio, por exemplo, zombando de usuários que recebem rótulos de aviso em suas postagens ou agravando usuários que não podem compartilhar novamente o conteúdo.

Exemplos de moderação suave no Twitter:rótulos de aviso e proibição de sombra.

Ansioso Um aspecto crucial da desplataforma é o tempo. Quanto mais cedo as plataformas agirem para impedir que os grupos usem as plataformas convencionais para desenvolver movimentos extremistas, melhor. A ação rápida poderia, em teoria, frear os esforços dos grupos para reunir e radicalizar grandes bases de usuários.

Mas isso também precisaria de um esforço coordenado das principais plataformas e de outras mídias para funcionar. Os talk shows de rádio e as notícias a cabo desempenham um papel crucial na promoção de narrativas marginais nos EUA.

Precisamos de um diálogo aberto sobre a troca de plataformas. Como sociedade, precisamos discutir se nossas comunidades devem ter menos pessoas expostas a grupos extremistas, mesmo que aqueles que se engajam se tornem cada vez mais isolados e radicalizados.

Atualmente, a desplataformação é administrada quase que exclusivamente por grandes empresas de tecnologia. As empresas de tecnologia não podem resolver o problema sozinhas, mas pesquisadores ou políticos também não. As plataformas devem trabalhar com reguladores, organizações de direitos civis e pesquisadores para lidar com conteúdo online extremo. O tecido da sociedade pode depender disso.

+ Explorar mais É preciso repensar para impedir a disseminação de material odioso online

Este artigo é republicado de The Conversation sob uma licença Creative Commons. Leia o artigo original.