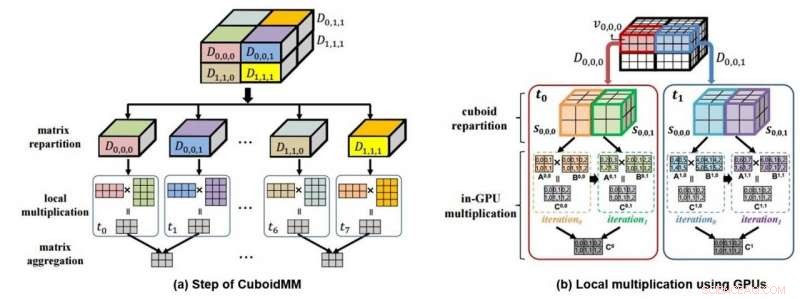

Este é um diagrama mimético (a) da multiplicação de dados 3D através do CuboidMM e um diagrama mimético (b) da computação de processamento de dados usando GPU. Crédito:DGIST

A DGIST anunciou em 4 de julho que a equipe do Professor Min-Soo Kim no Departamento de Engenharia da Informação e Comunicação desenvolveu a tecnologia DistME (Distributed Matrix Engine) que pode analisar 100 vezes mais dados 14 vezes mais rápido do que as tecnologias existentes. Espera-se que essa nova tecnologia seja usada em aprendizado de máquina que precisa de processamento de big data ou vários campos da indústria para analisar dados em grande escala no futuro.

Dados de 'matriz', que expressa números em linha e coluna, é a forma de dados mais amplamente usada em vários campos, como aprendizado de máquina e tecnologia científica. Enquanto 'SystemML' e 'ScaLAPACK' são avaliados como as tecnologias mais populares para analisar dados de matriz, mas a capacidade de processamento da tecnologia existente atingiu recentemente seus limites com o tamanho crescente dos dados. É especialmente difícil fazer multiplicações, que são necessários para o processamento de dados, para análise de big data com os métodos existentes porque eles não podem realizar análise e processamento elásticos e requerem uma grande quantidade de transferência de dados de rede para processamento.

Em resposta, A equipe do professor Kim desenvolveu um método de multiplicação de matrizes distribuídas diferente do existente. Também chamado de CuboidMM, este método forma a multiplicação de matrizes em um hexaedro 3-D e, em seguida, particiona e processa em várias partes chamadas cubóides. O tamanho ideal do cubóide é determinado de forma flexível, dependendo das características das matrizes, ou seja, o tamanho, a dimensão, e dispersão da matriz, de forma a minimizar o custo de comunicação. CuboidMM não apenas inclui todos os métodos existentes, mas também pode realizar a multiplicação de matrizes com um custo mínimo de comunicação. Além disso, A equipe do professor Kim desenvolveu uma tecnologia de processamento de informações combinando-a com a GPU (Unidade de Processamento de Gráficos) que melhorou drasticamente o desempenho da multiplicação de matrizes.

A tecnologia DistME desenvolvida pela equipe do professor Kim aumentou a velocidade de processamento combinando CuboidMM com GPU, que é 6,5 e 14 vezes mais rápido do que ScaLAPACK e SystemML, respectivamente, e pode analisar dados de matriz 100 vezes maiores do que SystemML. Espera-se abrir uma nova aplicabilidade de aprendizado de máquina em várias áreas que precisam de processamento de dados em grande escala, incluindo shoppings online e SNS.

O professor Kim, do Departamento de Engenharia da Informação e Comunicação, disse 'Tecnologia de Aprendizado de Máquina, que tem chamado a atenção em todo o mundo, tem limitações na velocidade da análise de big data em forma de matriz e no tamanho do processamento da análise. A tecnologia de processamento de informações desenvolvida desta vez pode superar essas limitações e será útil não apenas no aprendizado de máquina, mas também em aplicações em uma gama mais ampla de aplicativos de análise de dados de tecnologia científica. "

Esta pesquisa teve a participação de Donghyoung Han, um Ph.D. Aluno do Departamento de Engenharia da Informação e Comunicação como primeiro autor e foi apresentado no dia 3 de julho no ACM SIGMOD 2019, a renomada conferência acadêmica na área de banco de dados realizada em Amsterdã, Holanda.