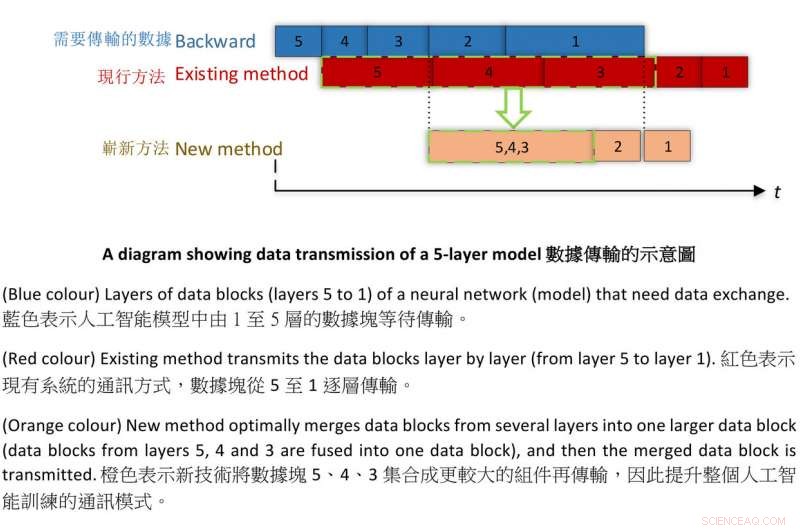

Diagrama mostrando a transmissão de dados de um modelo de 5 camadas. Crédito:HKBU

Pesquisadores da Hong Kong Baptist University (HKBU) fizeram parceria com uma equipe da Tencent Machine Learning para criar uma nova técnica para treinar máquinas de inteligência artificial (IA) mais rápido do que nunca, mantendo a precisão.

Durante o experimento, a equipe treinou duas redes neurais profundas populares, chamadas AlexNet e ResNet-50, em apenas quatro minutos e 6,6 minutos, respectivamente. Anteriormente, o tempo de treinamento mais rápido foi de 11 minutos para AlexNet e 15 minutos para ResNet-50.

AlexNet e ResNet-50 são redes neurais profundas construídas em ImageNet, um conjunto de dados em grande escala para reconhecimento visual. Uma vez treinado, o sistema foi capaz de reconhecer e rotular um objeto em uma determinada foto. O resultado é significativamente mais rápido do que os registros anteriores e supera todos os outros sistemas existentes.

O aprendizado de máquina é um conjunto de abordagens matemáticas que permitem que os computadores aprendam a partir dos dados sem serem explicitamente programados por humanos. Os algoritmos resultantes podem então ser aplicados a uma variedade de dados e tarefas de reconhecimento visual usados em IA.

A equipe do HKBU é formada pelo Professor Chu Xiaowen e Ph.D. estudante Shi Shaohuai do Departamento de Ciência da Computação. Professor Chu disse, "Propusemos um novo método de treinamento otimizado que melhora significativamente o melhor resultado sem perder a precisão. No treinamento de IA, pesquisadores se esforçam para treinar suas redes mais rapidamente, mas isso pode levar a uma diminuição na precisão. Como resultado, treinar modelos de aprendizado de máquina em alta velocidade enquanto mantém a exatidão e a precisão é um objetivo vital para os cientistas. "

O professor Chu disse que o tempo necessário para treinar máquinas de IA é afetado tanto pelo tempo de computação quanto pelo tempo de comunicação. A equipe de pesquisa alcançou avanços em ambos os aspectos para criar essa conquista recorde.

Isso incluiu a adoção de um método computacional mais simples conhecido como FP16 para substituir o mais tradicional, FP32, tornando a computação muito mais rápida sem perder a precisão. Como o tempo de comunicação é afetado pelo tamanho dos blocos de dados, a equipe criou uma técnica de comunicação chamada "fusão tensorial, "que combina dados menores em maiores, otimizar o padrão de transmissão e, assim, melhorar a eficiência da comunicação durante o treinamento de IA.

Esta nova técnica pode ser adotada na classificação de imagens em grande escala, e também pode ser aplicado a outras aplicações de IA, incluindo tradução automática; processamento de linguagem natural (PNL) para aprimorar as interações entre a linguagem humana e os computadores; análise de imagens médicas; e jogos de batalha multijogador online.