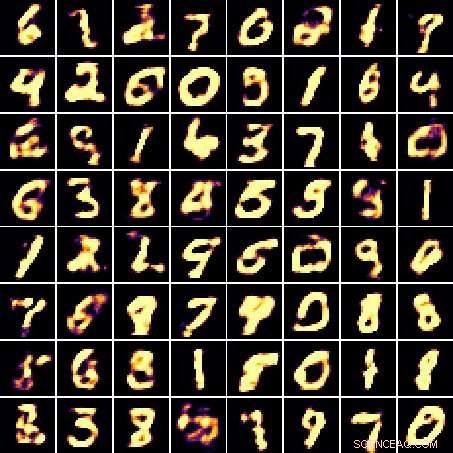

Saídas pré-ativadas (ou seja, o valor real, valores intermediários imediatamente antes da operação de binarização; ver Seção 2.2) para o modelo proposto implementado por MLPs e treinado com o objetivo WGAN-GP. Modelo proposto com DBNs (pré-ativado). Crédito:Dong e Yang.

Pesquisadores do Centro de Pesquisa para Inovação em TI da Academia Sinica, Em Taiwan, desenvolveram recentemente uma nova rede adversarial gerativa (GAN) que possui neurônios binários na camada de saída do gerador. Este modelo, apresentado em um artigo pré-publicado no arXiv, pode gerar previsões com valor binário diretamente no momento do teste.

Até aqui, As abordagens GAN alcançaram resultados notáveis na modelagem de distribuições contínuas. Apesar disso, aplicar GANs a dados discretos tem sido um pouco desafiador até agora, particularmente devido às dificuldades em otimizar a distribuição do modelo em direção à distribuição de dados de destino em um espaço discreto de alta dimensão.

Hao-Wen Dong, um dos pesquisadores que realizou o estudo, contado Tech Xplore , “Atualmente estou trabalhando na geração de música no Music and AI Lab da Academia Sinica. Na minha opinião, a composição pode ser interpretada como uma série de decisões - por exemplo, em relação à instrumentação, acordes e até mesmo as notas exatas para usar. Para alcançar a grande visão de um compositor de IA sólido, Estou particularmente interessado em saber se modelos generativos profundos, como GANs, são capazes de tomar decisões. Portanto, este trabalho examinou se podemos treinar um GAN que usa neurônios binários para tomar decisões binárias usando retropropagação, o algoritmo de treinamento padrão. "

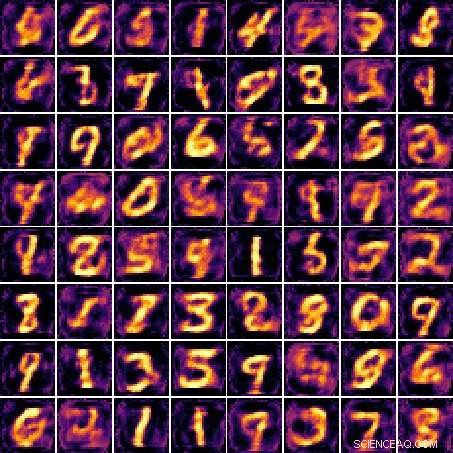

Dong e seu conselheiro Yi-Hsuan Yang desenvolveram um modelo que pode gerar previsões de valor binário diretamente no momento do teste. Eles então o usaram para gerar dígitos MNIST binarizados e comparar o desempenho de diferentes tipos de neurônios binários, Objetivos da GAN e arquiteturas de rede.

Dígitos gerados de amostra e saídas pré-ativadas (ou seja, o valor real, valores intermediários imediatamente antes da operação de binarização; veja a Seção 2.2) para o modelo proposto implementado por MLPs e treinado com o objetivo do WGAN-GP. Modelo proposto com SBNs (pré-ativado). Crédito:Dong e Yang.

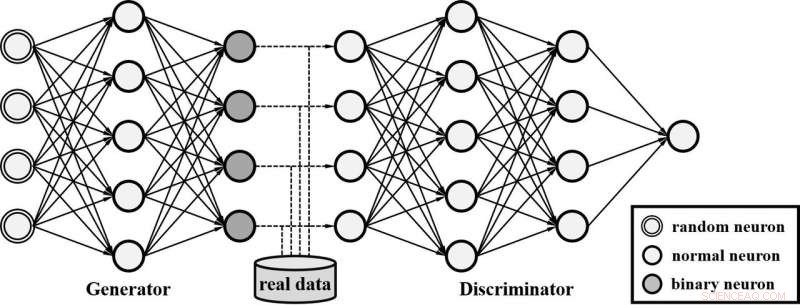

"Em poucas palavras, BinaryGAN é um GAN que adota neurônios binários, neurônios que produzem um ou zero, na camada de saída do gerador, "Dong disse." Um GAN tem dois componentes principais:o gerador e o discriminador. O gerador tem como objetivo produzir amostras de dados falsas que são capazes de enganar o discriminador para classificar as amostras geradas como reais. Por outro lado, o objetivo do discriminador é distinguir dados falsos dos reais. O feedback fornecido pelo discriminador é então usado para melhorar o gerador. Após o treinamento, o gerador pode então ser usado para gerar novas amostras de dados. "

Os pesquisadores foram capazes de treinar efetivamente o BinaryGAN, seu modelo generativo com neurônios binários. Suas descobertas também sugerem que o uso de estimadores de gradiente pode ser uma abordagem promissora para modelar distribuições discretas com GANs.

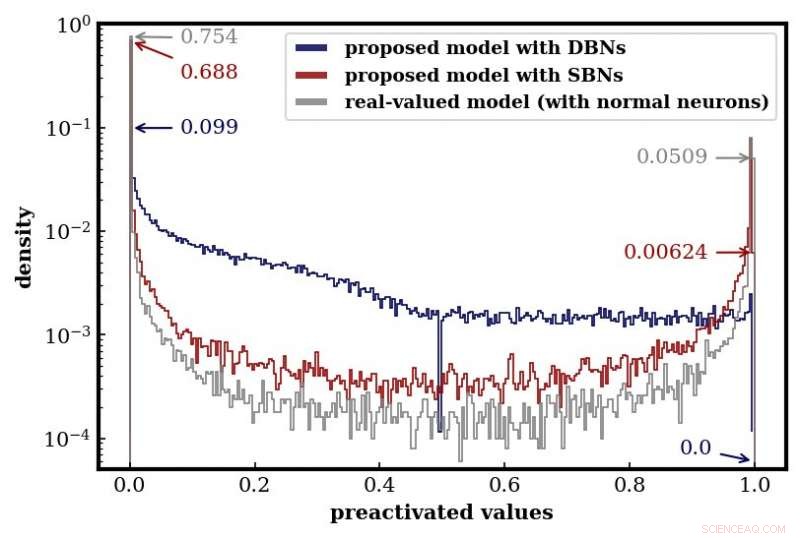

Histogramas das saídas pré-ativadas para o modelo proposto e as previsões probabilísticas para o modelo com valor real. Os dois modelos são implementados por MLPs e treinados com o objetivo do WGAN-GP. Crédito:Dong e Yang.

"Com o uso de estimadores de gradiente, conseguimos treinar o BinaryGAN, usando o algoritmo de retropropagação, "Dong disse." Além disso, a binarização adotada no modelo resultou em características distintas das representações intermediárias aprendidas pelas redes neurais profundas. Isso também enfatiza a importância de incluir operações de binarização no treinamento, para que essas operações de binarização também possam ser otimizadas. "

Dong e Yang estão agora tentando aplicar um GAN que adota neurônios binários para a realização de um gráfico de computação condicional. Neste caso, alguns componentes seriam ativados e desativados, de acordo com as decisões tomadas pelos neurônios binários da rede.

Diagrama do sistema do modelo proposto implementado por MLPs. Observe que os neurônios binários são usados apenas na camada de saída do gerador. Crédito:Dong e Yang.

"Isso é importante porque nos permite construir um modelo mais complexo que se baseia em decisões tomadas nas camadas iniciais da rede, "Dong disse." Por exemplo, poderíamos construir um compositor de IA que aprenda a primeiro decidir a instrumentação e os acordes e depois compõe de acordo. "

© 2018 Tech Xplore