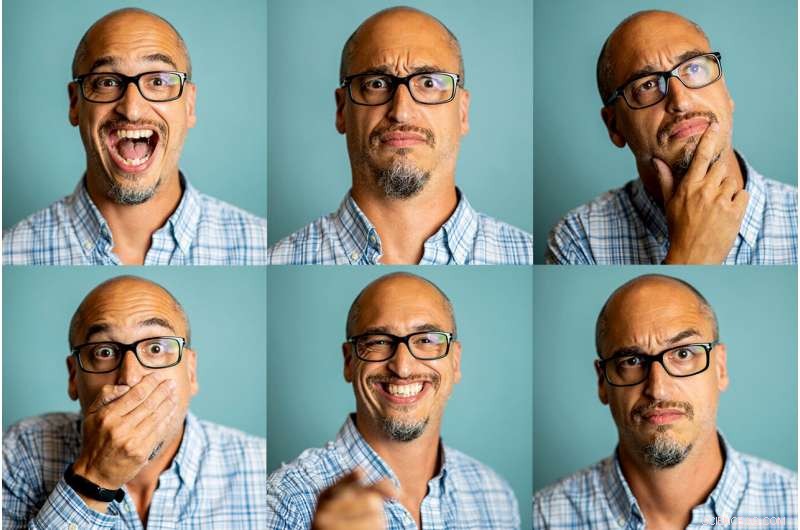

Uma nova pesquisa da neurocientista nordestina Lisa Feldman Barrett mostra que a interpretação da expressão facial de uma pessoa não pode ser feita no vácuo; depende do contexto. Crédito:Matthew Modoono / Northeastern University

Se você viu uma pessoa com a testa franzida, boca virada para baixo, e olhos semicerrados, você acha que eles estão com raiva? E se você descobrisse que eles haviam esquecido os óculos de leitura e estavam decifrando o cardápio de um restaurante?

A interpretação dos movimentos faciais de uma pessoa não pode ser feita no vácuo; depende do contexto - algo que a neurocientista nordestina Lisa Feldman Barrett mostra em um novo estudo inovador publicado quinta-feira na revista científica Nature Communications .

Barrett, um distinto professor universitário de psicologia do Nordeste, e colegas de várias outras instituições ao redor do mundo usaram fotos de atores profissionais retratando cenários ricamente construídos para mostrar que as pessoas não apenas usam movimentos faciais diferentes para comunicar diferentes instâncias da mesma categoria de emoção (alguém pode fazer cara feia, carranca, ou até mesmo rir quando estão demonstrando raiva), eles também empregam configurações faciais semelhantes para comunicar uma variedade de instâncias de diferentes categorias de emoções (uma carranca às vezes pode expressar concentração, por exemplo) - descobertas que têm implicações sérias para a tecnologia de reconhecimento de emoções que pretende "ler" emoções no rosto.

"A implicação deste estudo é que há muito mais variabilidade na maneira como as pessoas expressam diferentes instâncias de uma determinada categoria de emoção. E uma configuração facial pode expressar instâncias de raiva, felicidade, ou outras categorias de emoção, dependendo do contexto, "Barrett diz.

As pessoas podem arregalar os olhos porque estão com raiva ou porque estão surpresas, e o cérebro humano depende do contexto para resolver esse quebra-cabeça.

Estudos científicos anteriores de expressões de emoção contaram com pessoas comuns ou atores amadores para retratar uma única instância de cada categoria de emoção em um contexto empobrecido:"Seu primo acabou de morrer e você se sente muito triste. Que expressão você faria?"

Essas representações sugerem que as pessoas se apoiem em expressões estereotipadas de emoção (carrancudo de tristeza), em vez de expressões que refletem uma vida emocional mais rica, cheio de nuances e variações situadas, Barrett diz.

Então, para o estudo deles, Barrett e seus co-autores usaram fotos de atores profissionais - pessoas com "experiência em emoções" porque seus próprios meios de subsistência dependem "de seu retrato autêntico de experiências emocionais em filmes, televisão, e teatro, "de uma forma que transmita informações confiáveis, os pesquisadores escrevem.

Os atores receberam um detalhado, cenário de evocação de emoção para atuar, e depois fotografado por Howard Schatz (que também criou os cenários) para dois volumes publicados:In Character:Actors Acting, e Pego na Lei:Atores Agindo.

Um exemplo dos livros de Schatz:"Ele é um cara da motocicleta saindo de um bar de motoqueiros, assim como um cara em um Porsche volta para sua Harley reluzente, "de acordo com o artigo dos pesquisadores.

"O que é importante é que esses atores famosos receberam um cenário sem palavras de emoção nele, "Barrett diz, que elimina a conexão imediata que pode ser feita entre, por exemplo, a palavra "triste" e a expressão facial "carranca".

Os pesquisadores usaram 604 das 731 fotografias dos livros de Schatz, eliminando apenas aqueles em que as poses faciais dos atores não puderam ser analisadas porque suas mãos cobriram seus rostos ou porque suas cabeças estavam extremamente inclinadas.

Eles usaram essas fotos e cenários para executar dois estudos. Em primeiro, os pesquisadores pediram a 839 voluntários que julgassem sozinhos os significados emocionais das descrições de cenários. Cada voluntário avaliou cerca de 30 cenários, usando uma escala de 1 a 4 para indicar até que ponto uma das 13 emoções foi evocada na descrição:diversão, raiva, temor, desprezo, desgosto, embaraço, temer, felicidade, interesse, orgulho, tristeza, vergonha, e surpresa.

Eles usaram a avaliação mediana de cada cenário para classificá-lo em uma dessas 13 categorias de emoção. Os pesquisadores também convocaram três especialistas para codificar as 604 fotografias usando o Sistema de Codificação de Ação Facial, que especifica um conjunto de unidades de ação em que cada uma representa o movimento de um ou mais músculos faciais.

De acordo com uma hipótese antiga, certas categorias de emoções são expressas de forma consistente e específica com certos conjuntos de movimentos faciais. Se fosse esse o caso, então, todas as descrições de cenários classificadas como instâncias evocativas de uma determinada categoria de emoção devem corresponder a fotografias que retratam consistentemente um conjunto específico de movimentos faciais.

Ou, como Barrett diz, "Se as configurações faciais em questão - carrancudo, sorridente, carrancudo, e assim por diante - são expressões que evoluíram para comunicar emoções específicas, você deve ver atores famosos fazendo cara feia ao retratar exemplos de raiva e apenas raiva, fazendo cara feia ao retratar tristeza, e assim por diante."

Os pesquisadores executaram análises de aprendizado de máquina, que revelou que os atores retratavam instâncias das mesmas categorias de emoções contorcendo seus rostos de várias maneiras. Também, poses faciais semelhantes não expressavam de maneira confiável a mesma categoria emocional.

Para testar se os movimentos faciais, sozinho, carregam qualquer informação emocional independente do contexto, os pesquisadores pediram a mais dois grupos de voluntários para julgar o significado emocional de cada pose facial, seja quando apresentado sozinho ou com seu cenário correspondente.

O primeiro grupo, 842 pessoas, avaliado em cerca de 30 faces cada. O segundo grupo, 845 pessoas, avaliado em cerca de 30 pares de face e cenário. Ambos os grupos foram solicitados a julgar até que ponto seus rostos ou pares de rostos e cenários pertenciam a cada uma das 13 categorias de emoções.

Se os movimentos faciais carregam informações emocionais independentemente do contexto, então, as classificações apenas das faces deveriam ser muito semelhantes às classificações dos pares face-cenário. Se o significado emocional dos movimentos faciais vem principalmente do contexto ao qual eles estão associados, então, as classificações iniciais dos cenários por si só seriam mais semelhantes às classificações dos cenários de face.

Os pesquisadores descobriram que os julgamentos das pessoas sobre as poses faciais por si só não correspondiam de forma confiável às avaliações dos rostos quando eram vistos com o cenário; eles também não correspondiam à categoria de emoção designada do cenário. Os significados emocionais das poses faciais vieram principalmente dos cenários com os quais eles foram combinados, ou seja, o contexto.

"As presentes descobertas se juntam a outros resumos recentes das evidências empíricas para sugerir que carrancas, sorri, e outras configurações faciais pertencem a um maior, repertório mais variável das maneiras significativas pelas quais as pessoas movem seus rostos para expressar emoções, "escrevem os pesquisadores.

Em outras palavras, Barrett diz, "as pessoas inferem o significado do seu sorriso, e suas inferências são informadas pelo contexto. Quando se trata de expressar emoções, um rosto não fala por si ".

As descobertas dos pesquisadores têm implicações para os tipos de sistemas artificialmente inteligentes que alguns engenheiros afirmam ser capazes de decifrar a emoção de alguém rastreando apenas seus movimentos faciais.

As empresas já estão usando sistemas movidos a IA para avaliar as emoções das crianças enquanto elas aprendem, fazer julgamentos sobre potenciais candidatos a empregos, e adivinhe as supostas intenções nefastas de um passageiro de avião.

"Nossa pesquisa vai contra a abordagem tradicional de IA emocional, "Barrett diz." Certas empresas afirmam ter algoritmos que podem detectar a raiva, por exemplo, quando o que eles realmente têm - em circunstâncias ideais - são algoritmos que provavelmente podem detectar carranca, que pode ou não ser uma expressão de raiva. É importante não confundir a descrição de uma configuração facial com inferências sobre seu significado emocional. "