Brendan Bena apresentando seu trabalho em uma conferência. Crédito:UC Colorado Springs.

Nas ultimas decadas, os pesquisadores desenvolveram ferramentas de inteligência artificial (IA) e técnicas computacionais cada vez mais avançadas que podem ser aplicadas em uma variedade de ambientes. Entre estes, técnicas que podem gerar linguagem escrita ou falada têm atraído considerável atenção, particularmente com a introdução de novos assistentes de voz, robôs e novos dispositivos interativos.

Pesquisadores da University of Colorado (UC) - Colorado Springs e Drury University desenvolveram recentemente um sistema único de geração de linguagem que pode produzir versos de poesia criativos. Seu sistema, apresentado em um artigo pré-publicado no arXiv, é uma adaptação ajustada do GPT-2, um modelo de linguagem pré-treinado desenvolvido pela OpenAI.

Jugal Kalita, o professor da UC Colorado Springs supervisionando o estudo recente, tem conduzido pesquisas sobre geração de linguagem natural nos últimos 30 anos, começando de seus dias de graduação na Universidade da Pensilvânia. Seu primeiro artigo sobre geração de linguagem natural, publicado em 1988, teve como objetivo produzir parágrafos de texto que podem aparecer em um jornal típico, seguindo um conjunto básico de regras. Mais recentemente, inspirado por avanços em redes neurais artificiais para processamento de linguagem natural (PNL), O Prof. Kalita e seus alunos começaram a desenvolver técnicas de aprendizado profundo para a geração de artigos curtos, diálogos e escrita criativa.

“A ideia de investigar o tema da geração automática de poesia surgiu no início do verão de 2019, quando Brendan Bena, um estagiário de pesquisa de verão na Universidade do Colorado, Colorado Springs, da Drury University do Missouri, mostrou interesse em gerar letras de músicas automaticamente, "O professor Kalita disse ao TechXplore." Ele originalmente queria criar um sistema que tentasse imitar as emoções provocadas pelas letras das músicas. "

Como a maioria das letras das músicas é protegida por direitos autorais, Encontrar grandes conjuntos de dados para treinar modelos de aprendizado profundo na geração de letras pode ser muito desafiador. Bena e o Prof. Kalita decidiram então desenvolver uma ferramenta de aprendizado profundo para a geração de poesia. No entanto, em vez de focar em recursos como a estrutura ou ritmo da poesia, como a maioria dos estudos anteriores de geração de poesia, eles exploraram seus aspectos mais emocionais e criativos.

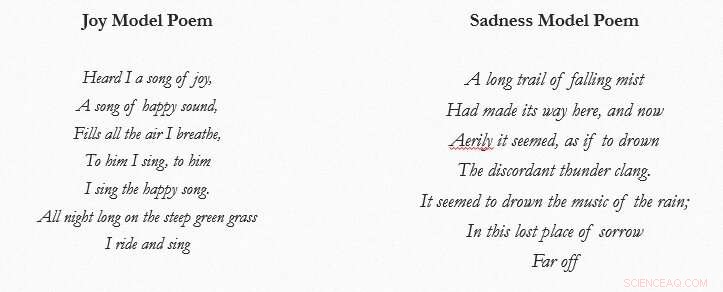

Exemplos de poesia que evocam emoções produzidas pelo sistema de geração da linguagem dos pesquisadores. Crédito:Bena &Kalita.

"Depois de perceber que havia uma porção muito maior de pesquisas, bem como dados, no campo da geração de poesia, mudamos nosso foco para este tópico específico, "Bena disse ao TechXplore." O trabalho foi amplamente baseado na tarefa abrangente de geração de texto que veio com muitas pesquisas anteriores. Contudo, ao contrário dos esforços anteriores, queríamos nos concentrar mais no conteúdo, emoção e criatividade do texto, em oposição à estrutura ou ritmo encontrados em estudos anteriores de geração de poesia. "

Para desenvolver seu sistema de geração de poesia, Bena e o Prof. Kalita reuniram primeiro um grande corpus de texto das bases de dados do Project Gutenberg e UC-Santa Cruz Dreambank. Eles navegaram no banco de dados Gutenberg em busca de palavras incluídas no EmoLex, um conjunto de dados de vocabulário de emoção desenvolvido pelo National Research Council of Canada.

Os pesquisadores então dividiram o conjunto de dados resultante em diferentes 'categorias de emoções, "olhando para o número de palavras EmoLex contidas em cada extrato, e usou esses dados para treinar uma rede neural profunda. O modelo que eles treinaram é uma adaptação do GPT-2, uma arquitetura que aprende a gerar novos fragmentos de texto modelando o estilo de linguagem usado nos dados em que é treinado.

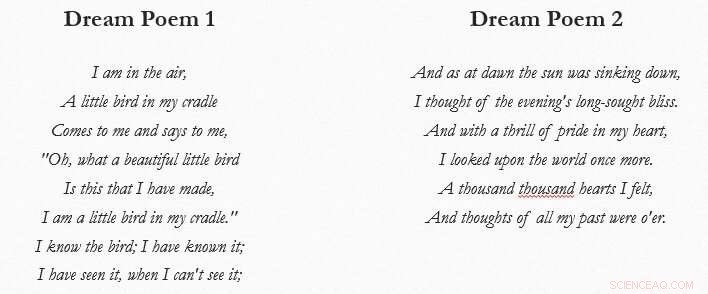

"Também alimentamos nossa rede neural artificial com uma combinação de dados de sonho e poesia para criar o que é conhecido como 'poesia de sonho, "Bena explicou." No final, tínhamos cinco modelos distintos de emoção para as emoções de alegria, tristeza, Confiar em, raiva e expectativa, mas também tínhamos um modelo de poesia de sonho. Este sistema, como afirmado anteriormente, concentra-se menos na estrutura encontrada em muitos trabalhos de geração de poesia e mais em um estilo de poesia em verso livre que procura imitar e reproduzir a sutileza e a criatividade de poetas reais. "

Os pesquisadores pediram aos usuários humanos para avaliar os poemas criados por seu sistema, ao mesmo tempo que emprega a ferramenta Coh-Metrix para avaliar a qualidade dos versos que gerou. Eles descobriram que produzia poemas que efetivamente provocavam tristeza e alegria 87,5% e 85% das vezes, respectivamente. Além disso, quando treinado em dados de sonhos e poesia, seu sistema gerou versos de poesia "oníricos" únicos que capturaram elementos do que é conhecido como "poesia onírica" com uma pontuação de 3,2 na escala Likert.

Exemplos de poesia onírica produzida pelo sistema de geração de linguagem dos pesquisadores. Crédito:Bena &Kalita.

"Nossas descobertas sugerem que o texto pode, na verdade, ser gerado de forma que desperte emoção nos leitores e possa se assemelhar aos tipos de criatividade que os artistas procuram injetar em seu trabalho, "Bena disse." Acreditamos que nossa pesquisa seja um trabalho novo no campo da geração de poesia criativa e esperamos que nosso estudo abra as portas para futuros trabalhos nesta área. "

Bena e o Prof. Kalita estão entre os primeiros a demonstrar vislumbres iniciais de criatividade da máquina na geração de poesia. Em seus próximos estudos, os pesquisadores planejam melhorar a qualidade dos poemas compostos por seu sistema, ao mesmo tempo, aplicando sua abordagem à criação de poesia em outras línguas.

"Se fizermos a curadoria dos dados de treinamento um pouco mais, acreditamos que uma arquitetura de rede neural poderia capturar melhor as emoções e os aspectos de sonho da poesia que buscamos criar, "Bena disse." Na verdade, enquanto o dicionário EmoLex é um conjunto de dados muito útil, seu vocabulário não dá conta de todo o inglês antigo encontrado em algumas poesias de Gutenberg. "

No futuro, os pesquisadores esperam replicar seu experimento com foco em léxicos de frase ou segmento, pois isso poderia permitir que capturassem dependências em texto baseado em emoções de maneira mais eficaz. O estudo também pode ser repetido usando uma arquitetura baseada em rede neural mais sofisticada, o que pode melhorar a qualidade da poesia produzida em termos de gramática e estrutura das frases.

Como Bena e o Prof. Kalita já usaram seu sistema para produzir versos de poesia onírica, eles poderiam eventualmente aplicá-lo a outros estilos criativos também, como poesia de apagamento. Poesia de apagamento é produzida pegando palavras específicas ou aleatórias de um texto existente e então usando-as para formar novos versos.

"Finalmente, também estamos trabalhando na geração de poesia em várias línguas diferentes usando a aprendizagem por transferência, "Prof Kalita disse." Por exemplo, Shaun Tucker, um estudante de mestrado na UC-Colorado Springs tem gerado poesia em várias línguas indo-europeias usando o modelo GPT-2 pré-treinado da OpenAI. Até aqui, geramos poemas em inglês, Espanhol, Ucraniano, Hindi, Bengali e assamês e descobriram que o modelo gerador de aprendizado profundo GPT-2, que foi pré-treinado com um grande corpo de texto em inglês, pode ser treinado com prosa e poemas em todas essas línguas para gerar poesia. "

© 2020 Science X Network