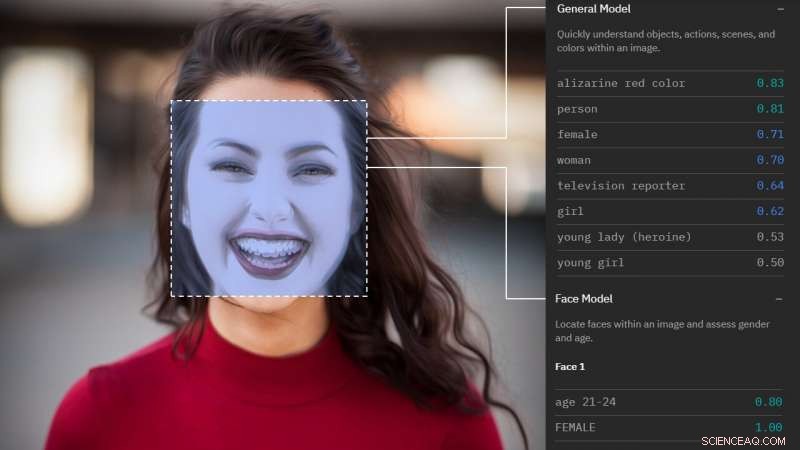

Como a análise facial o vê. Crédito:Morgan Klaus Scheuerman / CU Boulder

Com uma breve olhada em um único rosto, O software de reconhecimento facial emergente agora pode categorizar o gênero de muitos homens e mulheres com notável precisão.

Mas se esse rosto pertencer a uma pessoa transgênero, tais sistemas erram mais de um terço das vezes, de acordo com a nova pesquisa da Universidade do Colorado em Boulder.

"Descobrimos que os serviços de análise facial apresentam desempenho consistentemente pior em indivíduos transgêneros, e eram universalmente incapazes de classificar gêneros não binários, "disse o autor principal Morgan Klaus Scheuerman, um Ph.D. estudante do departamento de Ciência da Informação. "Embora existam muitos tipos diferentes de pessoas, esses sistemas têm uma visão extremamente limitada de como é o gênero. "

O estudo chega em um momento em que as tecnologias de análise facial - que usam câmeras ocultas para avaliar e caracterizar certos recursos de um indivíduo - estão se tornando cada vez mais prevalentes, incorporado em tudo, desde aplicativos de namoro em smartphones e quiosques digitais em shoppings até sistemas de segurança de aeroportos e vigilância policial.

Pesquisas anteriores sugerem que eles tendem a ser mais precisos ao avaliar o gênero de homens brancos, mas identifique erroneamente as mulheres de cor até um terço das vezes.

"Sabíamos que havia preconceitos inerentes a esses sistemas em torno de raça e etnia e suspeitávamos que também haveria problemas em relação ao gênero, "disse o autor sênior Jed Brubaker, professor assistente de Ciência da Informação. "Decidimos testar isso no mundo real."

Os pesquisadores coletaram 2, 450 imagens de rostos do Instagram, cada um dos quais foi rotulado por seu proprietário com uma hashtag indicando sua identidade de gênero. As fotos foram então divididas em sete grupos de 350 imagens (# mulheres, #cara, #transwoman, #transman, #agender, #agenderqueer, #nonbinary) e analisado por quatro dos maiores fornecedores de serviços de análise facial (IBM, Amazonas, Microsoft e Clarifai).

Notavelmente, O Google não foi incluído porque não oferece serviços de reconhecimento de gênero.

Na média, os sistemas eram mais precisos com fotos de mulheres cisgênero (aquelas nascidas do sexo feminino e identificadas como mulheres), acertando o gênero em 98,3% das vezes. Eles categorizaram os homens cisgêneros com precisão 97,6% das vezes.

Mas os homens trans foram erroneamente identificados como mulheres em 38% das vezes.

E aqueles que se identificaram como agêneros, genderqueer ou nonbinary - indicando que eles não se identificam como masculino ou feminino - foram caracterizados incorretamente 100 por cento do tempo.

"Esses sistemas não conhecem nenhuma outra língua além de masculino ou feminino, então, para muitas identidades de gênero, não é possível que sejam corretas, "diz Brubaker.

O estudo também sugere que esses serviços identificam o gênero com base em estereótipos desatualizados.

Quando Scheuerman, quem é homem e tem cabelo comprido, enviou sua própria foto, metade o categorizou como mulher.

Os pesquisadores não conseguiram acessar os dados de treinamento, ou entradas de imagens usadas para "ensinar" ao sistema a aparência de homem e mulher, mas pesquisas anteriores sugerem que eles avaliam coisas como a posição dos olhos, plenitude labial, comprimento do cabelo e até roupas.

"Esses sistemas correm o risco de reforçar os estereótipos de como você deve ser se quiser ser reconhecido como homem ou mulher. E isso afeta a todos, "disse Scheuerman.

Quando o pesquisador Morgan Klaus Scheuerman, quem é um homem, enviou sua foto para vários serviços de análise facial, metade entendeu seu gênero errado. Crédito:Morgan Klaus Scheuerman / CU Boulder

O mercado de serviços de reconhecimento facial deve dobrar até 2024, à medida que os desenvolvedores de tecnologia trabalham para melhorar a interação entre humanos e robôs e direcionar os anúncios aos compradores com mais cuidado. Já, Notas de Brubaker, as pessoas usam a tecnologia de reconhecimento facial todos os dias para obter acesso a seus smartphones ou fazer login em seus computadores.

Se ele tem a tendência de errar o gênero de certos, já vulnerável, populações que podem ter consequências graves.

Por exemplo, um aplicativo de combinação pode marcar alguém para um encontro com o sexo errado, levando a uma situação potencialmente perigosa. Ou uma incompatibilidade entre o gênero que um programa de reconhecimento facial vê e a documentação que uma pessoa carrega pode levar a problemas para passar pela segurança do aeroporto, diz Scheuerman.

Ele está mais preocupado com o fato de que tais sistemas reafirmam as noções de que as pessoas trans não se encaixam.

"As pessoas pensam que a visão do computador é futurística, mas há muitas pessoas que poderiam ficar de fora deste assim chamado futuro, " ele disse.

Os autores dizem que gostariam de ver as empresas de tecnologia se afastarem totalmente da classificação de gênero e se atentarem a rótulos mais específicos como "cabelo comprido" ou "maquiagem" ao avaliar as imagens.

"Quando você anda na rua, pode olhar para alguém e presumir que sabe qual é o gênero dela, mas essa é uma ideia muito curiosa dos anos 90 e não é mais como o mundo é, "disse Brubaker." À medida que nossa visão e nossa compreensão cultural do que é gênero têm evoluído. Os algoritmos que impulsionam nosso futuro tecnológico, não. Isso é profundamente problemático. "

A pesquisa será apresentada em novembro na Conferência ACM sobre Trabalho Cooperativo Apoiado por Computador em Austin, Texas.