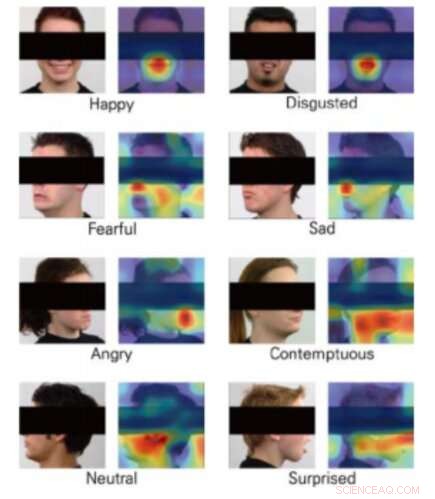

Mapas de ativação de classe para 8 emoções. Crédito:Yong, Lee &Choi.

A realidade virtual (VR) está abrindo novas fronteiras no desenvolvimento de videogames, pavimentando o caminho para cada vez mais realista, experiências de jogo interativas e envolventes. Consoles de realidade virtual, na verdade, permitem que os jogadores sintam que estão quase dentro do jogo, superando as limitações associadas aos problemas de resolução e latência da tela.

Uma integração adicional interessante para RV seria o reconhecimento de emoção, pois isso poderia permitir o desenvolvimento de jogos que respondam às emoções do usuário em tempo real. Com isso em mente, uma equipe de pesquisadores da Yonsei University e da Motion Device Inc. propôs recentemente uma técnica baseada no aprendizado profundo que pode permitir o reconhecimento de emoções durante as experiências de jogos de RV. O artigo foi apresentado na Conferência IEEE de 2019 sobre realidade virtual e interfaces de usuário 3-D.

Para VR funcionar, os usuários usam monitores tipo head-mounted (HMDs), para que o conteúdo de um jogo possa ser apresentado diretamente na frente de seus olhos. A fusão de ferramentas de reconhecimento de emoção com experiências de jogos VR provou ser um desafio, como a maioria dos modelos de aprendizado de máquina para a previsão de emoções funcionam analisando os rostos das pessoas; em VR, o rosto de um usuário é parcialmente ocluído pelo HMD.

A equipe de pesquisadores da Universidade Yonsei e da Motion Device treinou três redes neurais convolucionais (CNNs) - a saber, DenseNet, ResNet e Inception-ResNet-V2 - para prever as emoções das pessoas a partir de imagens parciais de rostos. Eles tiraram imagens do Radbound Faces Dataset (RaFD), que inclui 8, 040 imagens de rosto de 67 assuntos, em seguida, editou-os cobrindo a parte do rosto que seria ocluída pelo HMD ao usar a RV.

As imagens usadas para treinar os algoritmos retratam rostos humanos, mas a seção que contém os olhos, orelhas e sobrancelhas são cobertas por um retângulo preto. Quando os pesquisadores avaliaram suas CNNs, eles descobriram que eram capazes de classificar as emoções mesmo sem analisar essas características particulares do rosto de uma pessoa, que são considerados de importância fundamental para o reconhecimento de emoções.

Geral, a CNN chamada DenseNet teve melhor desempenho do que as outras, alcançando precisões médias de mais de 90 por cento. Interessantemente, Contudo, o algoritmo ResNet superou os outros dois na classificação de expressões faciais que transmitiam medo e repulsa.

"Treinamos com sucesso três arquiteturas da CNN que estimam as emoções das imagens de rosto humano parcialmente cobertas, "os pesquisadores escreveram em seu artigo." Nosso estudo mostrou a possibilidade de estimar emoções a partir de imagens de humanos usando HMDs usando visão de máquina. "

O estudo sugere que, no futuro, ferramentas de reconhecimento de emoção podem ser integradas com a tecnologia VR, mesmo se os HMDs obstruírem partes do rosto de um jogador. Além disso, as CNNs que os pesquisadores desenvolveram podem inspirar outras equipes de pesquisa em todo o mundo a desenvolver novas técnicas de reconhecimento de emoções que podem ser aplicadas aos jogos de RV.

Os pesquisadores agora planejam substituir os retângulos pretos que usaram em seu estudo por imagens reais de pessoas usando HDMs. Em última análise, isso deve permitir que eles treinem as CNNs de forma mais confiável e eficaz, preparando-os para aplicações da vida real.

© 2019 Science X Network