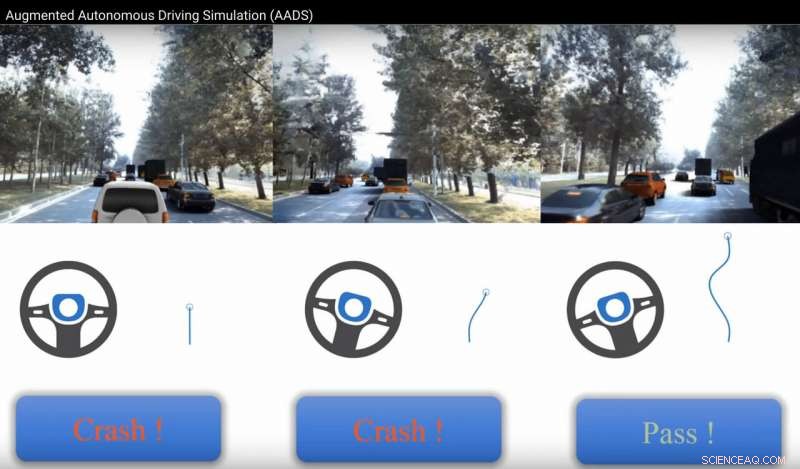

O sistema Augmented Autonomous Driving Simulation (AADS) combina fotos, vídeos, e nuvens de pontos lidar para renderização de cena realista com dados de trajetória do mundo real que podem ser usados para prever o comportamento de direção e as posições futuras de outros veículos ou pedestres na estrada. Crédito:Li et. Al, 2019

Dinesh Manocha, cientista da computação da Universidade de Maryland, em colaboração com uma equipe de colegas da Baidu Research e da Universidade de Hong Kong, desenvolveu um sistema de simulação foto-realista para treinar e validar veículos autônomos. O novo sistema oferece um mais rico, simulação mais autêntica do que os sistemas atuais que usam motores de jogo ou computação gráfica de alta fidelidade e padrões de tráfego matematicamente renderizados.

Seu sistema, chamada Simulação de direção autônoma aumentada (AADS), poderia tornar a tecnologia de direção autônoma mais fácil de avaliar no laboratório, ao mesmo tempo que garantia uma segurança mais confiável antes do início dos caros testes em estradas.

Os cientistas descreveram sua metodologia em um artigo de pesquisa publicado em 27 de março de 2019 no jornal Ciência Robótica .

“Este trabalho representa um novo paradigma de simulação em que podemos testar a confiabilidade e segurança da tecnologia de direção automática antes de implantá-la em carros reais e testá-la em rodovias ou estradas urbanas, "disse Manocha, um dos autores correspondentes do artigo, e um professor com nomeação conjunta em ciência da computação, engenharia elétrica e informática, e o Instituto de Estudos Avançados de Computação da Universidade de Maryland.

Um benefício potencial dos carros autônomos é que eles podem ser mais seguros do que os motoristas humanos que tendem a se distrair, fadiga e decisões emocionais que levam a erros. Mas para garantir a segurança, os veículos autônomos devem avaliar e responder ao ambiente de condução sem falhas. Dadas as inúmeras situações que um carro pode encontrar na estrada, um sistema de direção autônomo requer centenas de milhões de quilômetros de test drives sob condições desafiadoras para demonstrar confiabilidade.

Embora isso possa levar décadas para ser realizado na estrada, avaliações preliminares podem ser realizadas rapidamente, com eficiência e segurança por meio de simulações de computador que representam com precisão o mundo real e modelam o comportamento dos objetos ao redor. Os atuais sistemas de simulação de última geração descritos na literatura científica são insuficientes em retratar ambientes foto-realistas e apresentar padrões de fluxo de tráfego do mundo real ou comportamentos do motorista.

O AADS é um sistema orientado por dados que representa com mais precisão as entradas que um carro autônomo receberia na estrada. Os carros autônomos contam com um módulo de percepção, que recebe e interpreta informações sobre o mundo real, e um módulo de navegação que toma decisões, como para onde dirigir ou se deve quebrar ou acelerar, com base no módulo de percepção.

No mundo real, o módulo de percepção de um carro autônomo normalmente recebe entrada de câmeras e sensores lidar, que usam pulsos de luz para medir distâncias ao redor. Na tecnologia de simulador atual, o módulo de percepção recebe dados de imagens geradas por computador e padrões de movimento modelados matematicamente para pedestres, bicicletas, e outros carros. É uma representação relativamente grosseira do mundo real. Também é caro e demorado para criar porque os modelos de imagens gerados por computador devem ser gerados manualmente.

A síntese de novos antecedentes. Um método de “costura” foi usado para fazer uma imagem completa (esquerda). A visão final foi sintetizada após os processos de pós-processamento, como preenchimento de buracos e mistura de cores. Crédito:Li et al., Sci. Robô. 4, eaaw0863 (2019)

O sistema AADS combina fotos, vídeos, e nuvens de pontos lidar - que são como renderizações de forma 3-D - com dados de trajetória do mundo real para pedestres, bicicletas, e outros carros. Essas trajetórias podem ser usadas para prever o comportamento de direção e as posições futuras de outros veículos ou pedestres na estrada para uma navegação mais segura.

"Estamos renderizando e simulando o mundo real visualmente, usando vídeos e fotos, "disse Manocha, "mas também capturamos comportamentos reais e padrões de movimento. A maneira como os humanos dirigem não é fácil de capturar por modelos matemáticos e leis da física. extraímos dados sobre trajetórias reais de todos os vídeos que tínhamos disponível, e modelamos comportamentos de direção usando metodologias de ciências sociais. Essa abordagem baseada em dados nos deu um simulador de tráfego muito mais realista e benéfico. "

Os cientistas tiveram um desafio de longa data a superar ao usar imagens de vídeo reais e dados lidar para sua simulação:cada cena deve responder aos movimentos de um carro que dirige sozinho, mesmo que esses movimentos não tenham sido capturados pela câmera original ou pelo sensor lidar. Qualquer ângulo ou ponto de vista não capturado por uma foto ou vídeo deve ser renderizado ou simulado usando métodos de previsão. É por isso que a tecnologia de simulação sempre se baseou tanto em gráficos gerados por computador e técnicas de previsão baseadas na física.

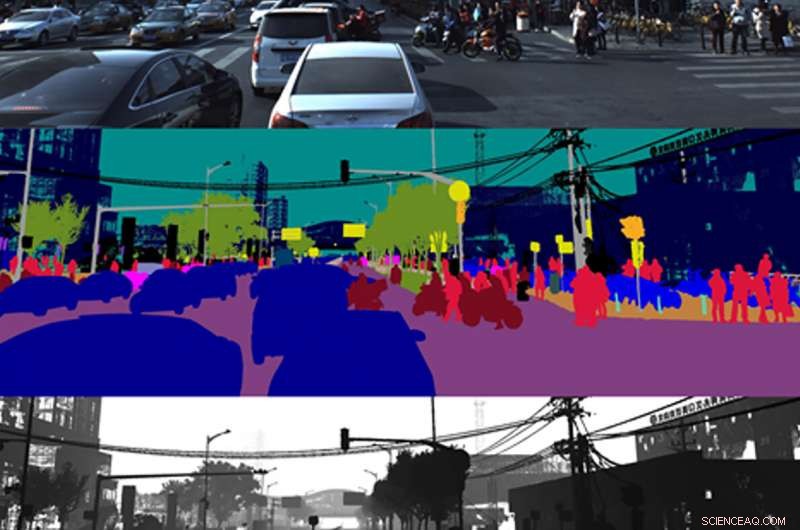

O conjunto de dados produzido pelo sistema AADS, incluindo imagens RGB (topo), anotações de diferentes objetos (meio), e uma nuvem de pontos (um conjunto de pontos de dados no espaço). Crédito:Li et al., Sci. Robô. 4, eaaw0863 (2019)

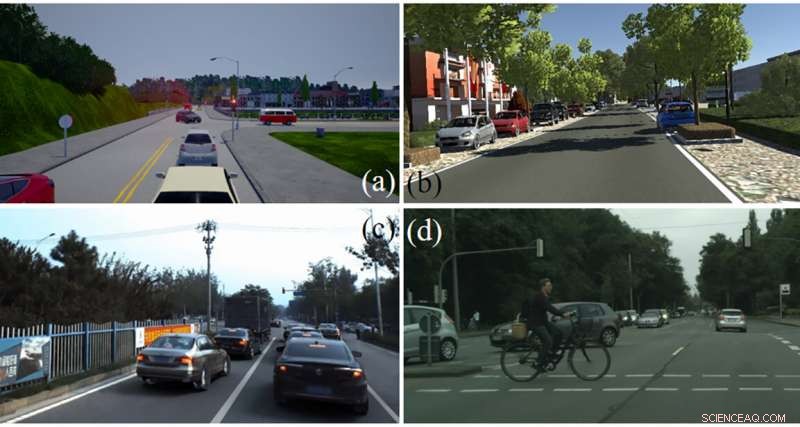

O método AADS produziu uma imagem (canto inferior esquerdo) que é mais visualmente semelhante a uma imagem real de CityScapes (canto inferior direito), um conjunto de dados robusto de cenas de ruas urbanas, do que para CARLA (canto superior esquerdo), o mais recente e popular simulador de realidade virtual para direção autônoma, ou o conjunto de dados totalmente sintético VKITTI (canto superior direito). Crédito:Li et al., Sci. Robô. 4, eaaw0863 (2019)

Para superar este desafio, os pesquisadores desenvolveram uma tecnologia que isola os vários componentes de uma cena de rua do mundo real e os renderiza como elementos individuais que podem ser ressintetizados para criar uma infinidade de cenários de direção fotorrealistas.

Com AADS, veículos e pedestres podem ser içados de um ambiente e colocados em outro com os padrões de iluminação e movimento adequados. As estradas podem ser recriadas com diferentes níveis de tráfego. Vários ângulos de visão de cada cena fornecem perspectivas mais realistas durante as mudanças de pista e curvas. Além disso, a tecnologia de processamento de imagem avançada permite transições suaves e reduz a distorção em comparação com outras técnicas de simulação de vídeo. As técnicas de processamento de imagem também são usadas para extrair trajetórias, e, assim, modelar os comportamentos do motorista.

"Como estamos usando vídeos e movimentos do mundo real, nosso módulo de percepção tem informações mais precisas do que os métodos anteriores, "Disse Manocha." E então, por causa do realismo do simulador, podemos avaliar melhor as estratégias de navegação de um sistema de direção autônomo. "

Manocha disse que ao publicar este trabalho, os cientistas esperam que algumas das corporações que desenvolvem veículos autônomos possam incorporar a mesma abordagem baseada em dados para melhorar seus próprios simuladores para testar e avaliar sistemas de direção autônoma.