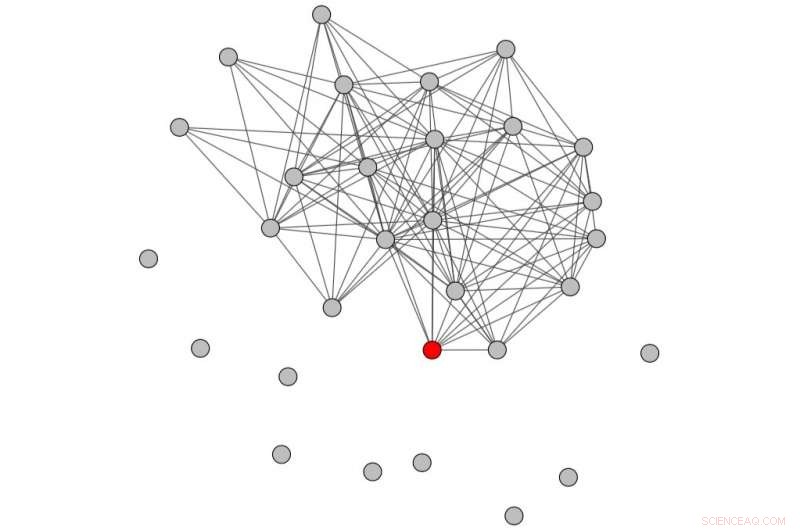

Gráfico conversacional obtido considerando um período de tempo anterior ao abuso. Crédito:Papegnies et al.

Uma equipe de pesquisadores da Universidade de Avignon desenvolveu recentemente um sistema para detectar automaticamente o abuso em comunidades online. Este sistema, apresentado em um artigo pré-publicado no arXiv, foi descoberto que supera as abordagens existentes para detectar abuso e moderar conteúdo gerado pelo usuário.

"Comunidades online cada vez maiores oferecem a oportunidade de espalhar ideias através da Internet, garantindo algum anonimato aos usuários, "os pesquisadores disseram ao TechXplore, via email. "Contudo, esses espaços costumam ter usuários exibindo comportamento abusivo. Para líderes comunitários, é importante moderar esses atos maliciosos, já que não fazer isso pode envenenar a comunidade, desencadeia o êxodo de usuários e expõe os administradores a questões legais. "

A moderação de conteúdo online gerado pelo usuário é geralmente realizada manualmente por humanos; portanto, pode ser caro e demorado. Para reduzir custos, pesquisadores têm tentado desenvolver ferramentas de moderação de conteúdo totalmente automatizadas que possam substituir ou auxiliar moderadores humanos.

"Nesse trabalho, formulamos a tarefa de moderação de conteúdo como um problema de classificação, e aplicar nosso método a um corpus de mensagens trocadas por jogadores de um MMORPG, um jogo de RPG online multijogador massivo, "disseram os pesquisadores.

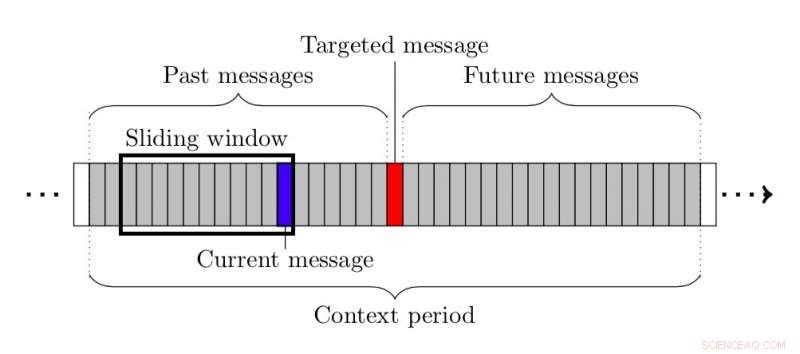

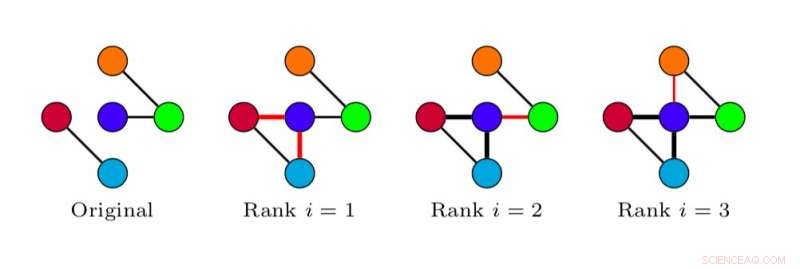

Como primeiro passo, os pesquisadores extraíram redes de conversação de logs de bate-papo brutos que representam as conversas nas quais cada mensagem abusiva foi enviada, e caracterizou-os usando medidas topológicas. Eles usaram seus resultados como recursos, treinar um classificador para detectar abusos em plataformas online.

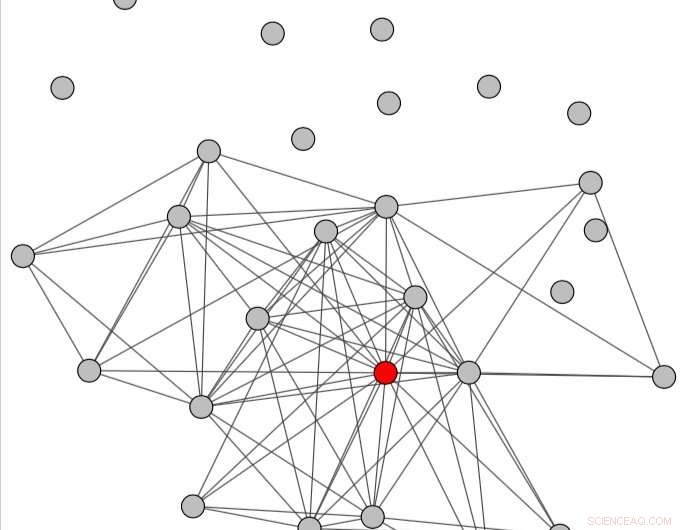

O gráfico conversacional obtido considerando um período de tempo após o abuso. Crédito:Papegnies et al.

Ao extrair as redes de conversação, os pesquisadores seguiram um método de três etapas. Primeiro, eles identificaram o subconjunto de mensagens que usariam para extrair a rede. Então, eles selecionaram um subconjunto de usuários que eram os prováveis receptores de cada mensagem. Finalmente, eles adicionaram bordas e revisaram seus pesos com base nesses receptores de mensagens em potencial.

"Os métodos existentes para a detecção automática de mensagens abusivas se concentram no conteúdo textual das mensagens trocadas, o que levanta muitos problemas:problemas específicos do idioma, erros de sintaxe, erros de ortografia, ofuscação, e outros, "explicaram os pesquisadores." Pelo contrário, usamos apenas a presença / ausência de interações entre os usuários, ou seja, o fato de trocarem algumas mensagens (ou não), por oposição à natureza das mensagens trocadas. Ignorar o conteúdo nos permitiu resolver esses problemas. "

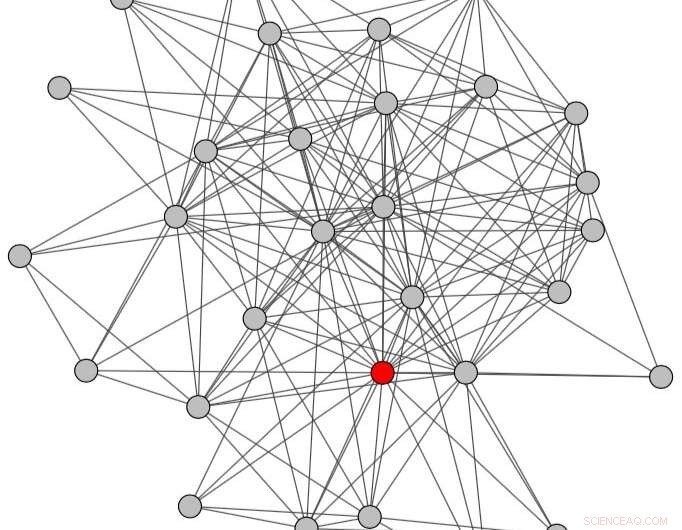

Essencialmente, os pesquisadores modelaram conversas online usando um gráfico em que os nós representam os usuários e os links representam as trocas de mensagens. Usando medidas específicas de gráfico, eles foram capazes de observar diferenças na forma como as conversas são estruturadas, dependendo se contêm ou não mensagens abusivas. Essas diferenças foram então usadas para treinar um classificador para detectar abusos nas conversas entre os usuários.

Gráfico conversacional obtido considerando todo o período de tempo (ou seja, antes e depois do abuso). Crédito:Papegnies et al.

"Nosso primeiro esforço, apresentado em um artigo anterior, foi baseado na abordagem tradicional, ou seja, usava o conteúdo textual das mensagens, "os pesquisadores explicaram." Quando propusemos este método baseado em gráficos, não esperávamos que funcionasse tão bem; chegamos a pensar que isso resultaria em desempenhos mais baixos em comparação com o método baseado em conteúdo. Ficamos muito surpresos ao obter resultados significativamente melhores. Esta é a descoberta mais significativa de nosso estudo - que, pelo menos para esta tarefa específica, a estrutura da conversa é mais discriminante do que a natureza do conteúdo trocado. "

Crédito:Papegnies et al.

Crédito:Papegnies et al.

Os pesquisadores testaram seu sistema em um conjunto de dados de comentários de usuários de um jogo MMORPG francês e descobriram que superou as abordagens existentes, com uma medida F de 83,89 ao usar o conjunto completo de recursos. Ao reduzir o conjunto de recursos e manter apenas os recursos mais discriminativos, eles foram capazes de reduzir drasticamente o tempo de computação, ao mesmo tempo em que mantém um excelente desempenho. No futuro, sua abordagem baseada em gráficos também pode ser aplicada a outras tarefas de classificação de mensagens, como detecção de trolls online.

"Agora tentaremos mesclar as duas abordagens (baseadas em conteúdo e em gráficos), para verificar se eles tiram proveito de informações semelhantes, nesse caso, os resultados seriam semelhantes, ou se eles dependem de informações complementares, nesse caso, combiná-los deve levar a melhorias no desempenho, "os pesquisadores acrescentaram." Então, queremos avançar para um método mais automatizado para caracterizar nossos gráficos de conversação, chamados de embeddings de gráfico. É um método baseado em deep learning que consiste em treinar uma rede neural para obter uma representação eficiente dos gráficos. Por comparação, atualmente fazemos esta parte do trabalho manualmente, por meio de uma tarefa chamada seleção de recursos. "

© 2019 Science X Network