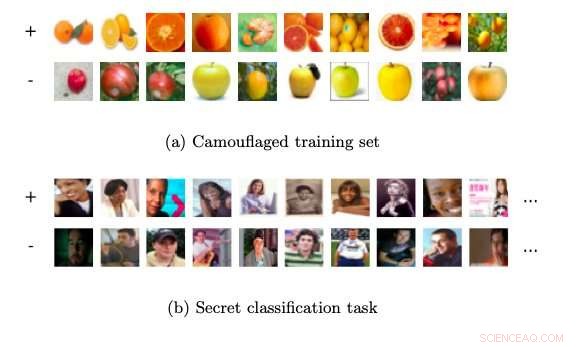

Exemplo de camuflagem de conjunto de treinamento. Crédito:Sen et al.

Pesquisadores da Universidade de Wisconsin-Madison e do Amherst College introduziram recentemente uma nova forma de esteganografia no domínio do aprendizado de máquina chamada "camuflagem de conjunto de treinamento". Sua estrutura, descrito em um artigo pré-publicado no arXiv, permite que um agente de aprendizado de máquina esconda a intenção e o objetivo de uma tarefa de um observador terceirizado.

A esteganografia é uma técnica de criptografia que protege ou oculta dados incorporando mensagens em outras mensagens. Em seu estudo recente, os pesquisadores da UW-Madison consideraram especificamente um cenário em que um agente de aprendizado de máquina (Alice), tenta treinar um segundo agente (Bob) em uma tarefa de classificação secreta, sem um terceiro agente bisbilhoteiro (Eva) sabendo disso.

"Imagine que Alice tem um conjunto de treinamento em uma tarefa ilícita de classificação de aprendizado de máquina, "os pesquisadores escrevem em seu artigo." Alice quer que Bob (um sistema de aprendizado de máquina) aprenda a tarefa. Contudo, enviar o conjunto de treinamento ou o modelo treinado para Bob pode levantar suspeitas se a comunicação for monitorada. "

No cenário imaginado pelos pesquisadores, um terceiro agente chamado Eva assume a função de verificador de dados que monitora as comunicações entre Alice e Bob. Quando Eva começa a suspeitar do que Alice está enviando a Bob, ela pode encerrar a comunicação entre eles, recusando-se a entregar os dados que estão trocando. Eve atua como uma auditora que está tentando descobrir se um conjunto de dados de treinamento é legítimo, antes de passá-lo para o aluno.

"O envio do conjunto de treinamento privado revelaria a intenção de Alice; o envio da direção dos parâmetros do modelo também levantará suspeitas, "os pesquisadores explicam em seu artigo." Alice deve camuflar a comunicação para que pareça mundana para Eve, evitando truques de codificação excessivos com Bob de antemão. "

A abordagem de esteganografia planejada pelos pesquisadores permite que Alice calcule um segundo conjunto de treinamento em uma tarefa de classificação totalmente diferente e aparentemente benigna, sem levantar suspeitas de Eva. Ele faz isso encontrando um conjunto de dados que parece que pode ser aplicado a uma tarefa específica, embora possa, de fato, ensinar um agente a ter um bom desempenho em uma tarefa diferente. Ao aplicar seu algoritmo de aprendizagem padrão a este segundo conjunto de treinamento, Bob pode recuperar aproximadamente o classificador na tarefa original.

A abordagem da estenografia planejada pelos pesquisadores foi um pouco por acaso, conforme surgiu de um projeto não relacionado na área de aprendizado de máquina. Um sistema que eles desenvolveram criou uma série de conjuntos de ensino, um dos quais incluía um ponto com rótulo incorreto. Isso os incentivou a investigar se um agente poderia ensinar outro agente como completar uma tarefa, enquanto o camufla com outra tarefa.

Os pesquisadores realizaram uma série de experimentos usando tarefas reais de classificação e demonstraram a viabilidade de sua abordagem. Seu estudo sugere que muitas informações podem ser ocultadas simplesmente aproveitando o fato de que, para qualquer tarefa, existem vários modelos que podem funcionar bem nele.

Alguns dos pesquisadores envolvidos no estudo realizam agora novos estudos na área de esteganografia. Outros, como Scott Alfeld, estão investigando cenários adversários em que um invasor perturba as instâncias de treinamento em um espaço contínuo, em vez de selecionar um subconjunto de exemplos, como no caso da camuflagem do conjunto de treinamento.

© 2019 Science X Network