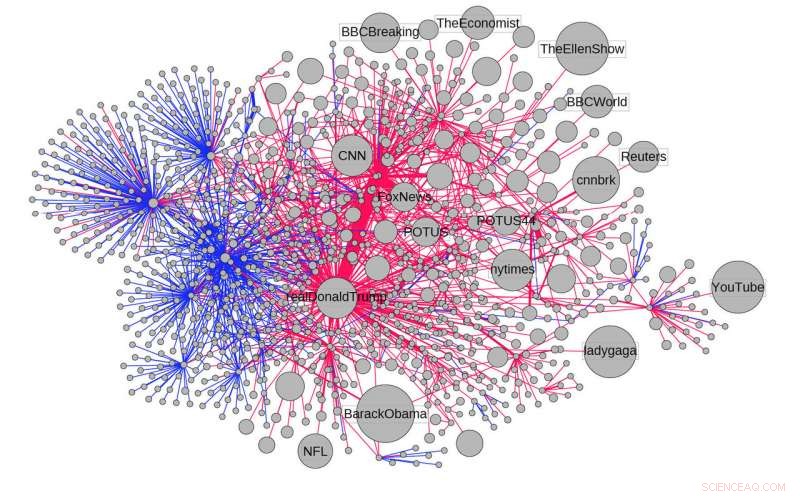

A disseminação de um artigo que afirmava que 3 milhões de imigrantes ilegais votaram nas eleições presidenciais de 2016 nos EUA. Os links mostram a propagação do artigo por meio de retuítes e tweets citados, Em azul, e respostas e menções, em vermelho. Crédito:Filippo Menczer, Indiana University

Uma análise das informações compartilhadas no Twitter durante a eleição presidencial dos EUA de 2016 descobriu que contas automatizadas - ou "bots" - desempenharam um papel desproporcional na disseminação de desinformação online.

O estudo, conduzido por pesquisadores da Universidade de Indiana e publicado em 20 de novembro na revista Nature Communications , analisou 14 milhões de mensagens e 400, 000 artigos compartilhados no Twitter entre maio de 2016 e março de 2017, um período que abrange o final das primárias presidenciais de 2016 e a posse presidencial em 20 de janeiro, 2017

Entre as descobertas:apenas 6% das contas do Twitter que o estudo identificou como bots foram suficientes para espalhar 31% das informações de "baixa credibilidade" na rede. Essas contas também foram responsáveis por 34 por cento de todos os artigos compartilhados de fontes de "baixa credibilidade".

O estudo também descobriu que os bots desempenharam um papel importante na promoção de conteúdo de baixa credibilidade nos primeiros momentos antes de uma história se tornar viral.

A breve duração desse tempo - 2 a 10 segundos - destaca os desafios de combater a disseminação de desinformação online. Problemas semelhantes são vistos em outros ambientes complexos, como o mercado de ações, onde problemas sérios podem surgir em poucos momentos devido ao impacto da negociação de alta frequência.

"Este estudo descobriu que os bots contribuem significativamente para a disseminação de desinformação online, bem como mostra a rapidez com que essas mensagens podem se espalhar, "disse Filippo Menczer, professor da IU School of Informatics, Computação e Engenharia, quem conduziu o estudo.

A análise também revelou que os bots amplificam o volume e a visibilidade de uma mensagem até que seja mais provável que seja amplamente compartilhada - apesar de representar apenas uma pequena fração das contas que espalham mensagens virais.

"As pessoas tendem a confiar mais nas mensagens que parecem vir de muitas pessoas, "disse o co-autor Giovanni Luca Ciampaglia, um cientista pesquisador assistente do IU Network Science Institute na época do estudo. "Os bots se aproveitam dessa confiança fazendo com que as mensagens pareçam tão populares que pessoas reais são induzidas a espalhar suas mensagens por elas."

As fontes de informação rotuladas como de baixa credibilidade no estudo foram identificadas com base em sua aparência em listas produzidas por organizações terceirizadas independentes de veículos que regularmente compartilham informações falsas ou enganosas. Essas fontes - como sites com nomes enganosos como "USAToday.com.co" - incluem veículos com pontos de vista inclinados para a direita e para a esquerda.

Os pesquisadores também identificaram outras táticas para espalhar informações incorretas com os bots do Twitter. Isso incluiu a amplificação de um único tweet - potencialmente controlado por um operador humano - em centenas de retuítes automatizados; repetir links em postagens recorrentes; e visando contas altamente influentes.

Por exemplo, o estudo cita um caso em que um único relato mencionou @realDonaldTrump em 19 mensagens separadas sobre milhões de imigrantes ilegais que votaram nas eleições presidenciais - uma afirmação falsa que também foi um importante ponto de discussão do governo.

Os pesquisadores também realizaram um experimento dentro de uma versão simulada do Twitter e descobriram que a exclusão de 10 por cento das contas no sistema - com base na probabilidade de serem bots - resultou em uma grande queda no número de histórias de fontes de baixa credibilidade na rede.

"Este experimento sugere que a eliminação de bots das redes sociais reduziria significativamente a quantidade de desinformação nessas redes, "Menczer disse.

O estudo também sugere medidas que as empresas podem tomar para retardar a disseminação de desinformações em suas redes. Isso inclui algoritmos aprimorados para detectar bots automaticamente e exigir um "contato humano" para reduzir as mensagens automatizadas no sistema. Por exemplo, os usuários podem ser solicitados a preencher um CAPTCHA para enviar uma mensagem.

Embora sua análise tenha se concentrado no Twitter, os autores do estudo acrescentaram que outras redes sociais também são vulneráveis à manipulação. Por exemplo, Plataformas como Snapchat e WhatsApp podem ter dificuldade em controlar a desinformação em suas redes porque o uso de criptografia e mensagens destrutíveis complica a capacidade de estudar como seus usuários compartilham informações.

"À medida que as pessoas em todo o mundo recorrem cada vez mais às redes sociais como sua principal fonte de notícias e informações, a luta contra a desinformação requer uma avaliação fundamentada do impacto relativo das diferentes formas como ela se espalha, "Menczer disse." Este trabalho confirma que os bots desempenham um papel no problema - e sugere que sua redução pode melhorar a situação. "

Para explorar as mensagens eleitorais atualmente compartilhadas no Twitter, O grupo de pesquisa de Menczer também lançou recentemente uma ferramenta para medir o "Volume eleitoral de bots". Criado por IU Ph.D. alunos, o programa exibe o nível de atividade do bot em torno de conversas específicas relacionadas a eleições, bem como os tópicos, nomes de usuário e hashtags que eles estão enviando no momento.