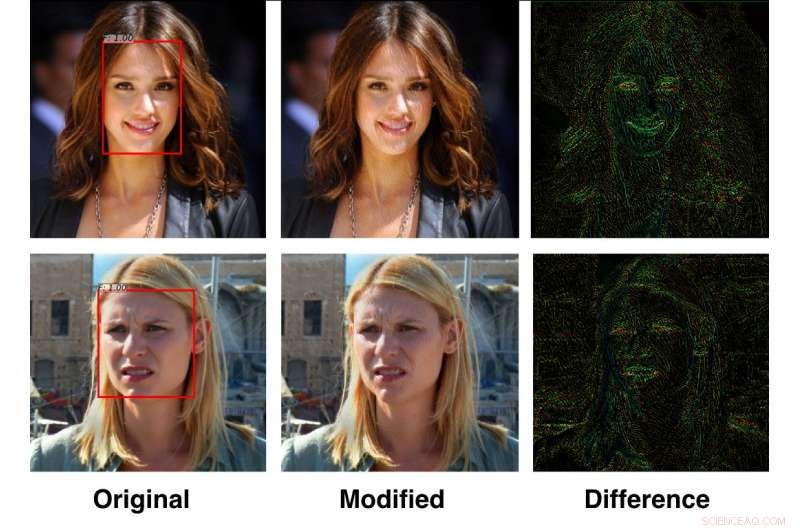

Pesquisadores da U of T Engineering projetaram um 'filtro de privacidade' que interrompe algoritmos de reconhecimento facial. O sistema conta com dois algoritmos criados por IA:um que realiza a detecção contínua de rosto, e outro projetado para interromper o primeiro. Crédito:Avishek Bose

Cada vez que você carrega uma foto ou vídeo em uma plataforma de mídia social, seus sistemas de reconhecimento facial aprendem um pouco mais sobre você. Esses algoritmos ingerem dados sobre quem você é, a sua localização e as pessoas que conhece - e estão a melhorar constantemente.

À medida que crescem as preocupações com a privacidade e a segurança dos dados nas redes sociais, Pesquisadores da U of T Engineering liderados pelo professor Parham Aarabi e o estudante de graduação Avishek Bose criaram um algoritmo para interromper dinamicamente os sistemas de reconhecimento facial.

"A privacidade pessoal é um problema real à medida que o reconhecimento facial se torna cada vez melhor, "diz Aarabi." Esta é uma maneira pela qual os sistemas anti-reconhecimento facial benéficos podem combater essa capacidade. "

A solução deles aproveita uma técnica de aprendizado profundo chamada treinamento adversarial, que coloca dois algoritmos de inteligência artificial um contra o outro. Aarabi e Bose projetaram um conjunto de duas redes neurais:a primeira trabalhando para identificar rostos, e o segundo trabalhando para interromper a tarefa de reconhecimento facial do primeiro. Os dois estão constantemente lutando e aprendendo um com o outro, estabelecendo uma corrida armamentista de IA contínua.

O resultado é um filtro semelhante ao do Instagram que pode ser aplicado às fotos para proteger a privacidade. Seu algoritmo altera pixels muito específicos na imagem, fazendo mudanças que são quase imperceptíveis ao olho humano.

"A IA perturbadora pode 'atacar' o que a rede neural para detecção de rosto está procurando, "diz Bose." Se a detecção de AI está procurando pelo canto dos olhos, por exemplo, ajusta o canto dos olhos para que sejam menos perceptíveis. Isso cria perturbações muito sutis na foto, mas para o detector são significativos o suficiente para enganar o sistema. "

Aarabi e Bose testaram seu sistema no conjunto de dados de face 300-W, um pool padrão da indústria de mais de 600 faces que inclui uma ampla gama de etnias, condições de iluminação e ambientes. Eles mostraram que seu sistema poderia reduzir a proporção de rostos originalmente detectáveis de quase 100% para 0,5%.

"A chave aqui era treinar as duas redes neurais uma contra a outra - com uma criando um sistema de detecção facial cada vez mais robusto, e a outra criando uma ferramenta cada vez mais forte para desativar a detecção facial, "diz Bose, o autor principal do projeto. O estudo da equipe será publicado e apresentado no Workshop Internacional IEEE 2018 sobre Processamento de Sinal Multimídia no final deste verão.

Além de desativar o reconhecimento facial, a nova tecnologia também interrompe a pesquisa baseada em imagens, identificação de recursos, estimativa de emoção e etnia, e todos os outros atributos baseados em rosto que podem ser extraídos automaticamente.

Próximo, a equipe espera disponibilizar publicamente o filtro de privacidade, por meio de um aplicativo ou site.

"Dez anos atrás, esses algoritmos teriam que ser definidos por humanos, mas agora as redes neurais aprendem por si mesmas - você não precisa fornecer nada a elas, exceto dados de treinamento, "diz Aarabi." No final, eles podem fazer coisas realmente incríveis. É um momento fascinante no campo, há um potencial enorme. "