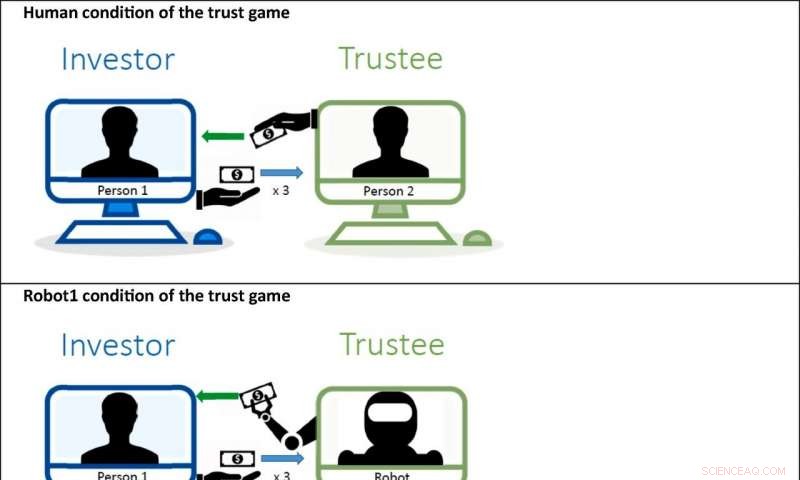

Na condição Humana, um participante humano (Pessoa 1) no papel de investidor é emparelhado com um participante humano (Pessoa 2) no papel de administrador. Na condição Robot1, um humano (Pessoa 1) no papel de investidor é emparelhado com um robô no papel de administrador. Na condição Robot2, um participante humano (Pessoa 1) na função de investidor é emparelhado com um robô na função de administrador que atua em nome de um participante passivo (Pessoa 2). Crédito:Chapman University

Em pesquisa publicada no Journal of Economic Psychology , os cientistas exploram se as pessoas confiam nos robôs como confiam em outros humanos. É importante entender essas interações porque as interações baseadas em confiança com robôs são cada vez mais comuns no mercado, local de trabalho, na estrada e em casa. Os resultados mostram que as pessoas estendem a confiança de forma semelhante a humanos e robôs, mas as reações emocionais das pessoas em interações baseadas na confiança variam dependendo do tipo de parceiro.

O estudo foi liderado por Eric Schniter da Chapman University, Ph.D. e Timothy Shields, Ph.D. junto com Daniel Sznycer da Universidade de Montreal, Ph.D.

Os pesquisadores usaram um experimento de jogo de confiança anônimo, durante o qual um fiador humano decidiu quanto de uma doação de $ 10 dar a um administrador - um humano, um robô, ou um robô cujas recompensas vão para outro humano. O fiduciário humano sabe que houve ganhos potenciais com a transferência e o fiduciário determinaria se deveria retribuir, transferindo de volta uma quantia. Os robôs foram programados para imitar a reciprocidade observada anteriormente por administradores humanos.

Está bem estabelecido que em jogos de confiança como este, a maioria das pessoas toma decisões que levam a benefícios tanto para o administrador quanto para o administrador. Após a interação, participantes avaliaram várias emoções positivas e negativas.

O projeto experimental permitiu aos pesquisadores explicar dois aspectos importantes da confiança em robôs explicáveis:o quanto os humanos confiam nos robôs em comparação com outros humanos e os padrões de como os humanos reagem emocionalmente após interações com robôs versus outros humanos.

O experimento mostra que as pessoas estendem níveis semelhantes de confiança a humanos e robôs. Isso não é o que descobriríamos se os humanos confiassem cegamente ou se recusassem a confiar nos robôs. Este também não seria o resultado se acreditarmos que as pessoas estendem a confiança com a única intenção de melhorar o bem-estar de outros humanos, já que confiar em um robô não melhora o bem-estar de outra pessoa.

O resultado é consistente com a visão de que as pessoas confiam tanto para ganho monetário quanto para descobrir informações sobre as propensões comportamentais humanas. Por meio de suas interações de confiança com os robôs, os participantes aprenderam sobre a cooperação de outros humanos.

As emoções sociais são mais do que sentimentos - regulam o comportamento social. Mais especificamente, emoções sociais, como culpa, gratidão, raiva, e o orgulho afetam a forma como tratamos os outros e influenciam como os outros nos tratam em interações baseadas na confiança.

Os participantes desse experimento experimentaram emoções sociais de maneira diferente, dependendo se seu parceiro era um robô ou humano. A falha em retribuir o investimento do fideicomissário no fiduciário gerou mais raiva quando o trustee era humano do que quando o fiduciário era um robô. De forma similar, a reciprocidade gerava mais gratidão quando o curador era humano do que quando o curador era um robô.

Avançar, as emoções dos participantes discriminadas com precisão entre os tipos de robôs. Eles relataram sentir orgulho e culpa mais intensos quando a recompensa do curador robô foi para um humano do que quando o robô agiu sozinho.

Dado que a confiança inicial não difere entre o tipo de parceiro, mas as emoções sociais sim, uma possibilidade distinta é que a extensão da confiança em interações repetidas será diferente quando o parceiro é um humano, um robô, ou um robô ligado a um beneficiário humano.

No futuro, dirigir apresentará oportunidades de interação em que será importante se as decisões estão sendo feitas por humanos ou robôs e se eles servem aos humanos ou não. Alguns carros usados para entrega ou coleta podem dirigir sem ocupantes humanos, outros carros serão dirigidos com ocupantes humanos passivos e ainda outros carros serão dirigidos por motoristas humanos. Interações análogas ocorrem com agentes de check-in automatizado ou robótico, caixas de banco, cirurgiões, etc.

Parcerias com reciprocadores consistentes podem se consolidar em mais fortes, parcerias mais produtivas quando os reciprocadores são outros humanos, porque os humanos despertam mais gratidão do que os robôs. Por outro lado, parcerias com reciprocadores inconsistentes podem ser mais estáveis quando os reciprocadores são robôs, porque os robôs provocam menos raiva do que os humanos. Avançar, os humanos experimentaram orgulho e culpa mais intensamente nas interações em que os robôs serviram a um beneficiário, o que sugere que as pessoas estarão mais propensas a estender novamente a confiança a parceiros semelhantes.

A arquitetura cognitiva humana evoluiu para ter estrutura e conteúdo suficientes para promover a sobrevivência e reprodução de nossos ancestrais, além de ter a flexibilidade de navegar por novos desafios e oportunidades. Esses recursos permitem que os humanos projetem e interajam racionalmente com a inteligência artificial e os robôs. Ainda, interações com autômatos, e a capacidade da ciência de explicar essas interações é imperfeita porque os autômatos carecem das pistas psicofísicas que esperamos em uma interação e são freqüentemente guiados por lógicas de decisão inexplicáveis ou não intuitivas.