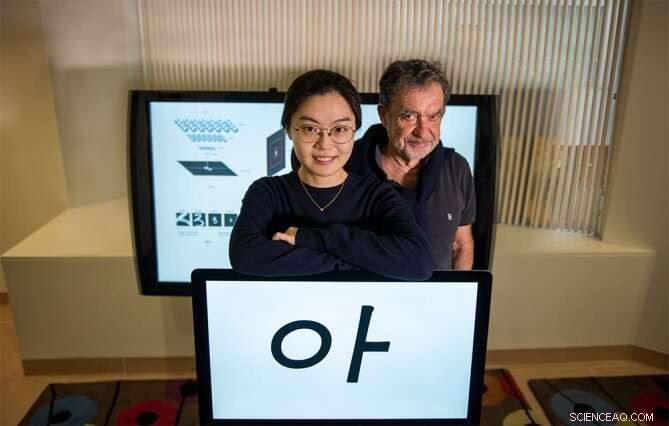

Yena Han (à esquerda) e Tomaso Poggio mostram um exemplo de estímulo visual usado em um novo estudo psicofísico. Crédito:Kris Brewer

Suponha que você olhe rapidamente a alguns metros de distância para uma pessoa que nunca conheceu antes. Dê alguns passos para trás e olhe novamente. Você será capaz de reconhecer o rosto dela? "Sim, claro, "você provavelmente está pensando. Se isso for verdade, significaria que nosso sistema visual, ter visto uma única imagem de um objeto, como um rosto específico, reconhece-o de forma robusta, apesar das mudanças na posição e escala do objeto, por exemplo. Por outro lado, sabemos que classificadores de última geração, como redes profundas vanilla, irá falhar neste teste simples.

Para reconhecer um rosto específico sob uma série de transformações, as redes neurais precisam ser treinadas com muitos exemplos da face nas diferentes condições. Em outras palavras, eles podem atingir invariância por meio da memorização, mas não pode fazê-lo se apenas uma imagem estiver disponível. Assim, compreender como a visão humana pode realizar esse feito notável é relevante para engenheiros que desejam melhorar seus classificadores existentes. Também é importante para os neurocientistas modelarem o sistema visual dos primatas com redes profundas. Em particular, é possível que a invariância com o aprendizado de uma tentativa exibida pela visão biológica requeira uma estratégia computacional bastante diferente daquela das redes profundas.

Um novo artigo do MIT Ph.D. candidato em engenharia elétrica e ciência da computação Yena Han e colegas em Nature Scientific Reports , intitulado "Escala e invariância de tradução para novos objetos na visão humana, "discute como eles estudam esse fenômeno com mais cuidado para criar novas redes de inspiração biológica.

"Os humanos podem aprender com poucos exemplos, ao contrário de redes profundas. Esta é uma grande diferença com vastas implicações para a engenharia de sistemas de visão e para a compreensão de como a visão humana realmente funciona, "afirma o coautor Tomaso Poggio - diretor do Center for Brains, Mentes e Máquinas (CBMM) e o Professor Eugene McDermott de Cérebro e Ciências Cognitivas no MIT. "Um dos principais motivos para essa diferença é a invariância relativa do sistema visual dos primatas à escala, mudança, e outras transformações. Estranhamente, isso tem sido negligenciado principalmente na comunidade de IA, em parte porque os dados psicofísicos eram muito menos claros. O trabalho de Han já estabeleceu medidas sólidas de invariâncias básicas da visão humana. "

Para diferenciar o aumento da invariância da computação intrínseca com a da experiência e memorização, o novo estudo mediu o intervalo de invariância no aprendizado de uma tentativa. Uma tarefa de aprendizagem única foi realizada apresentando estímulos de letras coreanas para seres humanos que não estavam familiarizados com o idioma. Essas letras foram inicialmente apresentadas uma única vez sob uma condição específica e testadas em escalas ou posições diferentes da condição original. O primeiro resultado experimental é que - exatamente como você adivinhou - os humanos mostraram um reconhecimento invariante de escala significativo após apenas uma única exposição a esses novos objetos. O segundo resultado é que o intervalo de invariância de posição é limitado, dependendo do tamanho e localização dos objetos.

Próximo, Han e seus colegas realizaram um experimento comparável em redes neurais profundas projetadas para reproduzir esse desempenho humano. Os resultados sugerem que, para explicar o reconhecimento invariante de objetos por humanos, modelos de rede neural devem incorporar explicitamente invariância de escala embutida. Além disso, A invariância de posição limitada da visão humana é melhor replicada na rede fazendo com que os campos receptivos dos neurônios modelo aumentem à medida que eles estão mais distantes do centro do campo visual. Esta arquitetura é diferente dos modelos de rede neural comumente usados, onde uma imagem é processada em resolução uniforme com os mesmos filtros compartilhados.

"Nosso trabalho fornece uma nova compreensão da representação do cérebro de objetos sob diferentes pontos de vista. Também tem implicações para a IA, como os resultados fornecem novos insights sobre o que é um bom projeto arquitetônico para redes neurais profundas, "comenta Han, Pesquisador do CBMM e principal autor do estudo.

Esta história foi republicada por cortesia do MIT News (web.mit.edu/newsoffice/), um site popular que cobre notícias sobre pesquisas do MIT, inovação e ensino.