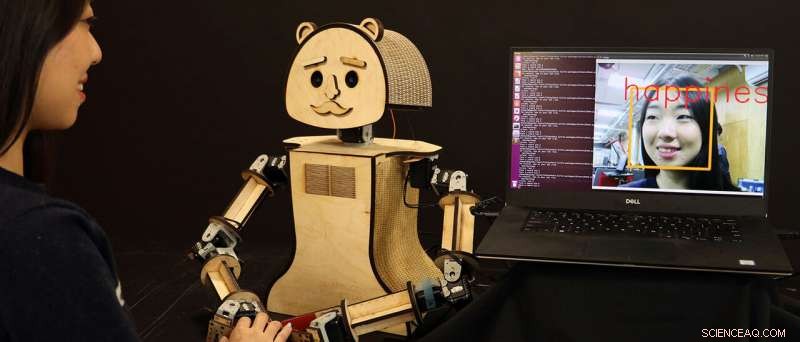

"Woody, "um robô social de baixo custo, está lendo as emoções no rosto do humano, com base nos algoritmos que estão sendo desenvolvidos pela pesquisadora Kiju Lee e sua equipe na Case Western Reserve University. Crédito:Case Western Reserve University

Os robôs estão ficando mais espertos - e mais rápidos - em saber o que os humanos estão sentindo e pensando apenas "olhando" em seus rostos, um desenvolvimento que pode um dia permitir que máquinas mais perceptíveis emocionalmente detectem mudanças na saúde ou no estado mental de uma pessoa.

Pesquisadores da Case Western Reserve University dizem que estão aprimorando a inteligência artificial (IA) que agora alimenta os videogames interativos e que em breve aprimorará a próxima geração de robôs personalizados que provavelmente coexistirão com humanos.

E os robôs da Case Western Reserve estão fazendo isso em tempo real.

Novas máquinas desenvolvidas por Kiju Lee, o Distinguished Assistant Professor da Nord em engenharia mecânica e aeroespacial na Case School of Engineering, e o estudante de graduação Xiao Liu, estão identificando corretamente as emoções humanas a partir de expressões faciais 98 por cento das vezes - quase que instantaneamente. Os resultados anteriores de outros pesquisadores alcançaram resultados semelhantes, mas os robôs freqüentemente respondiam muito devagar.

"Mesmo uma pausa de três segundos pode ser estranha, "Disse Lee." É difícil o suficiente para os humanos - e ainda mais difícil para os robôs - descobrir o que alguém sente com base apenas em suas expressões faciais ou linguagem corporal. "Todas as camadas e mais camadas de tecnologia - incluindo a captura de vídeo - para fazer isso, infelizmente, também retarda a resposta."

Lee e Liu aceleraram o tempo de resposta combinando dois filtros de vídeo de pré-processamento a outro par de programas existentes para ajudar o robô a classificar emoções com base em mais de 3, 500 variações na expressão facial humana.

Mas essa dificilmente é a extensão da nossa variação facial:humanos podem registrar mais de 10, 000 expressões, e cada um também tem uma maneira única de revelar muitas dessas emoções, Lee disse.

Mas os computadores de "aprendizado profundo" podem processar grandes quantidades de informações, uma vez que esses dados são inseridos no software e classificados.

E, agradecidamente, as características expressivas mais comuns entre os humanos são facilmente divididas em sete emoções:neutras, felicidade, raiva, tristeza, desgosto, surpresa e medo - mesmo levando em conta as variações entre diferentes origens e culturas.

Aplicativos agora e no futuro

Este trabalho recente de Lee e Liu, revelado nos Jogos IEEE 2018, Entretenimento, e conferência de mídia, pode levar a uma série de aplicações quando combinada com avanços de dezenas de outros pesquisadores no campo da IA, Lee disse.

Os dois também estão trabalhando em outra abordagem baseada em aprendizado de máquina para reconhecimento de emoção facial, que até agora alcançou mais de 99 por cento de precisão com eficiência computacional ainda maior.

Algum dia, um robô pessoal pode ser capaz de notar com precisão mudanças significativas em uma pessoa por meio da interação diária - mesmo ao ponto de detectar os primeiros sinais de depressão, por exemplo.

"O robô pode ser programado para detectá-lo cedo e ajudar em intervenções simples, como música e vídeo, para pessoas que precisam de terapias sociais, "Disse Lee." Isso pode ser muito útil para adultos mais velhos que podem estar sofrendo de depressão ou alterações de personalidade associadas ao envelhecimento. "

Lee está planejando explorar o uso potencial de robôs sociais para intervenção social e emocional em adultos mais velhos por meio da colaboração com Ohio Living Breckenridge Village. Espera-se que os residentes idosos interajam com um ambiente amigável, robô socialmente interativo e ajuda a testar a precisão e confiabilidade dos algoritmos incorporados.

Outra possibilidade futura:um robô social que aprende as mudanças faciais mais sutis em alguém no espectro do autismo - e que ajuda a "ensinar" os humanos a reconhecerem com precisão as emoções uns dos outros.

"Esses robôs sociais levarão algum tempo para serem detectados nos EUA, "Disse Lee." Mas em lugares como o Japão, onde existe uma forte cultura em torno de robôs, isso já está começando a acontecer. Em todo o caso, nosso futuro estará lado a lado com robôs emocionalmente inteligentes. "