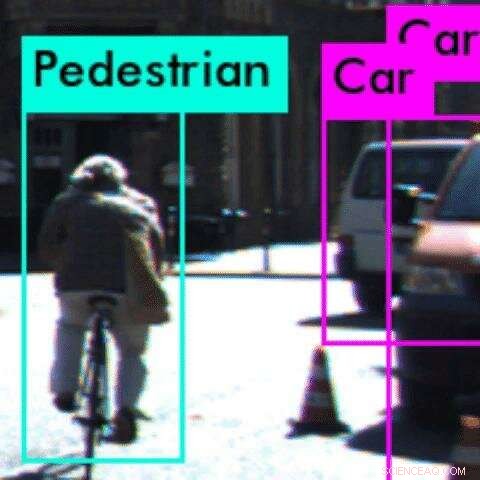

Neste exemplo, um algoritmo de percepção classifica erroneamente o ciclista como um pedestre Crédito:Anand Balakrishnan

É uma grande questão para muitas pessoas em cidades com tráfego intenso como Los Angeles:quando chegarão os carros autônomos? Mas, após uma série de acidentes de grande repercussão nos Estados Unidos, questões de segurança podem levar o sonho autônomo a uma parada brusca.

Na USC, pesquisadores publicaram um novo estudo que aborda um problema de longa data para desenvolvedores de veículos autônomos:testar os algoritmos de percepção do sistema, que permitem ao carro "entender" o que "vê".

Trabalhando com pesquisadores da Arizona State University, o novo método matemático da equipe é capaz de identificar anomalias ou bugs no sistema antes de o carro cair na estrada.

Os algoritmos de percepção são baseados em redes neurais convolucionais, alimentado por aprendizado de máquina, um tipo de aprendizado profundo. Esses algoritmos são notoriamente difíceis de testar, já que não entendemos totalmente como eles fazem suas previsões. Isso pode levar a consequências devastadoras em sistemas críticos para a segurança, como veículos autônomos.

"Tornar algoritmos de percepção robustos é um dos principais desafios para sistemas autônomos, "disse o principal autor do estudo, Anand Balakrishnan, um doutor em ciência da computação da USC estudante.

"Usando este método, os desenvolvedores podem restringir os erros nos algoritmos de percepção com muito mais rapidez e usar essas informações para treinar ainda mais o sistema. Da mesma forma que os carros passam por testes de colisão para garantir a segurança, este método oferece um teste preventivo para detectar erros em sistemas autônomos. "

O papel, intitulado Especificando e Avaliando Métricas de Qualidade para Sistemas de Percepção Baseados na Visão, foi apresentado no Design, Conferência de Automação e Teste na Europa na Itália, 28 de março.

Aprendendo sobre o mundo

Veículos normalmente autônomos "aprendem" sobre o mundo por meio de sistemas de aprendizado de máquina, que são alimentados com enormes conjuntos de dados de imagens de estradas antes que possam identificar objetos por conta própria.

Mas o sistema pode dar errado. No caso de um acidente fatal entre um carro que dirige sozinho e um pedestre no Arizona em março passado, o software classificou o pedestre como "falso positivo" e decidiu que ele não precisava parar.

"Nós pensamos, claramente, há algum problema com a forma como este algoritmo de percepção foi treinado, "disse o co-autor do estudo Jyo Deshmukh, um professor de ciência da computação da USC e ex-engenheiro de pesquisa e desenvolvimento da Toyota, especializada em segurança de veículos autônomos.

“Quando um ser humano vê um vídeo, existem certas suposições sobre persistência que usamos implicitamente:se vemos um carro dentro de um quadro de vídeo, esperamos ver um carro em um local próximo no próximo quadro de vídeo. Esta é uma das várias 'condições de sanidade' que desejamos que o algoritmo de percepção satisfaça antes da implantação. "

Por exemplo, um objeto não pode aparecer e desaparecer de um quadro para o outro. Se isso acontecer, viola uma "condição de sanidade, "ou lei básica da física, o que sugere que há um bug no sistema de percepção.

Deshmukh e seu Ph.D. estudante Balakrishnan, junto com USC Ph.D. o aluno Xin Qin e o aluno de mestrado Aniruddh Puranic, se juntou a três pesquisadores da Arizona State University para investigar o problema.

Sem margem para erro

A equipe formulou uma nova lógica matemática, chamado Timed Quality Temporal Logic, e o usei para testar duas ferramentas populares de aprendizado de máquina - Squeeze Det e YOLO - usando conjuntos de dados de vídeo brutos de cenas de direção.

A lógica foi aprimorada com sucesso em instâncias das ferramentas de aprendizado de máquina que violam as "condições de sanidade" em vários quadros do vídeo. Mais comumente, os sistemas de aprendizado de máquina não conseguiram detectar um objeto ou classificaram incorretamente um objeto.

Por exemplo, em um exemplo, o sistema falhou em reconhecer um ciclista de costas, quando o pneu da bicicleta parecia uma linha vertical fina. Em vez de, classificou erroneamente o ciclista como pedestre. Nesse caso, o sistema pode falhar em antecipar corretamente o próximo movimento do ciclista, o que pode causar um acidente.

Objetos fantasmas - onde o sistema percebe um objeto quando não há nenhum - também eram comuns. Isso poderia fazer com que o carro batesse no freio por engano - outro movimento potencialmente perigoso.

O método da equipe pode ser usado para identificar anomalias ou bugs no algoritmo de percepção antes da implantação na estrada e permite que o desenvolvedor localize problemas específicos.

A ideia é detectar problemas com algoritmo de percepção em testes virtuais, tornando os algoritmos mais seguros e confiáveis. Crucialmente, porque o método depende de uma biblioteca de "condições de sanidade, "não há necessidade de os humanos rotularem os objetos no conjunto de dados de teste - um processo demorado e frequentemente falho.

No futuro, a equipe espera incorporar a lógica para retreinar os algoritmos de percepção quando encontrar um erro. Também pode ser estendido para uso em tempo real, enquanto o carro está dirigindo, como um monitor de segurança em tempo real.