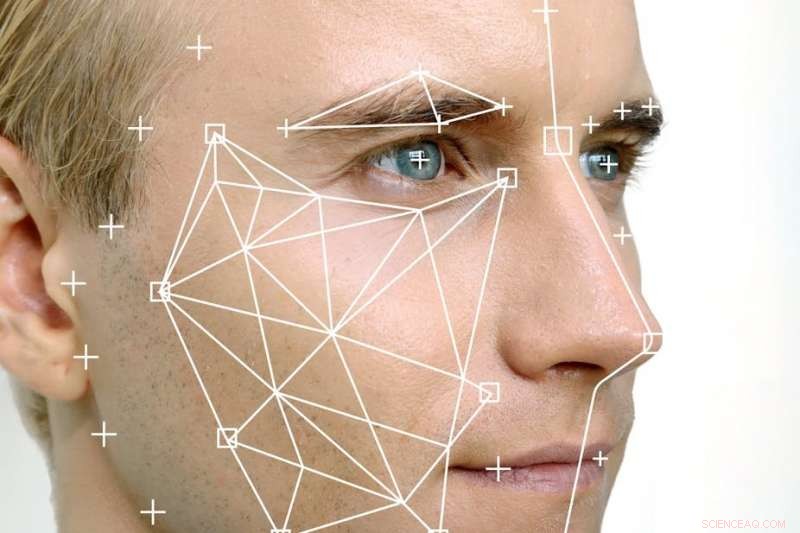

Há muitas perguntas sobre como a tecnologia de reconhecimento facial pode interferir nos direitos de privacidade das pessoas e se vai piorar a discriminação nas práticas de policiamento. Crédito:Shutterstock

O uso de tecnologia de reconhecimento facial automatizado (FRT) está se tornando mais comum em todo o mundo, em particular na China, o Reino Unido e agora a Austrália.

FRT significa que podemos identificar indivíduos com base em uma análise de suas características faciais geométricas, traçar uma comparação entre um algoritmo criado a partir da imagem capturada e outro já armazenado, como uma carteira de motorista, imagem de custódia ou conta nas redes sociais.

O FRT tem várias aplicações nos setores público e privado quando a verificação de identidade é necessária. Isso inclui o acesso a uma área segura, desbloquear um dispositivo móvel ou embarcar em um avião. Também é capaz de reconhecer o humor das pessoas, reações e, pelo visto, sexualidade.

E é mais valioso para policiamento do que câmeras de CFTV comuns, pois pode identificar indivíduos em tempo real e vinculá-los às imagens armazenadas. Isso é de grande valor para o estado nas investigações criminais, operações de combate ao terrorismo e controle de fronteiras.

Como isso interfere nos direitos de privacidade

Mas a implantação do FRT, que já está sendo usado pela AFP e pelas forças policiais estaduais e por empresas privadas em outros lugares (aeroportos, instalações esportivas, bancos e shopping centers), é sub-regulamentado e baseado em algoritmos questionáveis que não são publicamente transparentes.

Esta tecnologia tem implicações importantes para os direitos de privacidade das pessoas, e seu uso pode piorar os preconceitos e a discriminação existentes nas práticas de policiamento.

O uso de FRT interfere nos direitos de privacidade ao criar um algoritmo de características pessoais únicas. Isso, por sua vez, reduz as características das pessoas a dados e permite seu monitoramento e vigilância. Esses dados e imagens também serão armazenados por um determinado período de tempo, abrindo a possibilidade de hackear ou fraudar.

Além disso, A FRT pode expor as pessoas a potenciais discriminações de duas maneiras. Primeiro, agências estaduais podem usar indevidamente as tecnologias em relação a certos grupos demográficos, seja intencionalmente ou de outra forma.

E em segundo lugar, pesquisas indicam que as minorias étnicas, pessoas de cor e mulheres são erroneamente identificadas pela FRT em taxas mais altas do que o resto da população. Essa imprecisão pode fazer com que membros de certos grupos sejam sujeitos a policiamento pesado ou medidas de segurança e seus dados sejam retidos de forma inadequada.

Isso é particularmente relevante em relação às comunidades que já são visadas de forma desproporcional na Austrália.

O que os legisladores estão tentando fazer

O Parlamento elaborou um projeto de lei em um esforço para regulamentar este espaço, mas deixa muito a desejar. O projeto está em segunda leitura; nenhuma data foi marcada para uma votação.

Se aprovado, o projeto permitiria a troca de informações de identidade entre o governo da Commonwealth, governos estaduais e territoriais e "entidades não governamentais" (que não foram especificadas) por meio da criação de um hub central denominado "The Capability", bem como a solução de reconhecimento facial de carteira de motorista nacional, um banco de dados de informações contidas em documentos de identidade do governo, como carteiras de motorista.

O projeto também autorizaria o Departamento de Assuntos Internos a cobrar, usar e compartilhar informações de identificação em relação a uma série de atividades, como prevenção de fraude, aplicação da lei, segurança da comunidade, e segurança rodoviária.

Seria muito preferível que tal legislação permitisse o compartilhamento de identidade apenas para uma gama limitada de crimes graves. Como escrito, este projeto de lei se refere a pessoas que não foram condenadas por quaisquer crimes - e, na verdade, não precisa ser suspeito de qualquer ofensa.

Também, o povo australiano não consentiu que seus dados fossem compartilhados desta forma. Tal compartilhamento teria um efeito desproporcional em nosso direito à privacidade.

Mais importante, a violação do direito à privacidade é agravada pelo fato de que o projeto de lei permitiria ao setor privado acessar os serviços de correspondência de identidade. Embora o setor privado já use tecnologias de comparação e verificação de imagens em algum grau, como por bancos que buscam detectar lavagem de dinheiro, por exemplo, o projeto de lei estenderia isso. O projeto de lei não fornece salvaguardas ou penalidades suficientes para entidades privadas se elas usarem o hub ou os dados das pessoas de forma inadequada.

A prevalência de falsos positivos em correspondências de identidade

Em um sentido prático, também existem preocupações sobre a confiabilidade e precisão do FRT, que está se desenvolvendo rapidamente, mas não sem grandes problemas. Se esses problemas são apenas bugs ou uma característica do FRT, resta saber.

A experiência do Reino Unido ilustra claramente essas questões. Polícia de Gales do Sul, a liderança nacional britânica em tecnologia de reconhecimento facial, usou o sistema desenvolvido por uma empresa australiana privada chamada Neoface em 18 encontros públicos entre maio de 2017 e março de 2018. Ele descobriu que 91% das correspondências, ou 2, 451 instâncias, identificou incorretamente membros inocentes do público como estando em uma lista de observação. A supervisão manual do programa revelou que as correspondências eram falsos-positivos.

A Polícia Metropolitana de Londres também está executando um piloto de FRT. Registrou números um pouco melhores, mas ainda tinha uma taxa de identificação de falso-negativo de 30% no Carnaval de Notting Hill e 22% no Dia da Memória, ambos em 2017.

O papel central das empresas privadas no desenvolvimento desta tecnologia também é importante assinalar. Os algoritmos FRT são patenteados, e não há indicação publicamente disponível da medição ou padrão que representa uma "correspondência" de identidade.

Legislando em um movimento rápido, o espaço impulsionado pela tecnologia não é uma tarefa invejável. Existe algum benefício em um certo grau de flexibilidade nas definições e regras legais, para que a lei não se torne estática e redundante tão cedo. Mas mesmo a interpretação mais generosa do projeto de lei admitiria que é uma forma falha de regular o uso de uma tecnologia poderosa e problemática que veio para ficar, goste ou não.

Este artigo foi republicado de The Conversation sob uma licença Creative Commons. Leia o artigo original.