Crédito CC0:domínio público

Uma nova pesquisa massiva desenvolvida por pesquisadores do MIT revela algumas preferências globais distintas em relação à ética dos veículos autônomos, bem como algumas variações regionais nessas preferências.

A pesquisa tem alcance global e escala única, com mais de 2 milhões de participantes online de mais de 200 países, avaliando as versões de um dilema ético clássico, o "Problema do carrinho". O problema envolve cenários em que um acidente envolvendo um veículo é iminente, e o veículo deve optar por uma das duas opções potencialmente fatais. No caso de carros sem motorista, isso pode significar desviar em direção a algumas pessoas, em vez de um grande grupo de espectadores.

"O estudo está basicamente tentando entender os tipos de decisões morais a que os carros sem motorista podem ter que recorrer, "diz Edmond Awad, pós-doutorado no MIT Media Lab e autor principal de um novo artigo que descreve os resultados do projeto. "Não sabemos ainda como eles deveriam fazer isso."

Ainda, Awad acrescenta, "Descobrimos que existem três elementos que as pessoas parecem aprovar mais."

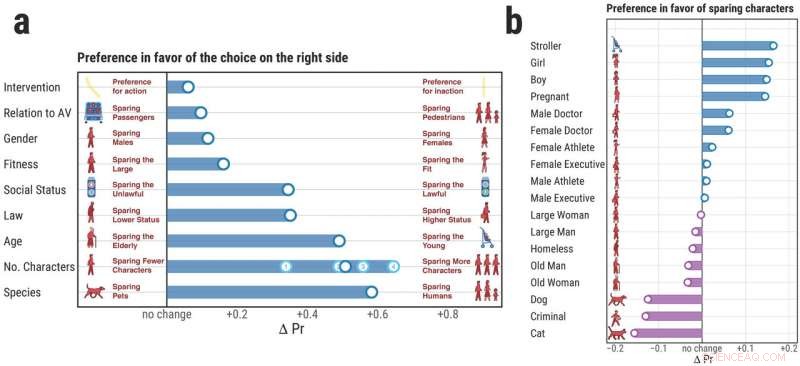

De fato, as preferências globais mais enfáticas na pesquisa são por poupar a vida dos humanos em vez da vida de outros animais; poupando a vida de muitas pessoas em vez de algumas; e preservando a vida dos jovens, em vez de pessoas mais velhas.

"As principais preferências foram, até certo ponto, universalmente aceitas, "Awad observa." Mas o grau em que eles concordam ou não com isso varia entre os diferentes grupos ou países. "Por exemplo, os pesquisadores descobriram uma tendência menos pronunciada de favorecer pessoas mais jovens, ao invés dos idosos, no que eles definiram como um agrupamento "oriental" de países, incluindo muitos na Ásia.

O papel, "O Experimento Moral Machine, "está sendo publicado em Natureza .

Os autores são Awad; Sohan Dsouza, aluno de doutorado no Media Lab; Richard Kim, assistente de pesquisa no Media Lab; Jonathan Schulz, um pós-doutorado na Universidade de Harvard; Joseph Henrich, professor em Harvard; Azim Shariff, professor associado da University of British Columbia; Jean-François Bonnefon, professor da Toulouse School of Economics; e Iyad Rahwan, professor associado de artes e ciências da mídia no Media Lab.

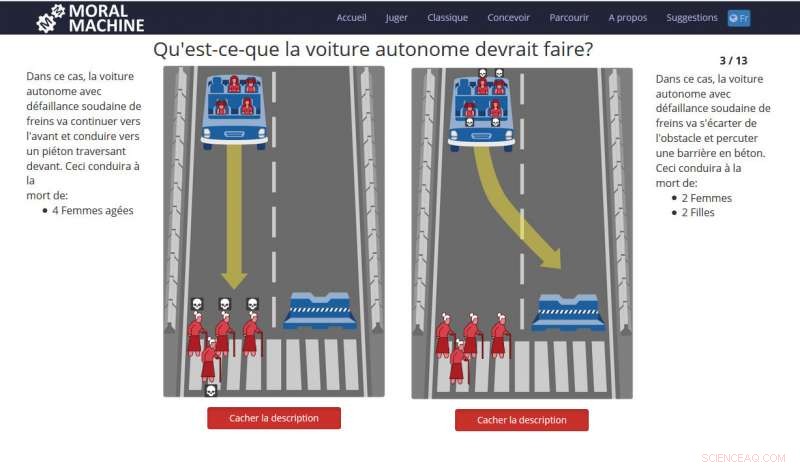

Exemplo de uma situação proposta na plataforma Moral Machine. Crédito:Edmond Awad et al. Natureza.

Awad é pós-doutorado no grupo de Cooperação Escalável do MIT Media Lab, que é liderado por Rahwan.

Para realizar a pesquisa, os pesquisadores projetaram o que eles chamam de "Máquina Moral, "um jogo online multilíngue no qual os participantes podem expressar suas preferências em relação a uma série de dilemas que os veículos autônomos podem enfrentar. Por exemplo:devem os veículos autônomos poupar a vida de observadores cumpridores da lei, ou, alternadamente, pedestres infratores que podem estar transando? (A maioria das pessoas na pesquisa optou pelo primeiro.)

Tudo dito, "Moral Machine" compilou quase 40 milhões de decisões individuais de entrevistados em 233 países; a pesquisa coletou 100 ou mais respostas de 130 países. Os pesquisadores analisaram os dados como um todo, ao mesmo tempo que divide os participantes em subgrupos definidos por idade, Educação, Gênero sexual, renda, e visões políticas e religiosas. Havia 491, 921 entrevistados que ofereceram dados demográficos.

Os estudiosos não encontraram diferenças marcantes nas preferências morais com base nessas características demográficas, mas encontraram "grupos" maiores de preferências morais com base em afiliações culturais e geográficas. Eles definiram "ocidental, " "Oriental, grupos de países "e" sul ", e encontrou algumas variações mais pronunciadas ao longo dessas linhas. Por exemplo:os entrevistados em países do sul tiveram uma tendência relativamente mais forte de favorecer a poupança de jovens em vez de idosos, especialmente em comparação com o cluster oriental.

Diagrama que apresenta a diferença entre a probabilidade de diferentes categorias de pessoas serem poupadas em um acidente de carro. Nesse caso, a diferença está a favor das pessoas do lado direito. Fig. B:Vantagem ou desvantagem relativa para cada categoria de pessoas em relação a um adulto (homem ou mulher). Por exemplo, a probabilidade de uma criança ser uma menina ser poupada é 0,15 maior que a de um adulto ser poupado. Crédito:Edmond Awad et al. Natureza.

Awad sugere que o reconhecimento desses tipos de preferências deve ser uma parte básica para informar a discussão na esfera pública dessas questões. Em todas as regiões, uma vez que há uma preferência moderada por poupar espectadores cumpridores da lei em vez de transgressores, conhecer essas preferências poderia, em teoria, informar a maneira como o software é escrito para controlar veículos autônomos.

"The question is whether these differences in preferences will matter in terms of people's adoption of the new technology when [vehicles] employ a specific rule, " ele diz.

Rahwan, for his part, notes that "public interest in the platform surpassed our wildest expectations, " allowing the researchers to conduct a survey that raised awareness about automation and ethics while also yielding specific public-opinion information.

"Por um lado, we wanted to provide a simple way for the public to engage in an important societal discussion, " Rahwan says. "On the other hand, we wanted to collect data to identify which factors people think are important for autonomous cars to use in resolving ethical tradeoffs."

Beyond the results of the survey, Awad suggests, seeking public input about an issue of innovation and public safety should continue to become a larger part of the dialogue surrounding autonomous vehicles.

"What we have tried to do in this project, and what I would hope becomes more common, is to create public engagement in these sorts of decisions, " Awad says.