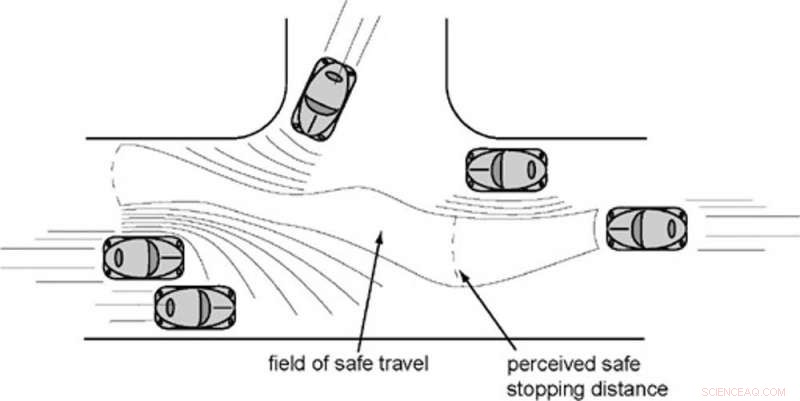

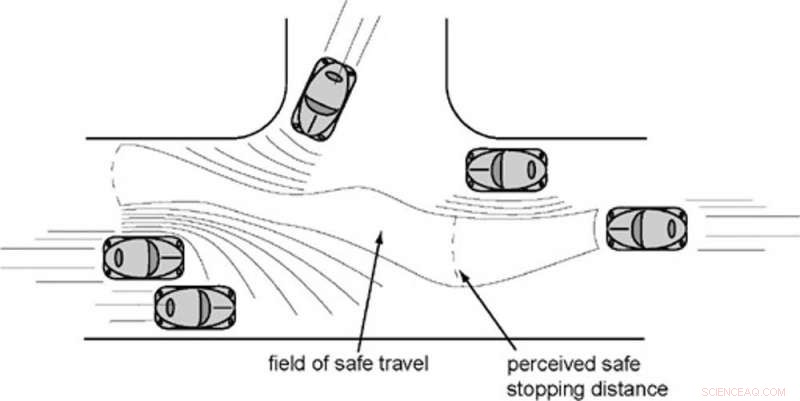

p O motorista do carro à direita avalia um caminho seguro através dos obstáculos com base em seus movimentos e distâncias de parada percebidas. Crédito:Adaptado de Gibson and Crooks por Steven Lehar

p O motorista do carro à direita avalia um caminho seguro através dos obstáculos com base em seus movimentos e distâncias de parada percebidas. Crédito:Adaptado de Gibson and Crooks por Steven Lehar

p Em 1938, quando havia cerca de um décimo do número de carros nas estradas dos EUA como hoje, um psicólogo brilhante e um engenheiro pragmático uniram forças para escrever uma das obras mais influentes já publicadas sobre a direção. A morte de um pedestre por um carro que dirige sozinho no Arizona mostra como seu trabalho ainda é relevante hoje - especialmente no que diz respeito à segurança de veículos automatizados e autônomos. p James Gibson, o psicólogo em questão, e o engenheiro Laurence Crooks, seu parceiro, avaliou o controle de um motorista de um veículo de duas maneiras. O primeiro foi medir o que eles chamam de "zona de parada mínima, "a distância que levaria para parar depois que o motorista pisasse no freio. A segunda era olhar para a percepção psicológica do motorista dos possíveis perigos ao redor do veículo, que eles chamam de "campo de viagem segura". Se alguém dirigisse de forma que todos os perigos potenciais estivessem fora do intervalo necessário para parar o carro, essa pessoa estava dirigindo com segurança. Direção insegura, por outro lado, envolvia ir tão rápido ou dirigir tão erraticamente que o carro não conseguia parar antes de atingir os perigos identificados.

p Contudo, este campo de viagens seguras não é o mesmo para carros sem motorista. Eles percebem o mundo ao seu redor usando lasers, radar, GPS e outros sensores, além de suas câmeras de bordo. Portanto, suas percepções podem ser muito diferentes daquelas apresentadas aos olhos humanos. Ao mesmo tempo, seus tempos de resposta ativa podem ser muito mais rápidos - ou às vezes até excessivamente lentos, nos casos em que exijam intervenção humana.

p Escrevi extensivamente sobre a natureza da interação humana com a tecnologia, especialmente no que diz respeito à próxima onda de automóveis automatizados. É claro para mim que, se as pessoas e as máquinas dirigem apenas de acordo com suas respectivas - e significativamente diferentes - habilidades perceptivas e de resposta, então os conflitos e colisões serão quase inevitáveis. Para compartilhar a estrada com segurança, cada lado precisará entender o outro muito mais intimamente do que agora.

p

Interação de movimento e visão

p Para motoristas humanos, visão é rei. Mas o que os motoristas veem depende de como eles movem o carro:frenagem, acelerar e dirigir mudam a posição do carro e, portanto, a visão do motorista. Gibson entendeu que essa interdependência mútua de percepção e ação significava que, quando confrontado com uma situação particular na estrada, as pessoas esperam que os outros se comportem de maneiras específicas. Por exemplo, uma pessoa que observa um carro chegar a uma placa de pare espera que o motorista pare o carro; olhe ao redor para ver se há tráfego próximo, pedestres, ciclistas e outros obstáculos; e prossiga somente quando a costa estiver limpa.

Um sistema Tesla ‘Autopilot’ dirige diretamente para uma barricada. p Um sinal de pare claramente existe para motoristas humanos. Isso lhes dá a chance de olhar ao redor com cuidado, sem se distrair com outros aspectos da direção, como direção. Mas um veículo autônomo pode varrer todo o entorno em uma fração de segundo. Ele não precisa necessariamente parar - ou mesmo diminuir a velocidade - para navegar no cruzamento com segurança. Mas um carro autônomo que rola por uma placa de pare sem mesmo parar será visto como alarmante, e até perigoso, para humanos próximos, porque eles estão assumindo que as regras humanas ainda se aplicam.

p

O que as máquinas podem entender

p Aqui está outro exemplo:pense nos carros que saem de uma rua lateral para uma via movimentada. As pessoas sabem que fazer contato visual com outro motorista pode ser um método eficaz de comunicação. Em uma seção dividida, um motorista pode pedir permissão para interromper e o outro motorista pode reconhecer que sim, ela cederá para abrir espaço. Como exatamente as pessoas deveriam ter essa interação com um carro que dirige sozinho? É algo que ainda não foi estabelecido.

p Pedestres, ciclistas, motociclistas, motoristas de automóveis e motoristas de caminhão são capazes de entender o que outros motoristas humanos provavelmente farão - e de expressar suas próprias intenções a outra pessoa de maneira adequada.

p Um veículo automatizado é outra questão. Ele saberá pouco ou nada do "posso?" "sim, OK "tipos de interação informal em que as pessoas se envolvem todos os dias, e ficará preso apenas às regras específicas fornecidas. Uma vez que poucos algoritmos podem entender essas suposições humanas implícitas, eles se comportarão de maneira diferente do que as pessoas esperam. Algumas dessas diferenças podem parecer sutis - mas algumas transgressões, como executar o sinal de pare, pode causar ferimentos ou mesmo a morte.

p O que mais, carros sem motorista podem ser efetivamente cegados se seus vários sistemas sensoriais forem bloqueados, avaria ou fornecer informações contraditórias. Na queda fatal de um Tesla em 2016 no modo "Autopilot", por exemplo, parte do problema pode ter sido um conflito entre alguns sensores que poderiam ter detectado um reboque de trator do outro lado da estrada e outros que provavelmente não o fizeram porque estava retroiluminado ou muito alto. Essas falhas podem ser bem diferentes das deficiências que as pessoas esperam de seus semelhantes.

p Tal como acontece com todas as novas tecnologias, haverá acidentes e problemas - e nas estradas, isso resultará quase inevitavelmente em ferimentos e morte. Mas esse tipo de problema não é exclusivo dos carros autônomos. Em vez, talvez seja inerente a qualquer situação em que humanos e sistemas automatizados compartilhem espaço. p Este artigo foi publicado originalmente em The Conversation. Leia o artigo original.