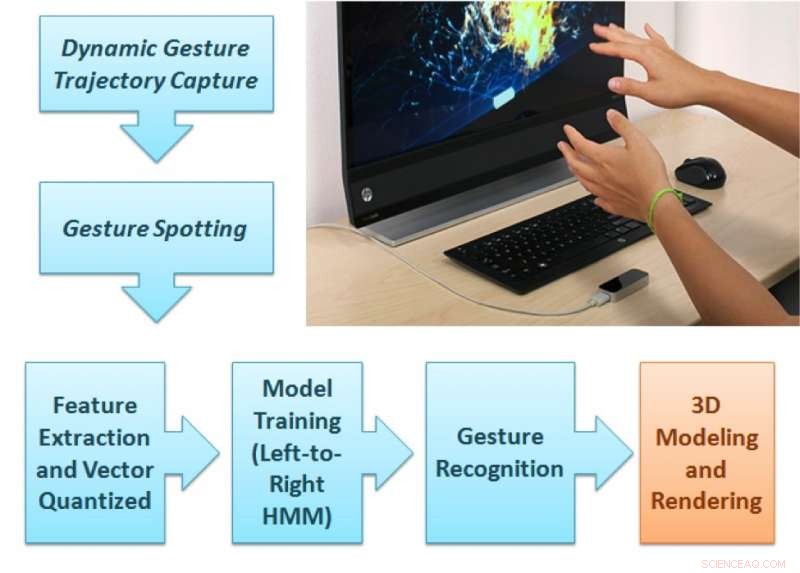

O quadro de análise de gestos proposto. Crédito:Singla, Roy, e Dogra.

Pesquisadores do NIT Kurukshetra, IIT Roorkee e IIT Bhubaneswar desenvolveram um novo método baseado em controlador Leap Motion que pode melhorar a renderização de formas 2-D e 3-D em dispositivos de exibição. Este novo método, descrito em um artigo pré-publicado no arXiv, rastreia os movimentos dos dedos enquanto os usuários executam gestos naturais dentro do campo de visão de um sensor.

Nos últimos anos, pesquisadores têm tentado criar projetos inovadores, interfaces de usuário sem toque. Essas interfaces podem permitir que os usuários interajam com dispositivos eletrônicos, mesmo quando suas mãos estão sujas ou não condutoras, ao mesmo tempo que ajuda pessoas com deficiências físicas parciais. Os estudos que exploram essas possibilidades foram aprimorados com o surgimento de sensores de baixo custo, como os usados pelo Leap Motion, Dispositivos Kinect e RealSense.

"Queríamos desenvolver uma tecnologia que pudesse fornecer uma experiência de ensino envolvente para alunos que aprendem arte em argila ou até mesmo para crianças que estão aprendendo alfabetos básicos, "Dra. Debi Prosad Dogra, um dos pesquisadores que realizaram o estudo disse ao TechXplore. "Compreendendo o fato de que as crianças aprendem melhor com estímulos visuais, utilizamos um conhecido dispositivo de captura de movimentos manuais para fornecer essa experiência. Queríamos criar uma estrutura que pudesse identificar os gestos do professor e renderizar os visuais na tela. A configuração pode ser usada para aplicativos que requerem renderização visual guiada por gestos manuais. "

A estrutura proposta pelo Dr. Dogra e seus colegas tem duas partes distintas. Na primeira parte, o usuário realiza um gesto natural entre os 36 tipos de gestos disponíveis no campo de visão do dispositivo Leap Motion.

"As duas câmeras infravermelhas dentro do sensor podem gravar a sequência de gestos, "Dr. Dogra disse." O módulo de aprendizado de máquina proposto pode prever a classe de gesto e uma unidade de renderização renderiza a forma correspondente na tela. "

As trajetórias das mãos do usuário são analisadas para extrair recursos estendidos do Npen ++ em 3-D. Esses recursos, representando os movimentos dos dedos do usuário durante os gestos, são alimentados a um modelo de Markov oculto unidirecional da esquerda para a direita (HMM) para treinamento. O sistema então realiza um mapeamento um a um entre gestos e formas. Finalmente, as formas correspondentes a esses gestos são renderizadas na tela usando a interface do MuPad.

"Da perspectiva de um desenvolvedor, a estrutura proposta é uma estrutura aberta típica, "Dr. Dogra explicou." Para adicionar mais gestos, um desenvolvedor só precisa coletar dados de sequência de gestos de vários voluntários e treinar novamente o modelo de aprendizado de máquina (ML) para novas classes. Este modelo de ML pode aprender uma representação generalizada. "

Como parte de seu estudo, os pesquisadores criaram um conjunto de dados de 5400 amostras registradas por 10 voluntários. Seu conjunto de dados contém 18 formas geométricas e 18 formas não geométricas, incluindo círculo, retângulo, Flor, cone, esfera, e muitos mais.

"A seleção de recursos é uma das partes essenciais de um aplicativo típico de aprendizado de máquina, "Dr. Dogra disse." Em nosso trabalho, estendemos os recursos existentes do Npen ++ 2-D em 3-D. Foi demonstrado que os recursos estendidos melhoram significativamente o desempenho. Os recursos 3-D Npen ++ também podem ser utilizados para outros tipos de sinais, como detecção de postura corporal, reconhecimento de atividade, etc. "

O Dr. Dogra e seus colegas avaliaram seu método com uma validação cruzada de cinco vezes e descobriram que ele alcançou uma precisão de 92,87 por cento. Seus recursos 3-D estendidos superaram os recursos 3-D existentes para representação e classificação de formas. No futuro, o método desenvolvido pelos pesquisadores pode auxiliar no desenvolvimento de aplicativos úteis de interação homem-computador (HCI) para dispositivos de exibição inteligente.

"Nossa abordagem para o reconhecimento de gestos é bastante geral, "Dr. Dogra acrescentou." Vemos esta tecnologia como uma ferramenta para a comunicação de pessoas surdas e deficientes. Agora queremos empregar o sistema para compreender os gestos e convertê-los em formatos ou formatos escritos, para ajudar as pessoas nas conversas da vida diária. Com o advento de modelos avançados de aprendizado de máquina, como redes neurais recorrentes (RNN) e memória de longo prazo (LSTM), também há amplos escopos na classificação de sinais temporais. "

© 2018 Science X Network