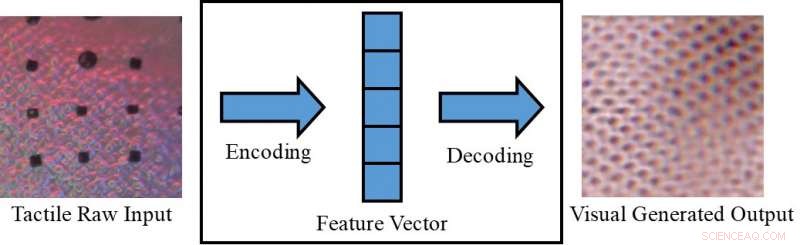

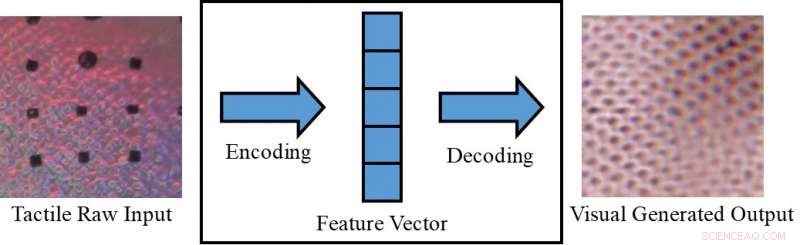

p Conversão de uma imagem tátil em uma imagem visual. Crédito:Lee, Bollegala &Luo.

p Conversão de uma imagem tátil em uma imagem visual. Crédito:Lee, Bollegala &Luo.

p Perceber um objeto apenas visualmente (por exemplo, em uma tela) ou apenas tocando-o, às vezes pode limitar o que podemos inferir sobre isso. Seres humanos, Contudo, têm a capacidade inata de integrar estímulos visuais e táteis, aproveitando todos os dados sensoriais disponíveis para completar suas tarefas diárias. p Pesquisadores da Universidade de Liverpool propuseram recentemente uma nova estrutura para gerar dados sensoriais intermodais, o que poderia ajudar a replicar informações visuais e táteis em situações em que uma das duas não está diretamente acessível. Sua estrutura poderia, por exemplo, permitem que as pessoas percebam objetos em uma tela (por exemplo, itens de roupas em sites de comércio eletrônico) tanto visual quanto tátil.

p "Em nossa experiência diária, podemos criar cognitivamente uma visualização de um objeto com base em uma resposta tátil, ou uma resposta tátil da visualização da textura de uma superfície, "Dr. Shan Luo, um dos pesquisadores que realizou o estudo, disse TechXplore. "Este fenômeno perceptivo, chamada sinestesia, em que a estimulação de um sentido causa uma reação involuntária em um ou mais dos outros sentidos, pode ser empregado para criar um sentido inacessível. Por exemplo, quando alguém agarra um objeto, nossa visão será obstruída pela mão, mas uma resposta de toque será gerada para 'ver' os recursos correspondentes. "

p O fenômeno perceptivo descrito pelo Dr. Luo normalmente ocorre quando uma fonte de percepção não está disponível (por exemplo, ao tocar em objetos dentro de uma bolsa sem poder vê-los). Em tais situações, os humanos podem "tocar para ver" ou "ver para sentir, "interpretar recursos relacionados a um sentido específico com base nas informações coletadas usando seus outros sentidos. Se replicados em máquinas, este mecanismo visual-tátil pode ter várias aplicações interessantes, particularmente nas áreas de robótica e e-commerce.

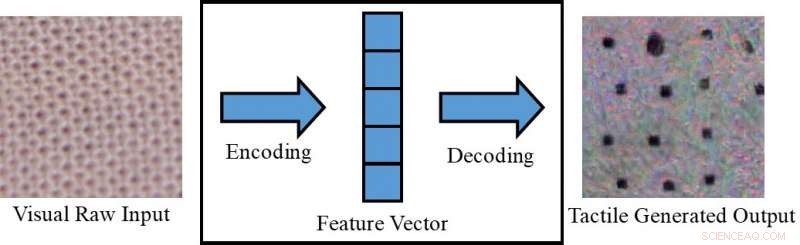

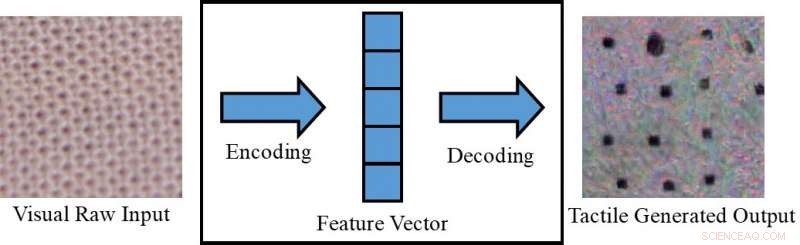

p Conversão de uma imagem visual em uma imagem tátil. Crédito:Lee, Bollegala &Luo.

p Conversão de uma imagem visual em uma imagem tátil. Crédito:Lee, Bollegala &Luo.

p Se os robôs fossem capazes de integrar a percepção visual e tátil, eles poderiam planejar suas estratégias de preensão e manipulação de forma mais eficaz com base nas características visuais dos objetos com os quais estão trabalhando (por exemplo, forma, Tamanho, etc.). Em outras palavras, robôs perceberiam as propriedades táteis gerais dos objetos antes de pegá-los, usando informações visuais coletadas por câmeras. Enquanto agarra um objeto fora do campo de visão da câmera, por outro lado, eles usariam respostas táteis para compensar a falta de informação visual disponível.

p Se emparelhado com um dispositivo tátil, que ainda não foi desenvolvido, a estrutura proposta pelo Dr. Luo e seus colegas também pode ser usada no e-commerce, por exemplo, permitindo que os clientes sintam o tecido das roupas antes de comprá-las. Com esta aplicação em mente, os pesquisadores usaram redes adversárias geradoras condicionais para gerar imagens pseudo-visuais usando dados táteis e vice-versa (ou seja, para gerar saídas táteis usando dados visuais).

p "Em mercados online, os clientes compram vendo fotos de roupas ou outros itens, "Dr. Luo disse." No entanto, eles são incapazes de tocar nesses itens para sentir seus materiais. Sentir um item é muito importante durante as compras, principalmente ao comprar itens delicados, como roupa íntima. Permitindo que os usuários sintam os itens em casa, usando um dispositivo tátil que ainda não foi desenvolvido, o esquema de geração de dados sensoriais intermodais proposto em nosso artigo pode ajudar os clientes de e-commerce a fazer escolhas mais informadas. "

p Dr. Luo e seus colegas avaliaram seu modelo no conjunto de dados VITac, que contém imagens macro e leituras táteis (capturadas usando um sensor GelSight) de 100 tipos diferentes de tecido. Eles descobriram que ele poderia prever efetivamente as saídas sensoriais para um sentido (ou seja, visão ou toque) usando dados relevantes para o outro.

p Sensor GelSight. Crédito:Lee, Bollegala &Luo.

p Sensor GelSight. Crédito:Lee, Bollegala &Luo.

p "Tomamos a percepção de textura como exemplo:imagens de entrada visual de uma textura de tecido são usadas para gerar uma leitura pseudo-tátil da mesma peça de tecido; inversamente, leituras táteis de um pano são empregadas para prever uma imagem visual do mesmo pano, "Dr. Luo explicou." As texturas dos tecidos, ou seja, os padrões de distribuição do fio, aparecem de forma semelhante em uma imagem visual e uma leitura de distribuição de pressão (isto é, tátil). Contudo, este trabalho também pode ser estendido para alcançar a geração de dados visuais-táteis intermodais para a percepção de outras propriedades do objeto, considerando as diferenças entre os dois domínios. "

p O estudo realizado pelo Dr. Luo e seus colegas alcançou resultados notáveis na geração de padrões táteis e visuais realistas para diferentes tecidos na ausência de informações táteis ou visuais, adequadamente. Usando sua estrutura, os pesquisadores 'replicaram' com sucesso os elementos táteis de tecidos usando dados visuais, e vice versa.

p "Até onde sabemos, este trabalho é a primeira tentativa de alcançar a geração de dados visuais-táteis robóticos entre modais, que também pode ser estendido para geração de dados multimodais para outras modalidades, "Dr. Luo disse." As implicações práticas de nosso estudo são que podemos fazer uso de outros sentidos para criar um sentido inacessível. "

p No futuro, a estrutura proposta pelo Dr. Luo e seus colegas pode ser usada para melhorar as estratégias de preensão e manipulação em robôs, bem como para melhorar as experiências de compra online. Seu método também pode ser usado para expandir conjuntos de dados para tarefas de classificação, gerando dados sensoriais que de outra forma seriam inacessíveis.

p Crédito:Lee, Bollegala &Luo.

p Crédito:Lee, Bollegala &Luo.

p "Em pesquisas futuras, vamos tentar aplicar nosso método a uma série de tarefas diferentes, como classificação visual e tátil em um cenário do mundo real, com objetos que variam em aparência (por exemplo, forma, cor etc.), "Dr. Luo disse. Além disso, o método de geração de dados visual-tátil proposto será usado para facilitar as tarefas robóticas, como agarrar e manipular. "

p O artigo que descreve este estudo recente, pré-publicado no arXiv, será apresentado na Conferência Internacional de Robótica e Automação 2019 (ICRA), que acontecerá em Montreal, Canadá, entre os dias 20 e 24 de maio. Na conferência, O Dr. Luo também conduzirá um workshop relacionado ao tópico de seu estudo, chamado "ViTac:Integrando visão e toque para percepção multimodal e intermodal." p © 2019 Science X Network