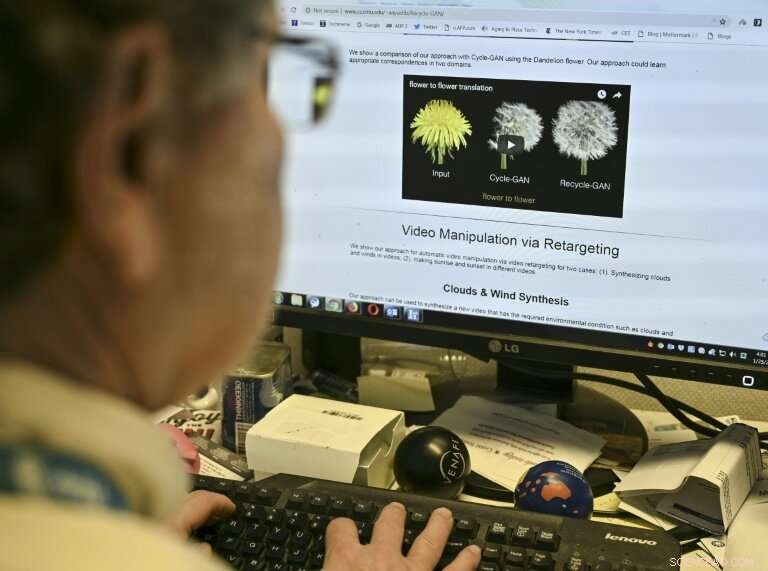

Paul Scharre, do Center for a New American Security, assiste a um vídeo "deepfake" do ex-presidente dos EUA Barack Obama manipulado para mostrá-lo falando palavras do ator Jordan Peele em 24 de janeiro, 2019, em Washington

Se você ver o vídeo de um político falando palavras que nunca diria, ou uma estrela de Hollywood que aparece de maneira improvável em um filme adulto barato, não ajuste seu aparelho de televisão - você pode estar apenas testemunhando o futuro das "notícias falsas".

Vídeos "Deepfake" que manipulam a realidade estão se tornando mais sofisticados devido aos avanços na inteligência artificial, criando o potencial para novos tipos de desinformação com consequências devastadoras.

Conforme a tecnologia avança, as preocupações estão crescendo sobre como os deepfakes podem ser usados para propósitos nefastos por hackers ou atores estatais.

"Ainda não chegamos ao estágio em que vemos deepfakes transformados em armas, mas esse momento está chegando, "Robert Chesney, um professor de direito da Universidade do Texas que pesquisou o assunto, disse à AFP.

Chesney argumenta que os deepfakes podem aumentar a atual turbulência sobre as operações de desinformação e influência.

"Um deepfake bem cronometrado e cuidadosamente planejado ou uma série de deepfakes podem derrubar uma eleição, desencadear a violência em uma cidade preparada para a agitação civil, reforçar narrativas insurgentes sobre as supostas atrocidades de um inimigo, ou exacerbar as divisões políticas em uma sociedade, "A professora Danielle Citron de Chesney and University of Maryland disse em uma postagem de blog para o Conselho de Relações Exteriores.

Paul Scharre, um membro sênior do Center for a New American Security, um think tank especializado em IA e questões de segurança, disse que era quase inevitável que deepfakes fossem usados nas próximas eleições.

A manipulação digital pode ser boa para Hollywood, mas novas técnicas "deepfake" podem criar um novo tipo de desinformação, de acordo com pesquisadores

Um vídeo falso pode ser implantado para difamar um candidato, Scharre disse, ou para permitir que as pessoas neguem eventos reais capturados em vídeo autêntico.

Com vídeos falsos críveis em circulação, ele adicionou, "as pessoas podem escolher acreditar em qualquer versão ou narrativa que quiserem, e essa é uma preocupação real. "

O retorno de Chaplin?

A manipulação de vídeo existe há décadas e pode ser inócua ou mesmo divertida, como na aparência digitalmente auxiliada de Peter Cushing em "Rogue One:A Star Wars Story, de 2016, "22 anos após sua morte.

Pesquisadores da Carnegie Mellon University no ano passado revelaram técnicas que tornam mais fácil produzir deepfakes por meio de aprendizado de máquina para inferir dados ausentes.

Na indústria do cinema, "a esperança é que possamos ter estrelas de cinema antigas como Charlie Chaplin de volta, "disse Aayush Bansal.

Os especialistas dizem que uma maneira importante de lidar com os deepfakes é aumentar a conscientização do público, tornando as pessoas mais céticas sobre o que costumava ser considerado uma prova incontovertível

A popularização de aplicativos que fazem vídeos falsos realistas ameaça minar a noção de verdade na mídia de notícias, julgamentos criminais e muitas outras áreas, pesquisadores apontam.

"Se pudermos colocar qualquer palavra na boca de alguém, isso é bastante assustador, "diz Siwei Lyu, professor de ciência da computação na State University of New York em Albany, quem está pesquisando a detecção de deepfake.

"Isso confunde a linha entre o que é verdadeiro e o que é falso. Se não podemos realmente confiar que as informações sejam autênticas, não é melhor do que não ter nenhuma informação."

O deputado Adam Schiff e dois outros legisladores enviaram recentemente uma carta ao Diretor Nacional de Inteligência Dan Coats pedindo informações sobre o que o governo está fazendo para combater a falsificação.

"Vídeos forjados, imagens ou áudio podem ser usados para atingir indivíduos para chantagem ou outros fins nefastos, "escreveram os legisladores.

"De maior preocupação com a segurança nacional, eles também podem ser usados por atores estrangeiros ou nacionais para espalhar desinformação. "

Os produtores de "Rogue One:A Star Wars Story, "atores recriados digitalmente Peter Cushing e Carrie Fisher após suas mortes usando técnicas semelhantes às empregadas para vídeos" deepfake "

Separando o falso do real

Os pesquisadores vêm trabalhando em métodos de detecção melhores há algum tempo, com o apoio de empresas privadas como o Google e entidades governamentais como a Agência de Projetos de Pesquisa Avançada de Defesa do Pentágono (DARPA), que iniciou uma iniciativa de perícia de mídia em 2015.

A pesquisa de Lyu se concentrou na detecção de falsificações, em parte, analisando a taxa de piscar dos olhos de um indivíduo.

Mas ele reconhece que mesmo detectar falsificações pode não ser suficiente, se um vídeo se tornar viral e levar ao caos.

“É mais importante interromper o processo do que analisar os vídeos, "Lyu disse.

Embora deepfakes tenham evoluído por vários anos, o tópico entrou em foco com a criação, em abril passado, de um vídeo que mostra o ex-presidente Barack Obama usando um palavrão para descrever seu sucessor Donald Trump - uma façanha coordenada do cineasta Jordan Peele e BuzzFeed.

Um jornalista da AFP vê um exemplo de vídeo "deepfake" manipulado usando inteligência artificial, por pesquisadores da Carnegie Mellon University

Também em 2018, uma proliferação de vídeos pornôs de "troca de rosto" que usavam imagens de Emma Watson, Scarlett Johansson e outras celebridades levaram à proibição de deepfakes pelo Reddit, Twitter e Pornhub, embora não esteja claro se eles poderiam aplicar as políticas.

Scharre disse que há "uma corrida armamentista entre aqueles que estão criando esses vídeos e os pesquisadores de segurança que estão tentando construir ferramentas eficazes de detecção".

But he said an important way to deal with deepfakes is to increase public awareness, making people more skeptical of what used to be considered incontrovertible proof.

"After a video has gone viral it may be too late for the social harm it has caused, " ele disse.

© 2019 AFP