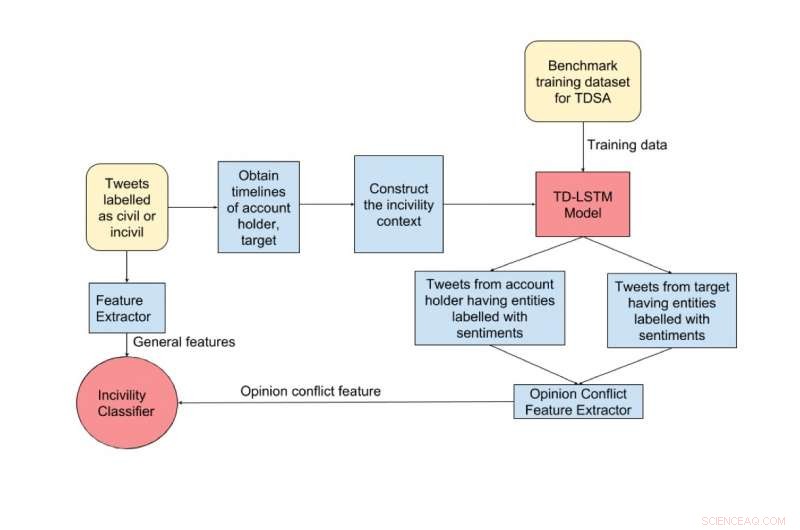

Esquema das etapas para detecção de incivilidade. Os blocos amarelos representam entradas, os blocos vermelhos representam os classificadores e os blocos azuis representam as etapas intermediárias. Crédito:Maity et al.

Pesquisadores da Northwestern University, Universidade McGill, e o Instituto Indiano de Tecnologia Kharagpur desenvolveram recentemente um modelo de rede neural convolucional (CNN) em nível de personagem que pode ajudar a detectar postagens abusivas no Twitter. Este modelo superou vários métodos de linha de base, alcançando uma precisão de 93,3 por cento.

Nos últimos anos, o comportamento abusivo em plataformas online tem aumentado exponencialmente, particularmente no Twitter. As empresas de mídia social estão, portanto, buscando novos métodos eficazes para identificar esse comportamento, a fim de intervir e evitar que cause danos graves.

"Twitter, que foi inicialmente concebido como uma 'praça da cidade, 'está se transformando em um mosh pit, "Animesh Mukherjee, um dos pesquisadores que realizou o estudo, contado Tech Xplore . "Um número crescente de agressões cibernéticas, casos de cyberbullying e incivilidade estão sendo relatados todos os dias, muitos dos quais afetam gravemente os usuários. Na verdade, esta é uma das principais razões pelas quais o Twitter está perdendo sua base de seguidores ativos. "

O conteúdo online pode se espalhar rapidamente e atingir públicos muito amplos, portanto, os casos de abuso online frequentemente se arrastam por longos períodos de tempo com efeitos altamente prejudiciais. A vítima ou vítimas, bem como outros espectadores sensíveis, pode acabar lendo as palavras do infrator inúmeras vezes antes que elas finalmente desapareçam do Twitter. É por isso que é importante que as plataformas de mídia social detectem esse conteúdo de forma eficaz e rápida, realizando intervenções oportunas para removê-lo.

“Estabelecemos com o objetivo de desenvolver um mecanismo que pode detectar automaticamente tweets incivis precoces, antes que possam causar danos graves, "Mukherjee disse." Observamos que, na maioria das vezes, uma vítima / alvo é atacado após expressar fortes sentimentos em relação a certas entidades nomeadas. Isso nos levou à ideia central de alavancar conflitos de opinião para detectar tweets rudes. "

Mukherjee e seus colegas perceberam que as postagens abusivas costumam estar relacionadas a diferenças de opinião entre o infrator e o alvo, particularmente opiniões sobre uma figura ou entidade pública de renome. Eles, portanto, incorporaram informações de sentimento específicas da entidade em seu modelo CNN, esperando que isso melhorasse seu desempenho na detecção de conteúdo abusivo.

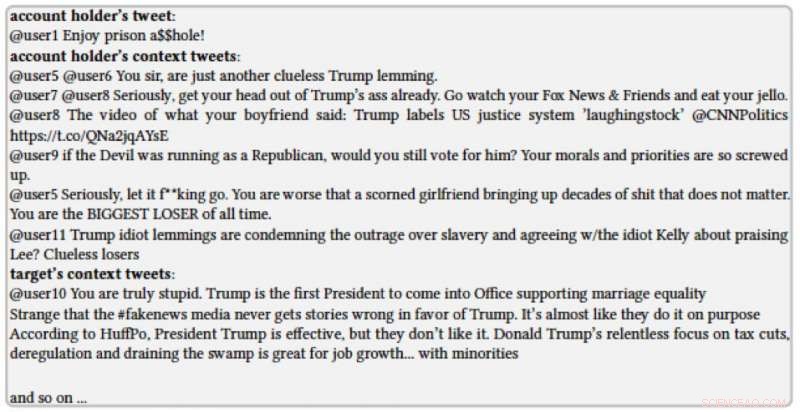

No exemplo de contexto de incivilidade citado abaixo, observamos que o target tweet positivamente sobre Donald Trump e a economia dos EUA. Contudo, o infrator (titular da conta) tweeta negativamente sobre Trump e positivamente sobre o presidente Obama. Podemos observar que existe um conflito de opinião entre o destinatário e o titular da conta, visto que os sentimentos expressos em relação à entidade de nome comum Donald Trump são opostos. Passando por toda a troca de mensagens, descobrimos que este conflito de opinião eventualmente leva a um posto incivil. Crédito:Maity et al.

"O nível de personagem CNN tenta extrair automaticamente padrões de tuítes incivis que os distinguem de outros tuítes, "Pawan Goyal, outro pesquisador que realizou o estudo, disse Tech Xplore. "Também optamos por usar a incorporação de nível de caractere, em vez de incorporação no nível da palavra. Como os tweets geralmente são pequenos, contém apenas algumas palavras, e tem muitas variações de grafia, modelos em nível de personagem são considerados mais robustos do que modelos em nível de palavra. "

Este modelo de nível de personagem da CNN superou o melhor método de linha de base em 4,9 por cento, alcançando uma precisão de 93,3 por cento na detecção de tuítes incivis. Os pesquisadores também realizaram uma análise post-hoc, dando uma olhada mais de perto nos aspectos comportamentais de criminosos e vítimas no Twitter, na esperança de compreender melhor os incidentes de incivilidade.

Esta análise revelou que uma parte considerável dos usuários eram infratores reincidentes que assediaram os alvos mais de 10 vezes. De forma similar, alguns alvos foram assediados por diferentes infratores em diversas ocasiões. "A descoberta mais interessante deste estudo é que os conflitos de opinião estão fortemente correlacionados com o comportamento rude no Twitter, "Mukherjee disse." Este único recurso vinculado ao modelo neural profundo baseado em char-CNN pode ser muito eficaz na identificação precoce de tweets incivis. "

No futuro, o modelo da CNN idealizado por Mukherjee e seus colegas poderia ajudar a neutralizar e reduzir o conteúdo abusivo no Twitter. Os pesquisadores agora estão tentando desenvolver modelos semelhantes para detectar discurso de ódio no Twitter, bem como em outras plataformas de mídia social.

"Enquanto isso, também estamos estudando como o discurso de ódio se espalha nas redes sociais, além de investigar como diferentes métodos de combate ao discurso de ódio podem ajudar a enfrentar esse terrível fenômeno online, "Mukherjee disse.

© 2018 Tech Xplore