Exemplo de imagem de rosto real a partir de conjunto de dados fornecido pelo artigo “Progressive Growing of GANs for Improved Quality, Estabilidade, e variação ”. Crédito:Karras et al.

Pesquisadores da Universidade de Shenzhen desenvolveram recentemente um método para detectar imagens geradas por redes neurais profundas. Seu estudo, pré-publicado no arXiv, identificou um conjunto de recursos para capturar estatísticas de imagens coloridas que podem detectar imagens geradas usando ferramentas de inteligência artificial atuais.

"Nossa pesquisa foi inspirada no rápido desenvolvimento de modelos geradores de imagens e na disseminação de imagens falsas geradas, "Bin Li, um dos pesquisadores que realizou o estudo, contado Tech Xplore . "Com o surgimento de modelos avançados de geração de imagens, como redes adversárias geradoras (GAN) e autoencoders variacionais, imagens geradas por redes profundas tornam-se cada vez mais fotorrealistas, e não é mais fácil identificá-los com olhos humanos, o que acarreta sérios riscos de segurança. "

Recentemente, vários pesquisadores e plataformas de mídia globais expressaram sua preocupação com os riscos apresentados por redes neurais artificiais treinadas para gerar imagens. Por exemplo, algoritmos de aprendizagem profunda, como redes adversárias geradoras (GAN) e codificadores automáticos variacionais, podem ser usados para gerar imagens e vídeos realistas para notícias falsas ou podem facilitar fraudes online e a falsificação de informações pessoais nas mídias sociais.

Os algoritmos GAN são treinados para gerar imagens cada vez mais realistas por meio de um processo de tentativa e erro em que um algoritmo gera imagens e outro, o discriminador, fornece feedback para tornar essas imagens mais realistas. Hipoteticamente, este discriminador também pode ser treinado para detectar imagens falsas de imagens reais. Contudo, esses algoritmos usam principalmente imagens RGB como entrada e não consideram as disparidades nos componentes de cor, portanto, seu desempenho provavelmente seria insatisfatório.

Exemplo de imagem facial gerada a partir do conjunto de dados fornecido pelo artigo “Crescimento progressivo de GANs para qualidade aprimorada, Estabilidade, e variação ”. Crédito:Karras et al.

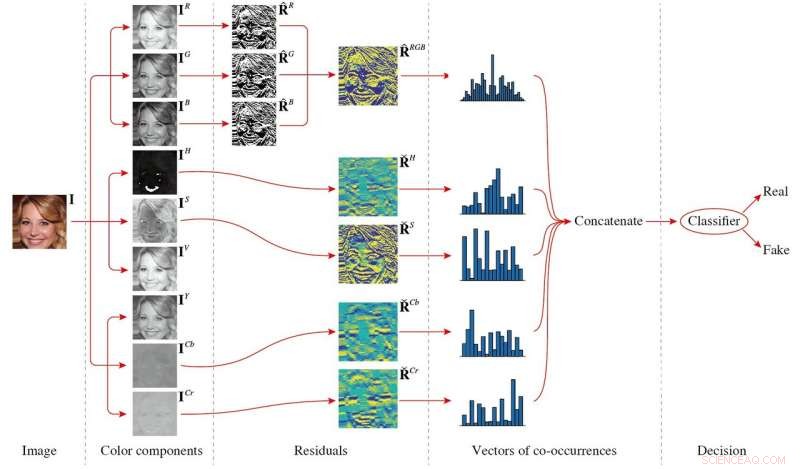

Em seu estudo, Li e seus colegas analisaram as diferenças entre as imagens geradas pelo GAN e as imagens reais, propondo um conjunto de características que possam efetivamente ajudar a classificá-los. O método resultante funciona analisando as diferenças nos componentes de cor entre imagens verdadeiras e geradas.

"Nossa ideia básica é que os pipelines de geração de imagens reais e imagens geradas são bastante diferentes, então as duas classes de imagens devem ter algumas propriedades diferentes, "Haodong Li, explicou um dos pesquisadores. "Na verdade, eles vêm de diferentes pipelines. Por exemplo, imagens reais são geradas por dispositivos de imagem, como câmeras e scanners para capturar uma cena real, enquanto as imagens geradas são criadas de uma maneira totalmente diferente com convolução, conexão, e ativação de redes neurais. As diferenças podem resultar em propriedades estatísticas diferentes. Neste estudo, consideramos principalmente as propriedades estatísticas dos componentes da cor. "

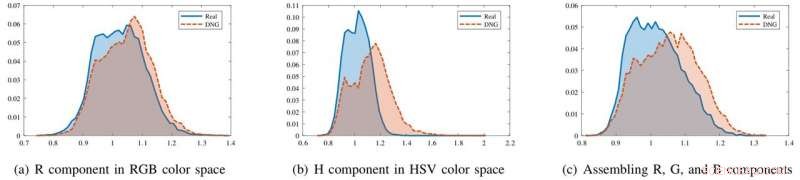

Os pesquisadores descobriram que, embora as imagens geradas e as imagens reais sejam semelhantes no espaço de cores RGB, eles têm propriedades estatísticas marcadamente diferentes nos componentes de crominância de HSV e YCbCr. Eles também observaram diferenças ao montar o R, G, e componentes de cor B juntos.

O conjunto de recursos que eles propuseram, que consiste em matrizes de co-ocorrência extraídas dos resíduos de filtragem passa-alta da imagem de vários componentes de cor, explora essas diferenças, captura de disparidades em cores entre imagens reais e geradas. Este conjunto de recursos é de baixa dimensão e pode funcionar bem mesmo quando treinado em um pequeno conjunto de dados de imagem.

Os histogramas de estatísticas de imagem para imagens reais (azul) e imagens geradas por rede profunda (DNG) (vermelho) em diferentes componentes de cores. No componente R, os dois histogramas são amplamente sobrepostos. Contudo, no componente H ou pela montagem de R, G, Componentes B juntos, os histogramas são mais separáveis. Crédito:Li et al.

Li e seus colegas testaram o desempenho de seu método em três conjuntos de dados de imagens:Atributos do CelebFaces, CelebA de alta qualidade, e rostos marcados na natureza. Suas descobertas foram muito promissoras, com o conjunto de recursos tendo um bom desempenho em todos os três conjuntos de dados.

"A descoberta mais significativa de nosso estudo é que as imagens geradas por redes profundas podem ser facilmente detectadas pela extração de recursos de certos componentes de cor, embora as imagens geradas possam ser visualmente indistinguíveis com os olhos humanos, "Haodong Li disse." Quando amostras de imagens geradas ou modelos generativos estiverem disponíveis, os recursos propostos equipados com um classificador binário podem efetivamente diferenciar entre imagens geradas e imagens reais. Quando os modelos generativos são desconhecidos, os recursos propostos, juntamente com um classificador de uma classe, também podem atingir um desempenho satisfatório. "

O estudo pode ter várias implicações práticas. Primeiro, o método pode ajudar a identificar imagens falsas online.

A estrutura geral do método proposto. A imagem de entrada é primeiro decomposta em diferentes componentes de cores, e então o residual de cada componente de cor é calculado. Para calcular as co-ocorrências, o R, G, e os componentes B são montados, enquanto o H, S, Cb, e os componentes Cr são processados independentemente. Finalmente, todos os vetores de co-ocorrência são concatenados e alimentados a um classificador para obtenção do resultado da decisão. Crédito:Li et al.

Their findings also imply that several inherent color properties of real images have not yet been effectively replicated by existing generative models. No futuro, this knowledge could be used to build new models that generate even more realistic images.

Finalmente, their study proves that different generation pipelines used to produce real images and generated images are reflected in the properties of the images produced. Color components comprise merely one of the ways in which these two types of images differ, so further studies could focus on other properties.

"No futuro, we plan to improve the image generation performance by applying the findings of this research to image generative models, " Jiwu Huang, one of the researchers said. "Por exemplo, including the disparity metrics of color components for real and generated images into the objective function of a GAN model could produce more realistic images. We will also try to leverage other inherent information from the real image generation pipeline, such as sensor pattern noises or properties of color filter array, to develop more effective and robust methods for identifying generated images."

© 2018 Tech Xplore