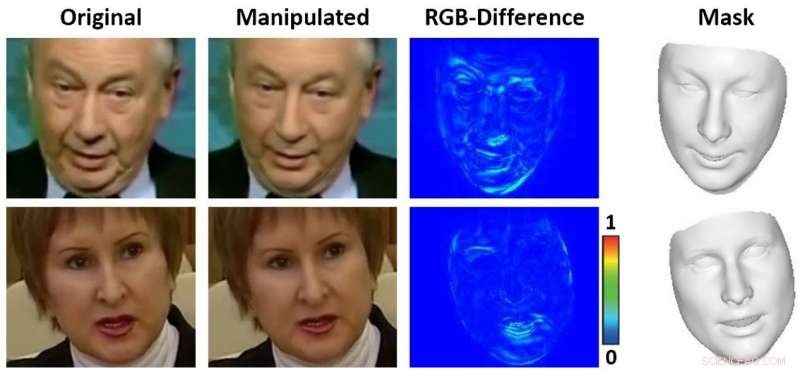

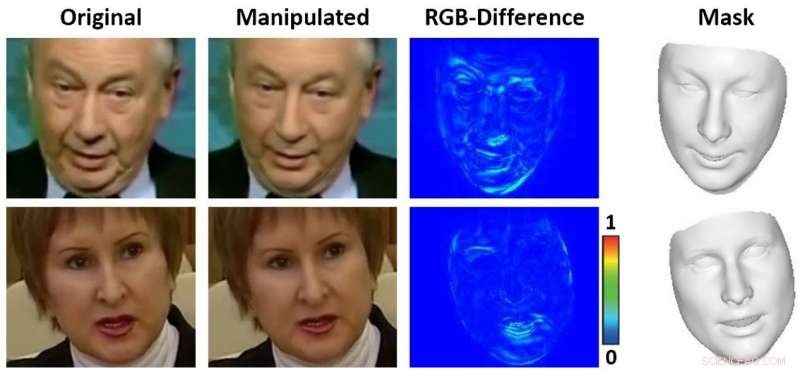

p Falso ou real? Exemplos do conjunto de dados de auto-reconstituição FaceForensics. Da esquerda para a direita:imagem de entrada original, imagem de saída auto-reconstituída, gráfico de diferença de cores e máscara facial que é usada durante a síntese da imagem de saída. Crédito:arXiv:1803.09179 [cs.CV]

p Falso ou real? Exemplos do conjunto de dados de auto-reconstituição FaceForensics. Da esquerda para a direita:imagem de entrada original, imagem de saída auto-reconstituída, gráfico de diferença de cores e máscara facial que é usada durante a síntese da imagem de saída. Crédito:arXiv:1803.09179 [cs.CV]

p A manipulação de imagens neste estágio avançado da era digital não é tão divertida, mas uma arma arriscada, nas sombras de notícias falsas, para influenciar a opinião e desencadear escândalos. p Troca de rosto, em particular, parece divertido se você pensar nisso como uma risada em uma mesa familiar enquanto crianças e adultos experimentam rostos diferentes em pessoas diferentes. Contudo, é também uma ferramenta para motivos muito piores. Swapna Krishna em

Engadget comentou que "As pessoas têm, claro, aproveitou esta ferramenta para alguns usos perturbadores, incluindo a troca de rostos de pessoas por vídeos pornográficos - a última palavra em pornografia de vingança. "

p No

MIT Technology Review , a "Tecnologia Emergente do arXiv" disse, "Vídeos pornográficos chamados 'deepfakes' surgiram em sites que mostram rostos de pessoas famosas sobrepostos a corpos de atores."

p Pesquisadores, Contudo, interessado em explorar a ferramenta e saber se ela é usada, criaram um algoritmo, dizem os observadores, que pode superar outras técnicas disponíveis. Eles descobriram uma maneira de detectar uma troca de rosto por meio do algoritmo, pegando vídeos falsos assim que postados.

p

Analytics Vidhya comentou, "Algo semelhante a este algoritmo era desesperadamente necessário para travar a batalha contra as trocas de rosto usadas pelos motivos errados. Ao liberar o artigo de pesquisa para o público, os pesquisadores esperam que outros também tomem o bastão e trabalhem neste estudo para torná-lo mais preciso e preciso. "

p Andreas Rossler foi o líder da equipe dos participantes da Universidade Técnica de Munique, Universidade Federico II de Nápoles e Universidade de Erlangen-Nuremberg.

p Eles treinaram o algoritmo, XceptionNet, usando um grande conjunto de trocas de rosto, disse

Engadget .

p "Estabelecemos uma base sólida de resultados para a detecção de manipulação facial com arquiteturas modernas de aprendizado profundo, "disse Rossler e equipe em

MIT Technology Review . O tamanho importava.

p O tamanho deste banco de dados foi uma melhoria significativa em relação ao que estava disponível anteriormente. "Apresentamos um novo conjunto de dados de vídeos manipulados que excede todos os conjuntos de dados forenses disponíveis publicamente em ordens de magnitude, "disse Rossler.

p Em seu jornal, os autores disseram que introduziram um conjunto de dados de manipulação de rosto, FaceForensics, "de cerca de meio milhão de imagens editadas (de mais de 1000 vídeos)."

p O artigo é intitulado "FaceForensics:um conjunto de dados de vídeo em larga escala para detecção de falsificação em faces humanas, "no arXiv. Os autores são Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christian Riess, Justus Thies e Matthias Nießner.

p Os autores chamaram a atenção para a dificuldade - para humanos e computadores - em tentar distinguir entre vídeo original e manipulado, "especialmente quando os vídeos são compactados ou têm baixa resolução, como costuma acontecer nas redes sociais. "

p Eles também chamaram a atenção para o fato de que "a pesquisa sobre a detecção de manipulações de rosto foi seriamente prejudicada pela falta de conjuntos de dados adequados."

p Há uma nuance em seu sucesso, no entanto, que também merece atenção. O artigo "Tecnologia emergente do arXiv" chamou-o de "ferroada na cauda". O que é? "A mesma técnica de aprendizado profundo que pode detectar vídeos de troca de rosto também pode ser usada para melhorar a qualidade das trocas de rosto em primeiro lugar - e isso pode torná-los mais difíceis de detectar."

p

Engadget dito da mesma forma, "O XceptionNet supera claramente suas técnicas rivais na detecção desse tipo de vídeo falso, mas também melhora a qualidade das falsificações. A equipe de Rossler pode usar as maiores marcas de uma troca de rosto para tornar a manipulação mais perfeita. Não engana a XceptionNet, mas no longo prazo, pode dificultar a detecção de vídeos falsos por outros métodos. "

p Pranav Dar, no

Analytics Vidhya , também ponderou sobre o que chamou de "uma advertência com este algoritmo - ele também pode ser potencialmente usado para melhorar a qualidade das trocas faciais, o que tornará mais difícil detectar a falsificação. Além disso, assim que um algoritmo de detecção de falsificação é lançado, os golpistas sempre tentam refinar seu modelo para ficar um passo à frente. "

p Apesar disso, os autores disseram, "nosso refinador melhora principalmente a qualidade visual, mas isso dificulta apenas um pouco a detecção de falsificação para o método de aprendizado profundo treinado exatamente nos dados de saída forjados. " p © 2018 Tech Xplore