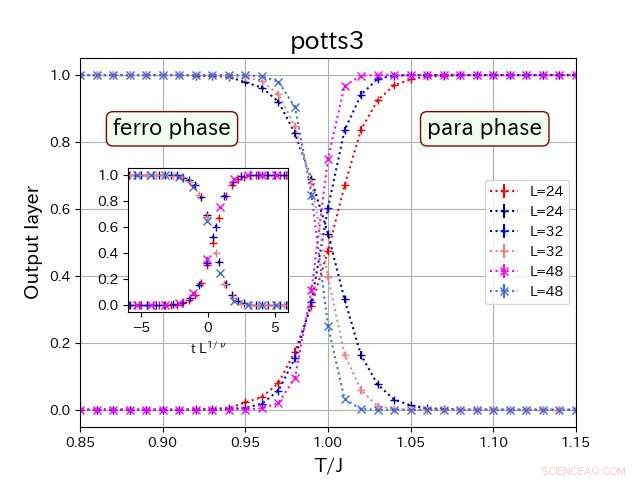

As fases de baixa e alta temperatura são encontradas nas proporções corretas em diferentes temperaturas em relação ao ponto de transição para diferentes tamanhos de rede. (inserção) O tamanho da rede pode ser contabilizado para fornecer uma única curva mestre. Crédito:Tokyo Metropolitan University

Pesquisadores da Tokyo Metropolitan University usaram aprendizado de máquina para analisar modelos de spin, que são usados em física para estudar as transições de fase. Trabalhos anteriores mostraram que um modelo de classificação de imagem / escrita pode ser aplicado para distinguir estados nos modelos mais simples. A equipe mostrou que a abordagem é aplicável a modelos mais complexos e descobriu que uma IA treinada em um modelo e aplicada a outro poderia revelar semelhanças importantes entre fases distintas em sistemas diferentes.

O aprendizado de máquina e a inteligência artificial (IA) estão revolucionando a forma como vivemos, trabalhar, Toque, e dirigir. Carros autônomos, o algoritmo que derrotou um grande mestre Go e os avanços nas finanças são apenas a ponta do iceberg de uma ampla gama de aplicações que agora têm um impacto significativo na sociedade. A IA também está causando ondas na pesquisa científica. Uma atração principal desses algoritmos é que eles podem ser treinados com dados pré-classificados (por exemplo, imagens de cartas escritas à mão) e ser aplicada para classificar uma gama muito mais ampla de dados.

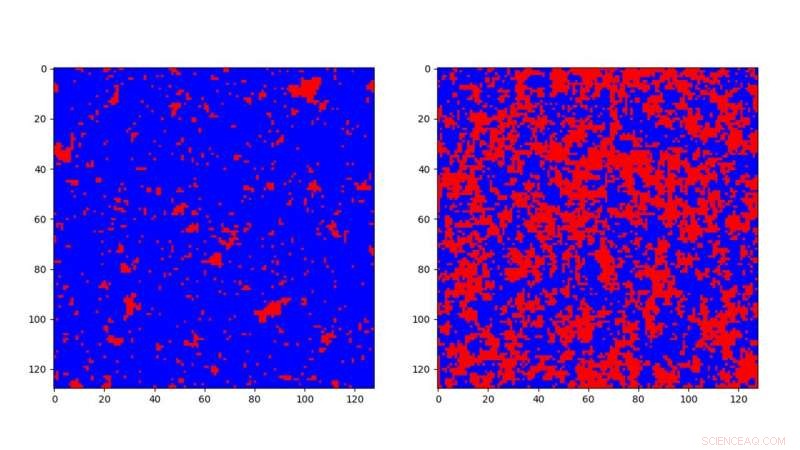

No campo da física da matéria condensada, trabalho recente de Carrasquilla e Melko ( Física da Natureza (2017) 13, 431-434) mostrou que as redes neurais, o mesmo tipo de IA usado para interpretar caligrafia, poderia ser usado para distinguir diferentes fases da matéria (por exemplo, gás, líquidos e sólidos) em modelos físicos simples. Eles estudaram o modelo de Ising, o modelo mais simples para o surgimento de magnetismo em materiais. Uma rede de átomos com spin (para cima ou para baixo) tem uma energia que depende do alinhamento relativo dos spins adjacentes. Dependendo das condições, esses spins podem se alinhar em uma fase ferromagnética (como o ferro) ou assumir direções aleatórias em uma fase paramagnética. Usualmente, estudos deste tipo de sistema envolvem a análise de alguma quantidade média (por exemplo, a soma de todos os giros). O fato de que toda uma configuração microscópica pode ser usada para classificar uma fase apresentou uma genuína mudança de paradigma.

Fase simulada de baixa temperatura (esquerda) e alta temperatura (direita) de um modelo 2D Ising, onde os pontos azuis são spins apontando para cima, e os pontos vermelhos são spins apontando para baixo. Observe que os spins na fase de baixa temperatura estão principalmente na mesma direção. Isso é chamado de fase ferromagnética. Por outro lado, em alta temperatura, a proporção de giros para cima e para baixo é mais próxima de 50:50. Isso é chamado de fase paramagnética. Crédito:Tokyo Metropolitan University

Agora, uma equipe liderada pelos professores Hiroyuki Mori e Yutaka Okabe da Tokyo Metropolitan University está colaborando com o Instituto de Bioinformática em Cingapura para levar essa abordagem ao próximo nível. Em sua forma existente, o método de Carrasquilla e Melko não pode ser aplicado a modelos mais complexos do que o modelo de Ising. Por exemplo, pegue o modelo de Potts q-state, onde os átomos podem assumir um dos estados q em vez de apenas "para cima" ou "para baixo". Embora também tenha uma transição de fase, distinguir as fases não é trivial. Na verdade, no caso de um modelo de cinco estados, existem 120 estados que são fisicamente equivalentes. Para ajudar uma IA a diferenciar as fases, a equipe deu mais informações microscópicas, especificamente, como o estado de um átomo particular se relaciona com o estado de outro átomo a alguma distância, ou como os spins se correlacionam com a separação. Tendo treinado a IA com muitas dessas configurações de correlação para modelos de Potts de três e cinco estados, eles descobriram que ele poderia classificar corretamente as fases e identificar a temperatura em que a transição ocorreu. Os pesquisadores também puderam contabilizar corretamente o número de pontos em sua rede, o efeito de tamanho finito.

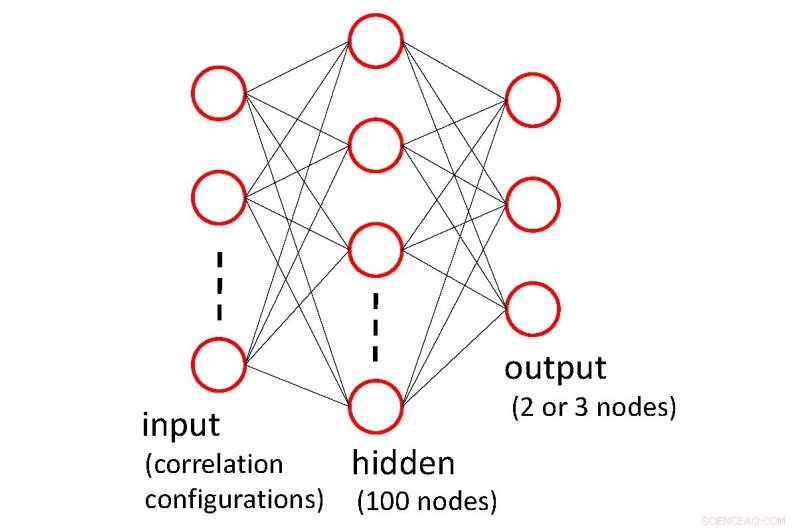

A entrada (configurações de correlação) é alimentada em um sistema de nós interconectados conhecido como rede neural , dando uma série de saídas informando a qual fase a configuração pertence. Durante o treinamento, o algoritmo é informado se as saídas estão certas ou erradas, e a rede é ajustada repetidamente para obter um melhor acordo, ou seja, aprende . Crédito:Tokyo Meropolitan University

Tendo demonstrado que seu método funciona, eles tentaram a mesma abordagem em um modelo de relógio q-state, onde os spins adotam uma das orientações q em um círculo. Quando q é maior ou igual a cinco, existem três fases que o sistema pode assumir:uma fase de baixa temperatura ordenada, uma fase de alta temperatura, e uma fase intermediária conhecida como fase Berezinskii-Kosterlitz-Thouless (BKT), cuja investigação ganhou John M. Kosterlitz, David J. Thouless e Duncan Haldane o Prêmio Nobel de Física de 2016. Eles treinaram com sucesso uma IA para diferenciar as três fases com um modelo de relógio de seis estados. Quando eles o aplicaram a configurações de um modelo de relógio de quatro estados, em que apenas duas fases são esperadas, eles descobriram que o algoritmo poderia classificar o sistema como estando em uma fase BKT perto da transição de fase. Isso demonstra que há uma conexão profunda entre a fase BKT e a fase crítica que surge no ponto de transição de fase suave de 'segunda ordem' no sistema de quatro estados.

O método apresentado pela equipe é geralmente aplicável a uma ampla gama de problemas científicos. Uma parte fundamental da física é a universalidade, identificar traços em sistemas ou fenômenos aparentemente não relacionados que dão origem a um comportamento unificado. O aprendizado de máquina é adequado exclusivamente para destacar esses recursos dos modelos e sistemas mais complexos, deixar os cientistas darem uma olhada nas conexões profundas que governam a natureza e nosso universo.